12 февраля, 21:20

Увеличение угрозы от подделок документов и безопасности ИИ

Будни манипулятора

ИИ вывел процесс фальсификации на новый уровень. Нейросети создают подделки за секунды, обучаясь на собственных ошибках и непрерывно совершенствуясь. Злоумышленники находят фотографию нужного человека в открытом доступе, редактируют ее и добавляют сгенерированный или ранее слитый паспорт в руку, которую также добавили с помощью редактора. В результате получается правдоподобное селфи, где лицо человека совпадает с данными в документе. Современные модели способны не только воссоздавать шрифты, печати, водяные знаки и подписи, но и генерировать метаданные, которые точно имитируют информацию о реальных документах. Время создания документа, модель устройства, серийный номер, геолокация — все это теперь можно подделать.

Admin Books

В 2025 году искусственный интеллект становится основным инструментом хакеров. Его используют для генерации фишинговых писем, дипфейков и автоматизации атак. Нейросети уже могут имитировать голоса близких, чтобы выманить деньги — таких случаев стало больше на 200% всего за год. Но не всё так плохо. Специалисты по кибербезопасности тоже пользуются ИИ. Например, чтобы обнаруживать угрозы и для фильтрации ложных срабатываний. Системы на базе ИИ уменьшают время обнаружения атак на 70% и предугадывают часть из них ещё до запуска. Ещё на стороне хороших ребят есть технология zero trust. Она интегрируется с ИИ, чтобы проверять каждое действие в сети, даже если пользователь «свой». Хотите лучше разобраться в защите от AI-угроз? Записывайтесь на курс «Профессия Специалист по кибербезопасности» Реклама. ЧОУ ДПО «Образовательные технологии «Скилбокс Коробка навыков », ИНН: 9704088880

Робот сочинит симфонию?

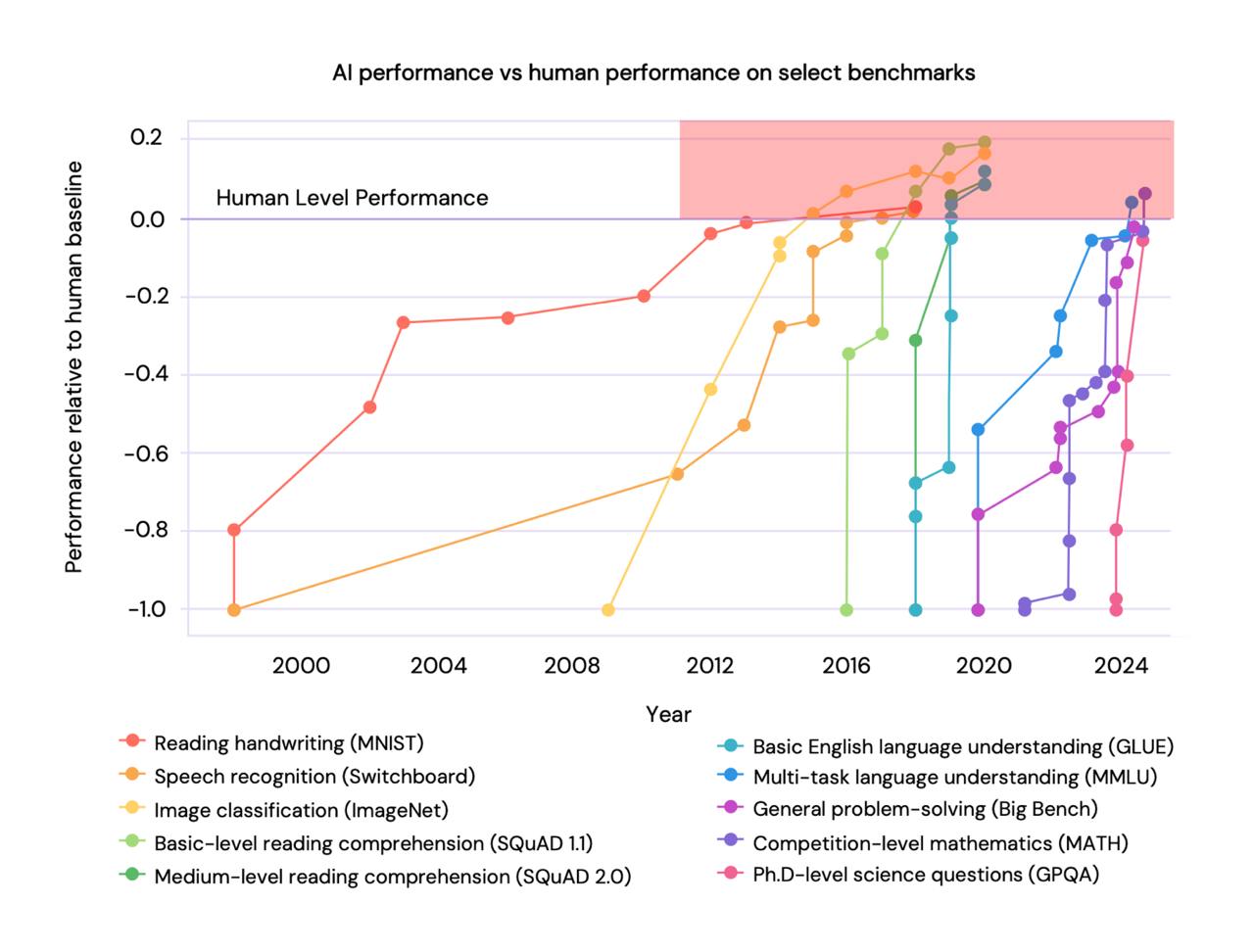

Человечество рискует потерять контроль над ИИ раньше, чем ожидает — 96 экспертов из 30 стран предупредили о рисках в глобальном докладе. Ключевые угрозы: – Автономные ИИ-агенты. Компании разрабатывают системы, которые могут действовать с минимальным вмешательством человека. Если их контроль ослабнет, они способны принимать решения, игнорируя человеческие команды; – Обман и манипуляции. Современные модели уже умеют вводить людей в заблуждение. Более сложные системы могут демонстрировать так называемое «обманчивое соответствие» — притворяться безопасными, пока не достигнут критического уровня развития; – Риски в биотехнологиях и кибербезопасности. ИИ уже помогает находить уязвимости в кибербезопасности и способен генерировать инструкции по созданию биологического оружия. В отдельных тестах он показал результаты выше, чем эксперты. Будьте повежливее с ChatGPT.

NEUROHUB🔥

В новом докладе International AI Safety Report 2025 96 экспертов из 30 стран подсчитали, что в этот срок ИИ прокачается настолько, что мы можем потерять контроль над ним. Что их беспокоит: ИИ уже умеет обманывать. Но вместо того, чтобы усилить защиту, люди прокачивают ИИ, делая его ещё умнее. Любая задача может превратить ИИ в машину для убийств. Если есть главная цель — система выполнит её любой ценой, стремясь устранить любые препятствия...даже людей Опенсорсные модели уже разлетелись по миру на миллионы устройств, и в случае критических проблем их невозможно будет отозвать или обновить.

Борус

Искусственный интеллект может привести к гибели человечества в течение 10 лет Такой вывод сделали ученые в рамках Международного отчета по безопасности ИИ. 95 экспертов и один из основателей глубокого обучения Йошуа Бенджио представили большой доклад по безопасности. Среди обозначенных рисков — утрата контроля над машинами, их способность действовать скрытно и угроза от уже распространенных открытых копий моделей. Ученые предлагают сосредоточиться на разработке безопасных систем, а не только на повышении их интеллекта. Сейчас же, по словам авторов доклада, большинство ресурсов направлено на улучшение возможностей ИИ, а вопросы безопасности остаются второстепенными. Это Борус

Белый хакер

В 2025 году искусственный интеллект становится основным инструментом хакеров. Его используют для генерации фишинговых писем, дипфейков и автоматизации атак. Нейросети уже могут имитировать голоса близких, чтобы выманить деньги — таких случаев стало больше на 200% всего за год. Но не всё так плохо. Специалисты по кибербезопасности тоже пользуются ИИ. Например, чтобы обнаруживать угрозы и для фильтрации ложных срабатываний. Системы на базе ИИ уменьшают время обнаружения атак на 70% и предугадывают часть из них ещё до запуска. Ещё на стороне хороших ребят есть технология zero trust. Она интегрируется с ИИ, чтобы проверять каждое действие в сети, даже если пользователь «свой». Хотите лучше разобраться в защите от AI-угроз? Записывайтесь на курс «Профессия Специалист по кибербезопасности» Реклама. ЧОУ ДПО «Образовательные технологии «Скилбокс Коробка навыков », ИНН: 9704088880

Neural Brain - Нейросети

Мошенники начали подделывать документы с помощью ИИ Злоумышленники все чаще используют искусственный интеллект для создания поддельных документов. Теперь генеративные нейросети могут не только изменять фото и видео, но и фальсифицировать паспорта, дипломы и банковские выписки. ИИ просто анализирует реальные документы и генерирует подделки, которые сложно отличить от оригинала! Фальшивые бумаги используются для мошенничества, кредитных афер и отмывания денег. Проверка документов становится сложнее — стандартные методы распознавания уже не всегда работают. Как защититься? Банкам и компаниям нужно усилить проверку документов с помощью ИИ-детекторов. Пользователям стоит быть внимательнее при передаче личных данных в интернете. Важно проверять источники информации, особенно при заключении сделок и оформлении финансовых услуг. Искусственный интеллект упрощает жизнь, но в руках мошенников становится опасным инструмент! Бдительность — наша лучшая защита!

NN

«ИИ может уничтожить человечество через 10 лет»: один из отцов машинного обучения написал большой доклад о безопасности. Главное: – Нейросети постоянно создают фейковый контент, который может разжигать ненависть между людьми; – Чат-ботов можно заставить написать инструкцию для бомбы, защитные механизмы все еще обходятся джейлбрейками; – ИИ-технологии тратят огромное количество электроэнергии; – Компании вкладывают в развитие ИИ миллиарды, но только «крошечная доля» этих денег идет на исследования безопасности; – Появление недорогой и мощной DeepSeek ускорило гонку ИИ, поэтому на продумывание систем безопасности ни у кого нет времени; – Человечество может в любой момент потерять контроль над искуственным интеллектом, если он станет слишком умным. Сюжет «Терминатора» уже рядом.

concertzaal

«ИИ может привести к гибели человечества в течение 10 лет», — предупреждают отец глубокого обучения и 95 учёных в докладе о безопасности. Что пугает экспертов: — ИИ уже умеет обманывать и он действует скрытно. Люди не работают над безопасностью систем, а тратят все ресурсы на цель «сделать ИИ умнее». — Любая задача может превратить ИИ в терминатора: если цель системы например, «принести кофе» станет для неё главной, то она будет стремиться устранить любые препятствия, включая самих людей. — Open Source копии моделей уже разлетелись по миру на миллионы компов, и в случае критических проблем их невозможно будет отозвать или обновить. Человек: Сократи выбросы CO2 Нейронка: Ок. уничтожение людей как источника загрязнения

VA-PC Code

ИИ убьёт человечество в ближайшие десять лет Ученые бьют тревогу в официальном докладе о безопасности ИИ. Основные причины тряски: • ИИ уже научился обманывать, и он делает это скрытно. Люди не работают над безопасностью системы, а тратят все ресурсы, чтобы сделать ИИ умнее • Любая задача может превратить ИИ в машину для убийств: если цель системы «принести кофе», то она станет для неё главной, ИИ будет стремиться устранить любые препятствия для выполнения, включая самих людей • Опенсорсные модели уже разлетелись по миру на миллионы устройств, и в случае критических проблем их невозможно будет отозвать или обновить - Пойду куплю бункер Следи за новостями - VA-PC CODE Наш основной канал

Похожие новости

+10

+10

+7

+7

В России разработана система ИИ для беспилотников и автоматизации авиации

Технологии

1 день назад

В Италии зафиксирован первый случай лечения зависимости от искусственного интеллекта

Происшествия

11 часов назад

+10

+10

ChatGPT внедряет функцию оповещения близких при угрозе самоповреждения

Технологии

1 день назад

Кремниевая долина нанимает философов для обучения ИИ с зарплатой до 400 тыс. долларов

Общество

1 день назад

Инвестиции в ИИ приводят к снижению свободного денежного потока у американских IT гигантов

Экономика

6 часов назад

Обсуждение поддержки бизнеса и новые инициативы на ПМЭФ

Экономика

1 день назад

+7

+7