11 февраля, 17:24

Искусственный интеллект генерирует фейковые научные статьи и вымышленных учёных

Банки, деньги, два офшора

Тысячи ложных научных статей появились в интернете из-за нейросеток. ИИ сам создаёт фейковых учёных и указывает источники, которых не существует. Такие «учёные» пишут статьи на серьёзные темы, от сельского хозяйства до медицины.

Банкос | Инвестиции и Финансы

Из-за развития нейросетей в интернете появились тысячи фейковых научных статей. Искусственный интеллект самостоятельно генерирует вымышленных учёных и ссылается на несуществующие источники. Более того, такие «учёные» публикуют статьи на серьёзные темы, охватывающие области от сельского хозяйства до медицины.

Trend Wave

Фейковые «ученые» заполонили интернет. По данным СМИ, пользователи активно используют ChatGPT для создания научных статей без проверки фактов. Особенно опасна эта тенденция в медицине и сельском хозяйстве, где ложные данные могут привести к реальным угрозам для здоровья и продовольственной безопасности. И теперь даже настоящим специалистам бывает трудно отличить сгенерированный вариант от настоящего, даже невзирая на обилие «чуши» в тексте. Вот вам и революция.

Остренько

Нейросети делают нас ТУПЕЕ — официально. Microsoft вместе с университетом Карнеги-Меллона провели исследование с НЕ ОЧЕНЬ утешительными результатами — люди, использующие ИИ в работе, теряют свои когнитивные навыки. Если коротко: — Наше восприятие информации меняется с «найти информацию» на «проверить, что написал GPT». То есть, вместо сегментации и анализа остается только фактчек; — Со временем пользователи начинают доверять ИИ и не проверяют инфу от него; — Решение проблем все чаще сводится к тому, как правильно адаптировать ответ ChatGPT к сути задачи. Вывод: всегда проверяйте, что вам пишет ChatGPT, или чем вы там пользуетесь.

Банкофф • Финансы

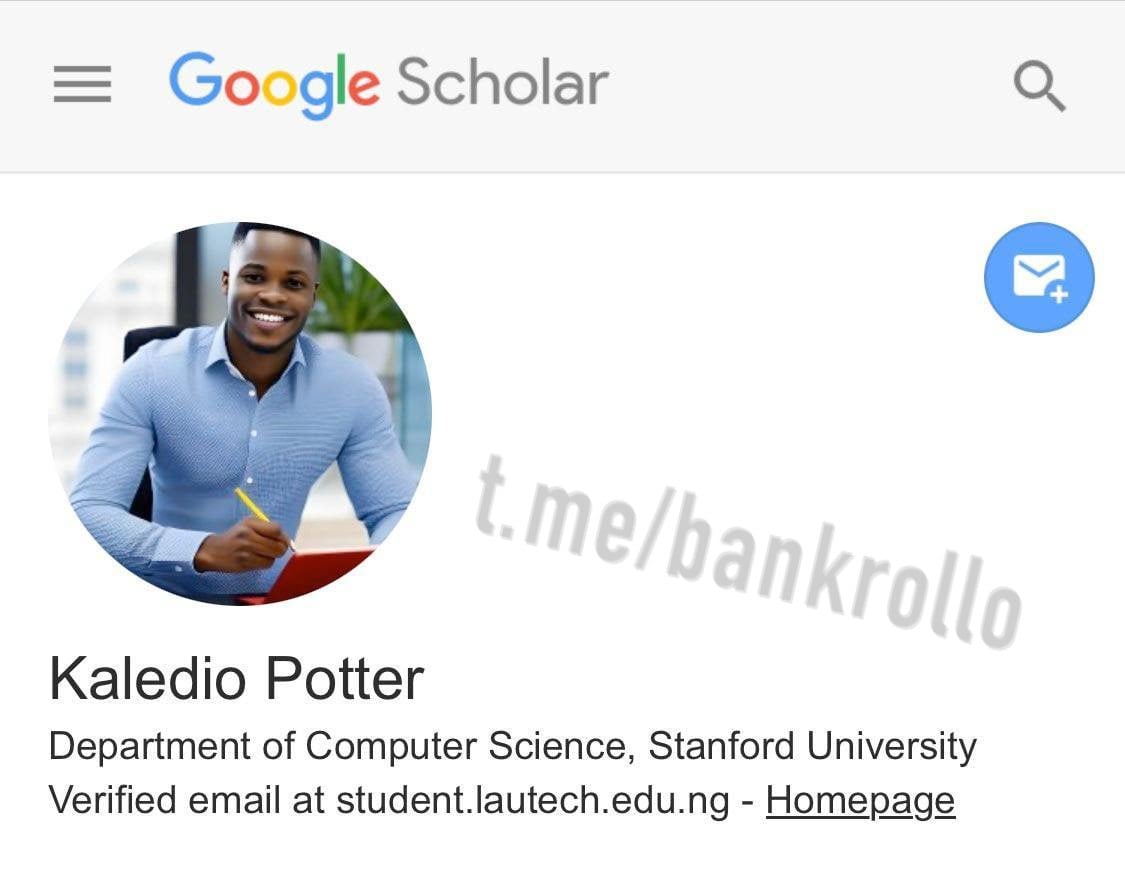

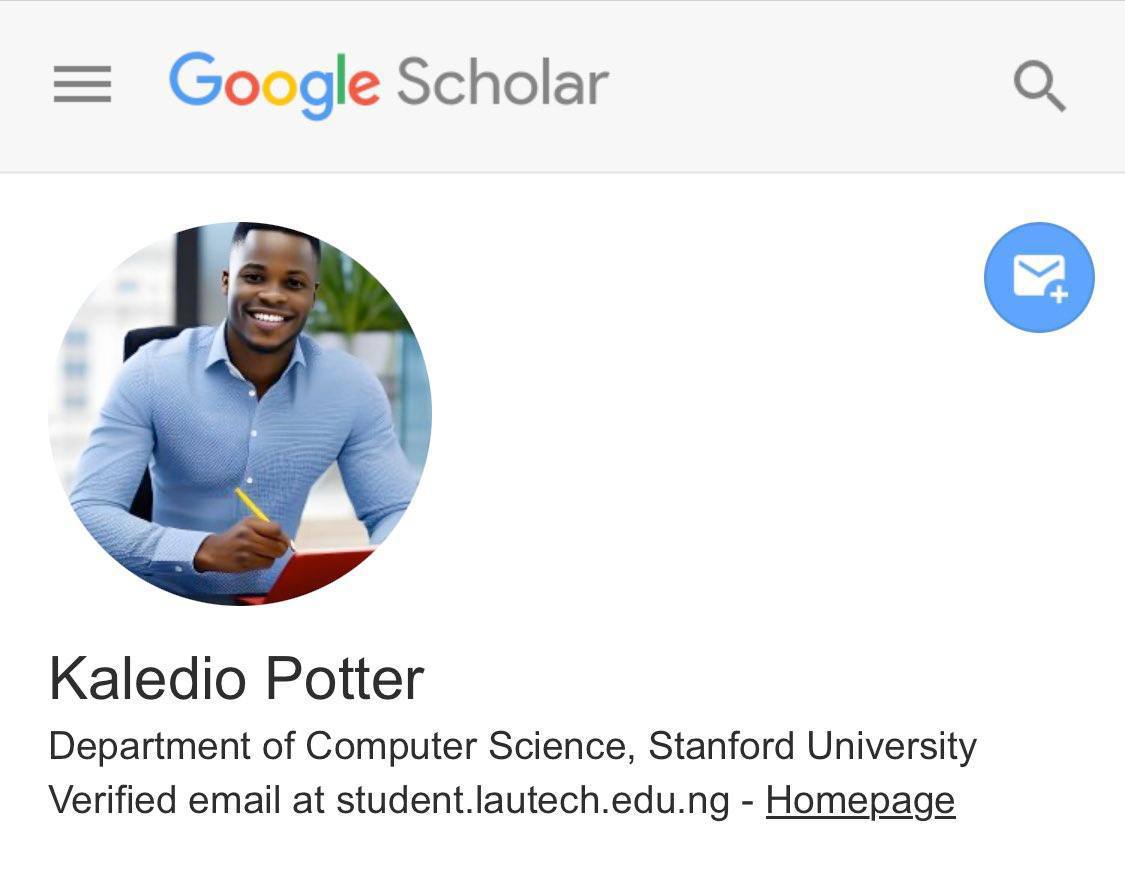

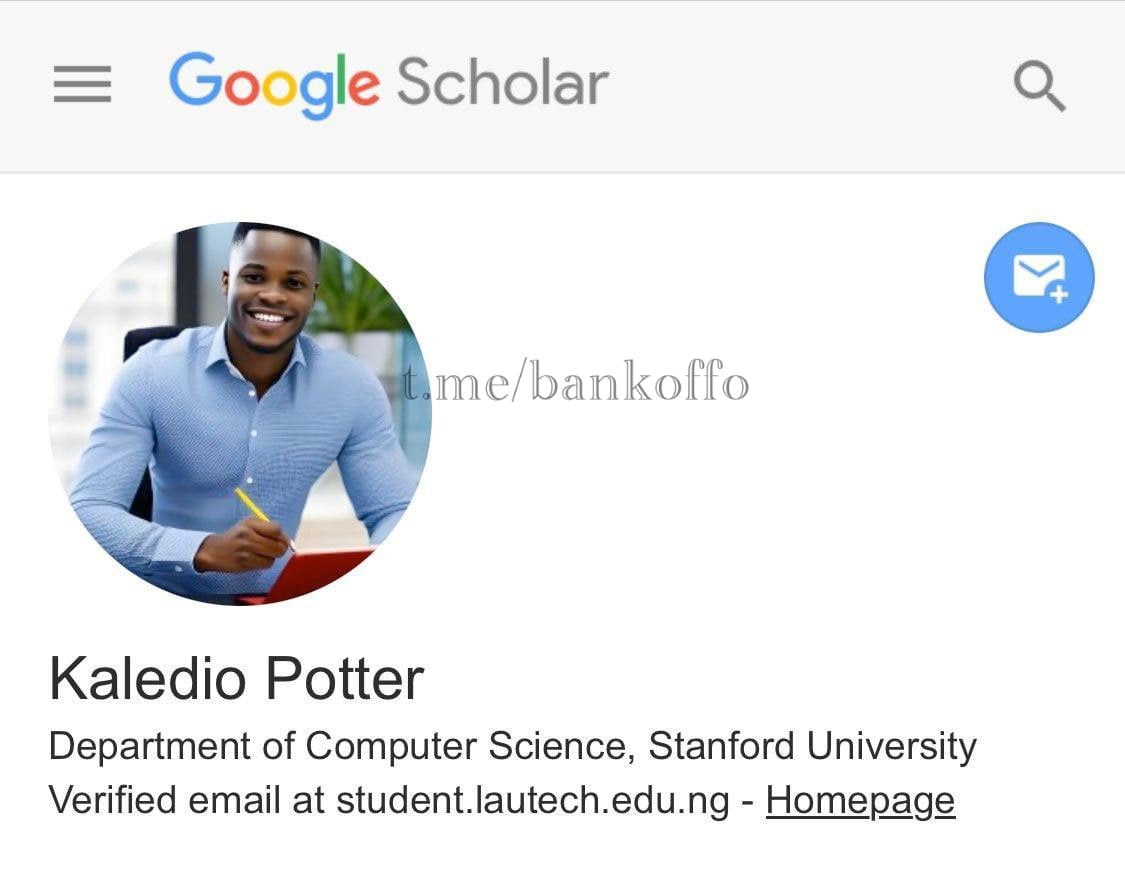

ChatGPT наводнил науку фейковыми статьями и вымышленными учёными. В Google Scholar можно найти тысячи работ, созданных ИИ — с несуществующими источниками, галлюцинациями и даже поддельными авторами. Темы исследований включают в себя самые серьёзные: медицина, технологии, сельское хозяйство.

Кибер Дача 🕹️

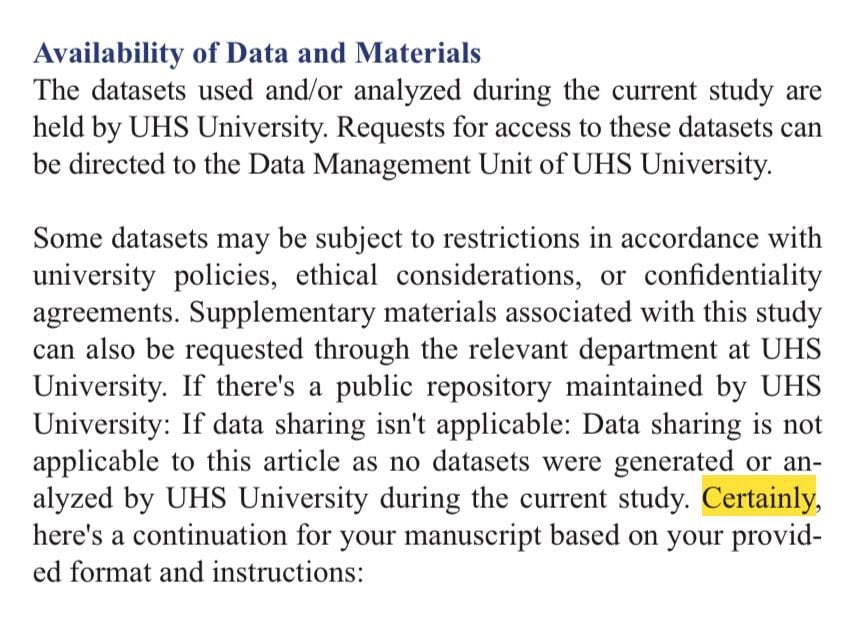

ChatGPT стали использовать в научных исследованиях так часто, что интернет заполнился множеством статей, содержащих фальшивую и вымышленную информацию, предоставленную искусственным интеллектом. Это можно легко проверить: достаточно зайти на Google Scholar и ввести в поисковую строку популярную фразу ChatGPT: «Certainly, here’s». Вы обнаружите множество "исследований", в написании которых принимал участие ИИ. Основные моменты: — Галлюцинации нейросетей проникли в самые важные сферы, такие как медицина, сельское хозяйство, высокие технологии и разработка устройств; — Более того, многие "авторы" подобных статей на самом деле не являются учёными, а оказываются вымышленными персонажами с фейковыми профилями и сгенерированными фотографиями; — Искусственный интеллект буквально сам создаёт исследователей, придумывает научные работы и даже сопровождает их ссылками на несуществующие источники.

Нейродвиж

Нейросети делают нас ТУПЕЕ — официально. Microsoft вместе с университетом Карнеги-Меллона провели исследование с НЕ ОЧЕНЬ утешительными результатами — люди, использующие И в работе, теряют свои когнитивные навыки. Если коротко: — Наше восприятие информации меняется с «найти информацию» на «проверить, что написал GPT». То есть, вместо сегментации и анализа остается только фактчек; — Со временем пользователи начинают доверять ИИ и не проверяют инфу от него; — Решение проблем все чаще сводится к тому, как правильно адаптировать ответ ChatGPT к сути задачи. Вывод: всегда проверяйте, что вам пишет ChatGPT, или чем вы там пользуетесь.

Похожие новости

+6

+6

+2

+2

Кремниевая долина нанимает философов для обучения ИИ с зарплатой до 400 тыс. долларов

Общество

21 час назад

В России разработана система ИИ для беспилотников и автоматизации авиации

Технологии

1 день назад

ChatGPT внедряет функцию оповещения близких при угрозе самоповреждения

Технологии

1 день назад

В Италии зафиксирован первый случай лечения зависимости от искусственного интеллекта

Происшествия

5 часов назад

+6

+6

OpenAI запускает рекламную платформу ChatGPT с новыми возможностями для бизнеса

Технологии

1 день назад

Китайские власти удаляют аккаунты блогеров, запрещая демонстрацию роскоши

Происшествия

1 день назад

+2

+2