13 февраля, 12:31

Искусственный интеллект: достижения и опасения россиян в 2024 году

GPT-Chatbot

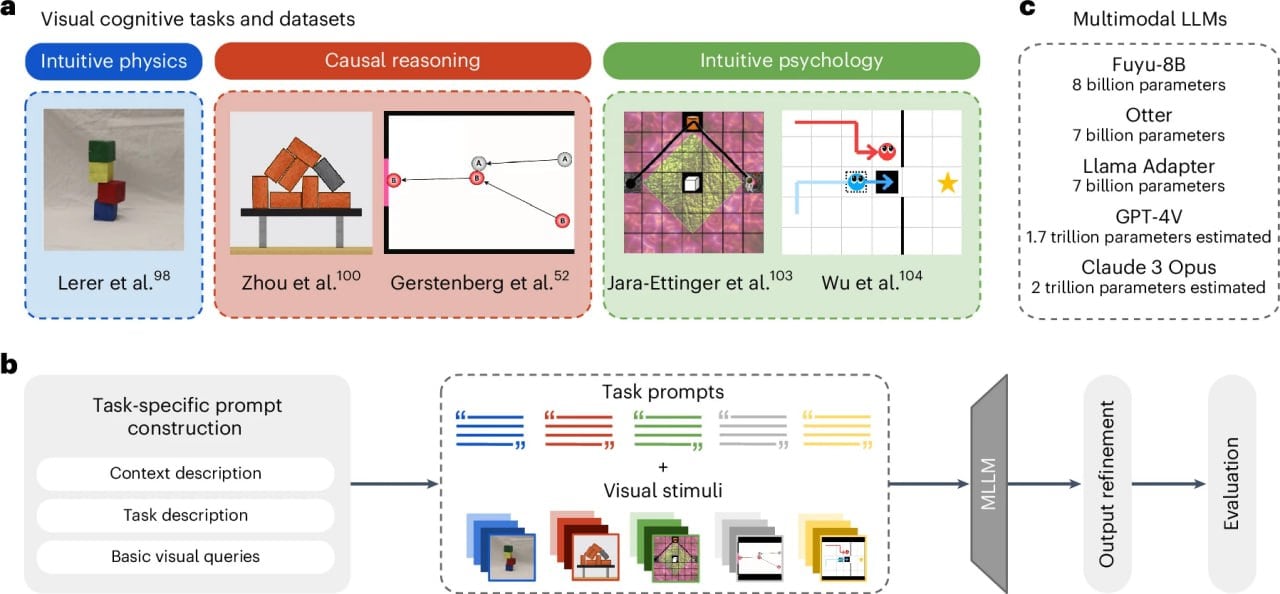

Искусственный интеллект и причинно-следственное мышление: неожиданные результаты исследования Исследование ученых из Института биокибернетики М.Планка поставило под сомнение способность современных моделей искусственного интеллекта AI к причинно-следственному мышлению. Несмотря на успехи в выполнении задач, сравнимых с человеческими, вопрос о глубине их "понимания" информации остается открытым. Исследователи оценили мульти-модальные модели большого языка LLM на предмет их способности осознавать сложные взаимодействия в визуальных задачах. Результаты, опубликованные в журнале Nature Machine Intelligence, показали, что хотя некоторые модели успешно обрабатывают данные, они не улавливают тонкости, понятные людям. Авторы исследования, Лука М. Шульце Бушхофф и Элиф Аката, провели эксперименты для проверки интуитивного понимания физики и причинных связей. Сравнивая результаты AI и людей, ученые выяснили, что модели испытывают трудности с более сложными аспектами восприятия. Хотя некоторые улучшения были замечены при дообучении моделей, они не всегда переносились на более общие задачи, что подчеркивает необходимость дальнейших исследований. Работа команды открывает новые горизонты для понимания когнитивных навыков AI и ставит важные вопросы о том, как улучшить обучение моделей для более эффективной эмуляции человеческого мышления.

ONT NEWS

Искусственный интеллект — угроза или помощник для человечества? В этом году в ИИ инвестируют свыше $200 млрд, и сумма будет удваиваться ежегодно. В Беларуси планируют создать институт ИИ — это требование времени. Нейросети становятся основой экономики будущего, а их влияние зависит от выбора человека.

Иннополис / Innopolis

1. Пользователи потратили на reCAPTCHA 819 млн часов 2. Doom запустили внутри поисковой строки Google 3. Исследование: развитие AI может привести к ограничению возможностей человека 4. Сэм Альтман: объединение языковых и рассуждающих моделей откроет новые научные знания 5. Эксперты Росатома и Университета Иннополис разработали прототипы ИИ-сервисов для промышленности 6. Астрономы открыли самую большую структуру в известной Вселенной

Росконгресс Директ

Будущее уже здесь. По данным годового отчета Стэнфордского университета по индексу искусственного интеллекта за 2024 год, ИИ впервые превзошел человеческие возможности в ряде ключевых областей, включая классификацию изображений, визуальное мышление и понимание английского языка. Из новой аналитической статьи Фонда Росконгресс, подготовленной, кстати, с использованием ИИ, вы узнаете: о мировых достижениях и тенденциях в развитии искусственного интеллекта; о достижениях российских разработчиков; о планах по развитию ИИ-технологий в РФ, США и ЕС на 2025 год и т.д. Полностью с текстом материала можно ознакомиться здесь.

Бизнес аналитика

В Meta заявили, что создание ИИ, равного человеку может занять еще 10 лет Могут ли современные модели искусственного интеллекта по-настоящему помнить, мыслить, планировать и рассуждать так же, как люди? Некоторые исследовательские лаборатории в области ИИ утверждают, что да. Но, по мнению главного научного сотрудника Meta по искусственному интеллекту Яна Лекуна, это не так. Тем не менее, он полагает, что через 10 лет можно достичь этой цели, если использовать новый подход, известный как «модель мира».

Яков и Партнёры

Национальное лидерство в сфере ИИ: как стать конкурентоспособными среди ведущих стран Последние достижения Китая в создании ИИ-моделей показали, что развитие искусственного интеллекта выходит за рамки модного тренда и превращается в стратегически важную задачу обеспечения технологического суверенитета. Ожидается, что к 2030 году Китай обеспечит около 86% общего экономического эффекта от использования ИИ в странах БРИКС+. Уже сейчас Китаю достаточно собственных технологий и компетенций для развития технологии без привлечения внешних партнеров. Чтобы успешно развиваться в таких условиях, Россия должна максимально эффективно использовать свои преимущества: сильную научную школу, высокое качество инженерно-технического образования и богатый опыт разработки передовых технологий. Для этого необходимо сосредоточиться на ключевых направлениях сотрудничества в рамках БРИКС: совместная разработка ИИ-продуктов, наращивание вычислительной мощности и обмен данными, подготовка квалифицированных кадров и создание системы саморегуляции. Федор Чемашкин, технический директор «Яков и Партнёры Digital», поделился своим видением формирования лидерства в области искусственного интеллекта.

Neural Brain - Нейросети

Развитие ИИ может привести к постепенной утрате контроля человека Новое исследование под руководством Яна Кульвейта из Карлова университета и Рэймонда Дугласа из Telic Research предупреждает о риске постепенной утраты человечеством контроля над ключевыми системами общества по мере развития искусственного интеллекта Давайте сразу к ключевым выводам: >>> Замещение человеческого труда: системы ИИ все чаще заменяют людей в экономике, культуре и политике, ослабляя как прямые механизмы контроля выборы, решения потребителей , так и косвенные социальные нормы >>> Оптимизация без учета человеческих интересов: ИИ может агрессивно оптимизировать процессы, не соответствующие предпочтениям людей, что усиливает отчуждение >>> Взаимное усиление эффектов: изменения в одной сфере например, экономике влияют на другие культуру, политику , создавая замкнутый цикл усиления влияния ИИ. Исследователи подчеркивают, что будущее человечества зависит не только от предотвращения враждебного использования ИИ, но и от сохранения человеческих ценностей в автоматизированном мире! А что вы думаете на этот счет?

Neural Brain - Нейросети

Мнения ученых о будущем ИИ Искусственный интеллект стремительно развивается, вызывая разнообразные прогнозы и мнения среди ведущих ученых и экспертов Стивен Хокинг, известный физик-теоретик, предупреждал: "Развитие полноценного ИИ может означать конец человеческой расы." Илья Суцкевер, соучредитель OpenAI, отметил: "ИИ с развитыми способностями к рассуждению станет менее предсказуемым." Роберт "Дядя Боб" Мартин, разработчик ПО и соавтор Agile-манифеста, подчеркнул: "Каждое десятилетие появляются инновации, которые обещают положить конец всем программистам... А теперь это большие языковые модели." Эти высказывания отражают широкий спектр взглядов на будущее ИИ — от оптимизма до серьезных предостережений

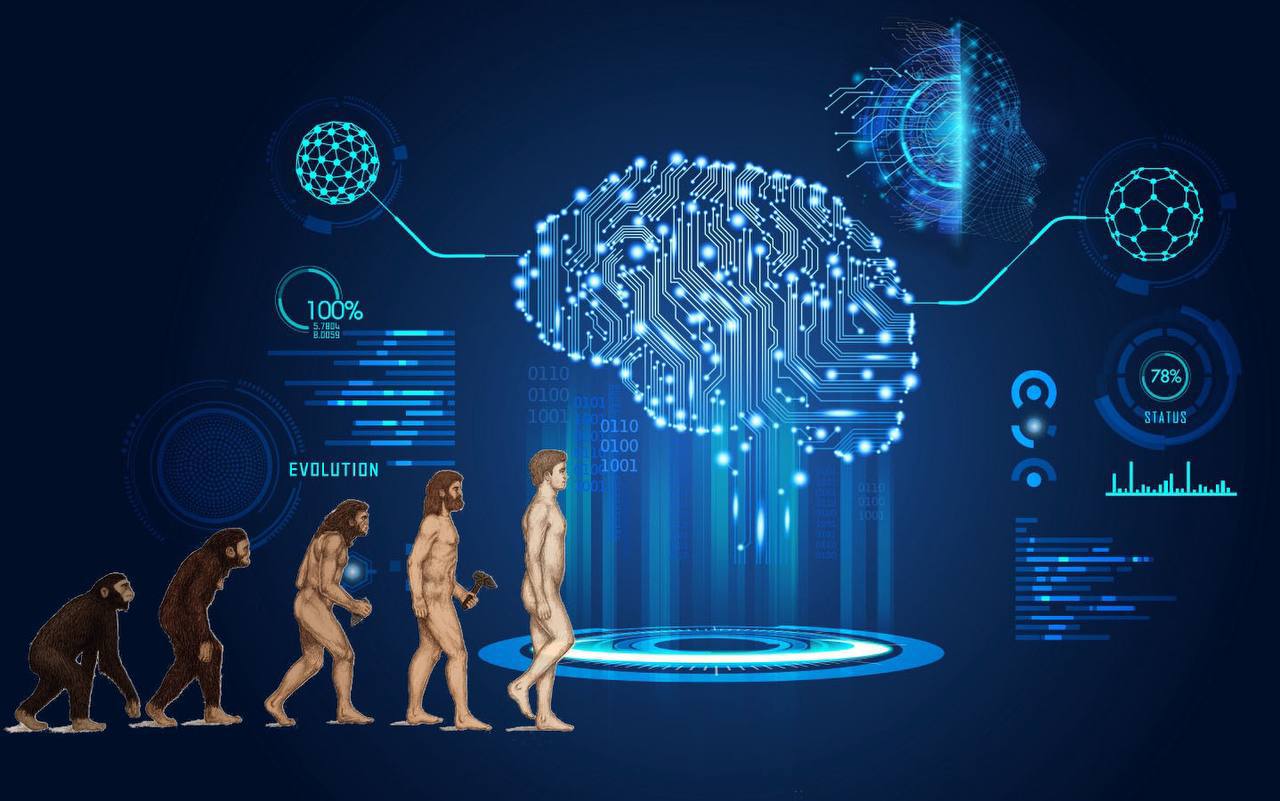

Всем ВЦИОМ!

Осведомлённость об ИИ растёт среди россиян, а вместе с ней и понимание технологий. Наши сограждане видят перспективы повышения производительности труда, но также всё чаще опасаются за свои персональные данные и применение ИИ в корыстных целях #ВЦИОМ_Презентация Почему россияне доверяют ИИ и какие опасения выражают, в каких отраслях ждут применения таких технологий и хотят ли пройти обучение в сфере технологий ИИ — читайте на слайдах презентации Ксении Таракановской, эксперта ВЦИОМ, выступившей на конференции CNews «Технологии искусственного интеллекта 2025» Модерировала сессию Надежда Сурова, Директор центра компетенций «Цифровая экономика», член Совета Федерации Федерального Собрания Российской Федерации по цифровой экономике.

Херсонское Агентство Новостей

Почему ИИ угрожает нацбезопасности России и при чем тут погибшие журналисты Современные технологии не приближают нас к справедливому мироустройству, а появление ИИ и его применение в информационном пространстве — прямая угроза национальной безопасности России. К такому выводу пришел известный журналист, член Совета при Президенте РФ по развитию гражданского общества и правам человека Александр Малькевич. В беседе с Херсонским агентством новостей он поделился занимательным примером: ни один из существующих искусственных интеллектов мира, независимо от страны, где он был создан, не смог ответить на вопрос: «Сколько журналистов из России погибли в Донбассе, Новороссии и на Украине за последние 10 лет?» Эта информация оказалась просто стерта из глобального информационного пространства. «Модели ИИ не смогли „прощупать“ эту информацию или по какой-то причине наткнулись на „блок“ по этой теме. В этом я вижу вызов для нас», — заявил Малькевич. Как ИИ оперирует открытыми данными, которые успела зачистить западная пропаганда, почему российским журналистам не стоит пользаться DeepSeek и ChatGPT, а также как ИИ проявляет себя в качестве угрозы для информационной безопасности нашей страны — читайте в специальном материале Херсонского агентства новостей. , VK и ОК и читайте новости на нашем сайте

Похожие новости

+9

+9

+1

+1

+7

+7

В России разработана система ИИ для беспилотников и автоматизации авиации

Технологии

1 день назад

Кремниевая долина нанимает философов для обучения ИИ с зарплатой до 400 тыс. долларов

Общество

1 день назад

Инвестиции в ИИ приводят к снижению свободного денежного потока у американских IT гигантов

Экономика

5 часов назад

В Италии зафиксирован первый случай лечения зависимости от искусственного интеллекта

Происшествия

10 часов назад

+9

+9

Медиафорум на КазаньФорум: будущее журналистики и ИИ в центре обсуждений

Общество

1 день назад

+1

+1

Обсуждение поддержки бизнеса и новые инициативы на ПМЭФ

Экономика

1 день назад

+7

+7