23 апреля, 16:40

Google представляет AI Hypercomputer с новыми чипами TPU 8t и TPU 8i для ИИ

Редакционное саммари

Google анонсировала новое поколение чипов TPU 8t и TPU 8i, предназначенных для оптимизации работы с искусственным интеллектом. Эти процессоры разделяют функции обучения и инференса, что позволяет более эффективно обрабатывать запросы к ИИ моделям и отвечает на растущий спрос на вычислительные мощности в этой области.

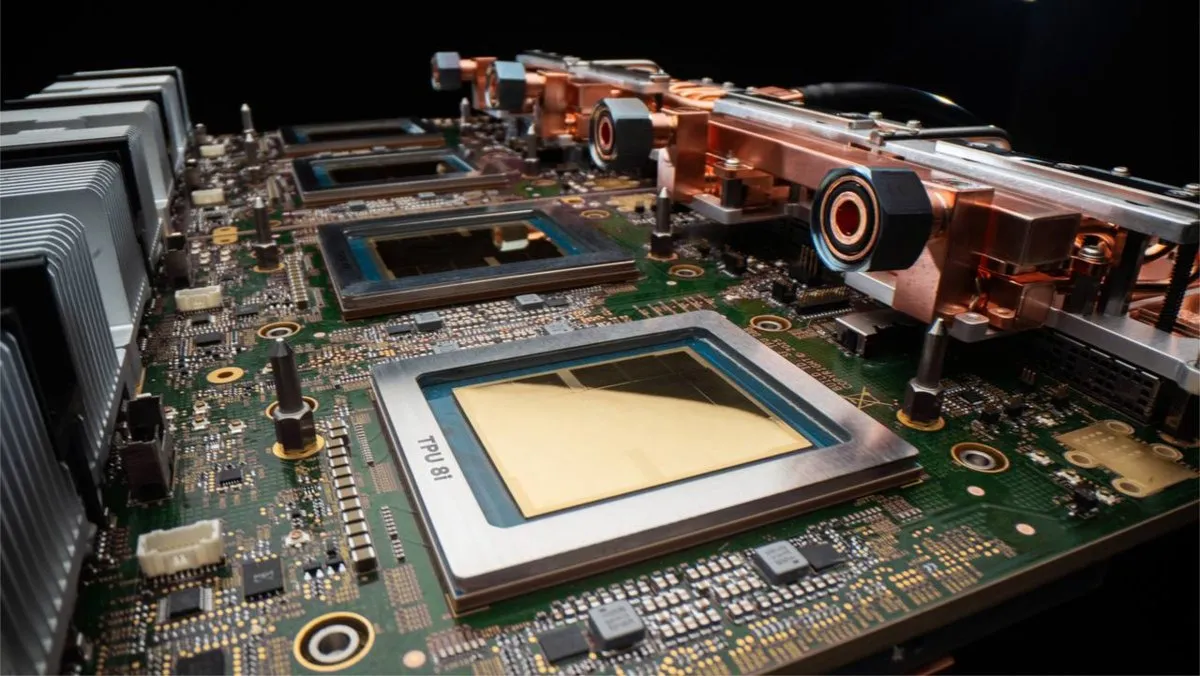

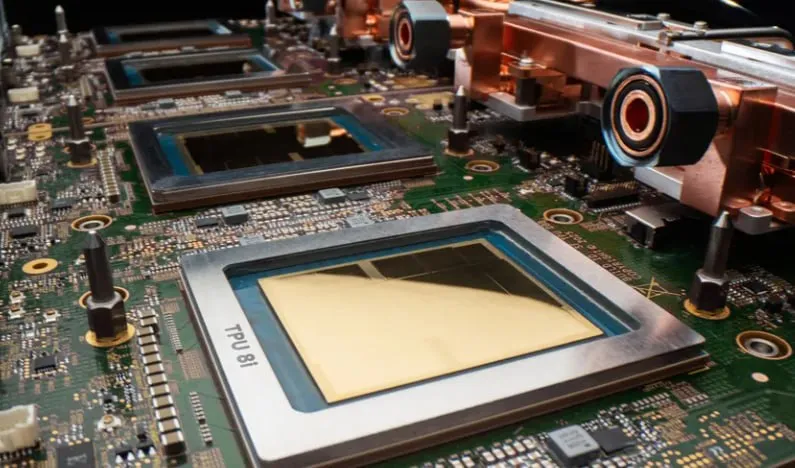

Чип TPU 8t, ориентированный на обучение, демонстрирует впечатляющую производительность до 121 экзафлопса и способен масштабироваться до 9600 чипов в одном кластере. Его эффективность достигает 97%, что означает минимальные потери времени на сбои и задержки. В свою очередь, TPU 8i, предназначенный для инференса, предлагает 288 ГБ оперативной памяти и 384 МБ встроенной SRAM, что позволяет значительно улучшить производительность на доллар и обрабатывать почти вдвое больше запросов. Обе модели поддерживают различные фреймворки, такие как JAX и PyTorch, что упрощает переход разработчиков с других платформ.

С запуском AI Hypercomputer Google создает новую инфраструктуру для ИИ, объединяющую TPU 8t и TPU 8i с другими компонентами, такими как Axion CPU и сеть Virgo. Это решение направлено на предоставление корпоративным клиентам комплексной платформы для обучения и инференса, что может изменить подход к использованию суперкомпьютеров. В результате Google стремится занять лидирующие позиции на рынке облачных ИИ решений, предлагая не просто оборудование, а целостные системы, способные удовлетворить потребности современных ИИ приложений.

vc.ru

Google представила восьмое поколение своих чипов TPU TPU 8t и TPU 8i разработанных для эпохи ИИ агентов Чип TPU 8i оптимизирован для инференса обработки запросов к ИИ моделям Спрос на такие вычисления растёт из за внедрения ИИ агентов vc ru ai 2881411

Изобретая будущее

Google наконец разделила обучение и вывод ИИ моделей между разными чипами Google представила TPU 8t и TPU 8i два специализированных процессора вместо одного универсального Это не просто обновление это признание того что одной платформы для всех ИИ нагрузок уже недостаточно Один чип обучает гигантские модели на тысячах ускорителей одновременно другой экономно обслуживает их в продакшене 24 7 Разделение труда пришло и в мир железа TPU 8t выдает до 121 экзафлопса мощности и масштабируется до 9600 чипов в одном кластере Самое важное goodput выше 97 то есть практически все время система работает полезно а не теряется на сбои и задержки Для сравнения предыдущее поколение Ironwood дает в три раза меньше производительности на один модуль TPU 8i пошла другим путем 288 ГБ оперативной памяти и 384 МБ встроенной SRAM держат данные максимально близко к процессору Результат 80 лучше производительность на доллар а клиенты смогут обрабатывать почти вдвое больше запросов за те же деньги Плюс поддержка Mixture of Experts только нужные части модели активируются на каждый запрос Google собирает полный стек кремний сеть софт фреймворки и облако работают как единая система Чипы поддерживают JAX PyTorch SGLang и vLLM разработчикам не нужно переписывать код чтобы перейти с Nvidia И вот это правильный ход не затвердеть в корпоративной экзотике а стать реальной альтернативой SciTechQuantumAI

InterLink - СБОРКИ ИГРОВЫХ ПК / НОВОСТИ

Google перевела ИИ инфраструктуру в новый класс и назвала его гиперкомпьютером Google представила AI Hypercomputer новую платформу для обучения и инференса где в один стек собрали TPU 8 го поколения Axion CPU сеть хранилище и будущие системы NVIDIA Vera Rubin В основе платформы лежат TPU 8t и TPU 8i первая версия рассчитана на обучение больших моделей вторая на инференс и агентные сценарии TPU 8t может масштабироваться до суперпода на 9600 чипов и 2 ПБ общей быстрой памяти а TPU 8i получила 288 ГБ HBM и 384 МБ встроенной SRAM В эту же инфраструктуру Google добавляет Axion Arm CPU сеть Virgo и Managed Lustre то есть речь уже не про отдельный ускоритель а про целый ИИ комплекс Отдельно Google подтвердила что одной из первых предложит в облаке системы NVIDIA Vera Rubin NVL72 Главный смысл AI Hypercomputer в том что Google хочет продавать корпоративным клиентам не просто железо под ИИ а готовую базу под агентные системы обучение и масштабный инференс Компания уже прямо двигает рынок от обычных суперкомпьютеров к более цельной ИИ инфраструктуре где вычисления память сеть и софт проектируются как единая система AI Hypercomputer это реально новый этап для облачного ИИ или просто более громкое имя для старой идеи Наши каналы Участвуй в конкурсе Gооglе

Innovation & Research

Google представила специализированные чипы TPU 8t и TPU 8i для разделения задач обучения и инференса AI моделей Анонс состоялся на конференции Google Cloud Next а общий релиз запланирован на конец 2026 года Эти процессоры разработаны для платформы AI Hypercomputer и поддержки различных задач от обучения передовых моделей до работы AI агентов в производственной среде TPU 8t оптимизирован для обучения LLM и имеет в 3 раза более высокую производительность по сравнению с предыдущим поколением Ironwood Один суперпод может масштабироваться до 9600 чипов и обеспечивать 121 экзафлопс вычислительной мощности Системы обучения также получили улучшенный доступ к хранилищу и сетевые обновления для минимизации простоев с целевым показателем полезной пропускной способности более 97 Это значительно сокращает задержки при обучении сложных AI систем TPU 8i сфокусирован на инференсе включая 288 ГБ высокоскоростной памяти и 384 МБ встроенной SRAM для ускорения ответов Он использует процессоры Axion на архитектуре Arm и повышенную пропускную способность соединений для моделей Mixture of Experts MoE что позволяет активировать только части LLM для снижения затрат По данным Google TPU 8i обеспечивает на 80 лучшее соотношение производительности к стоимости чем предыдущее поколение позволяя обрабатывать почти вдвое больший объём работ при тех же затратах Соотношение производительности к потребляемой мощности у чипов по сравнению с Ironwood выше практически в два раза благодаря использованию жидкостного охлаждения четвёртого поколения для поддержки высокой плотности вычислений Запуск подчёркивает сдвиг в AI инфраструктуре от универсальных GPU к специализированным чипам а также стремление Google конкурировать с Nvidia в аппаратном обеспечении AI TPU 8t и TPU 8i будут доступны через Google Cloud и поддерживают фреймворки такие как JAX PyTorch SGLang и vLLM что упрощает миграцию без значительных изменений в программном обеспечении news чипы interestingengineering com ai robotics google tpu 8t 8i ai chips launch

Похожие новости

+4

+4

+8

+8

Apple рассматривает производство чипов в США с Intel и Samsung

Технологии

1 день назад

+4

+4

Дженсен Хуанг: Искусственный интеллект создает рабочие места в новых отраслях

Технологии

1 день назад

Selectel запускает новое юрлицо для развития ИИ и инвестирует 10 млрд рублей в экосистему

Технологии

17 часов назад

Google анонсировала The Android Show с обновлениями Android 17 на 12 мая

Технологии

17 часов назад

Apple анонсирует возможность выбора сторонних ИИ моделей в iOS 27

Технологии

23 часа назад

OpenAI анонсировала новую модель GPT 5 5 Instant для всех пользователей ChatGPT

Технологии

1 день назад

+8

+8