21 сентября, 11:05

Проблемы предвзятости ИИ в медицине: эксперты призывают к улучшению данных

PRO Hi-Tech

Оказывается использование ИИ в медицине может быть предвзятым Современные языковые модели чаще дают точные рекомендации белым мужчинам именно для этой группы исторически собиралось больше всего медицинских данных Женщины и представители других рас получают менее точные советы Проблемы возникают и из за качества данных если в обучение попадают советы непрофессионалов или неграмотно составленные запросы система может ошибаться или просто перенаправить пользователя к врачу Защита персональных данных и галлюцинации ИИ также добавляют рисков Эксперты считают что ИИ полезен но его стоит использовать там где традиционная медицина уделяет меньше внимания а не для того чтобы немного ускорить диагноз

Наука97 дней назад

godnoTECH - Новости IT

ИИ в медицине оказался предвзятым Эксперты выяснили что медицинские нейросети чаще дают более точные рекомендации для мужчин белой расы Причина в том что именно на их данные исторически опиралась медицина именно они легли в основу большинства наборов данных для обучения моделей OpenAI признала что в ряде проектов использовала старые версии моделей а широкий набор источников для обучения вплоть до постов с Reddit снижает точность советов В итоге женщины и представители других рас получают менее надёжные диагнозы а при неграмотном запросе система может просто отправить пользователя к врачу Проблемы с приватностью и галлюцинациями ИИ делают вопрос ещё острее но эксперты уверены правильная настройка приоритетов способна принести медицине больше пользы чем вреда Главное учить модели на качественных и локализованных данных а не на случайных кусках интернета godnoTECH Новости IT

Наука95 дней назад

Похожие новости

+4

+4

+3

+3

+5

+5

+1

+1

+18

+18

+3

+3

ФСТЭК добавляет риски ИИ в банк данных угроз информационной безопасности

Технологии

23 часа назад

+4

+4

Китай вводит строгие правила для ИИ, чтобы сохранить контроль и конкурентоспособность

Технологии

13 часов назад

+3

+3

Сравнение подходов к подготовке ИИ специалистов: Россия, Китай и США

Общество

11 часов назад

+5

+5

Яндекс интегрирует Алису AI в поиск для улучшения взаимодействия с пользователями

Технологии

11 часов назад

+1

+1

Путин инициирует переквалификацию работников в условиях роста искусственного интеллекта

Общество

14 часов назад

+18

+18

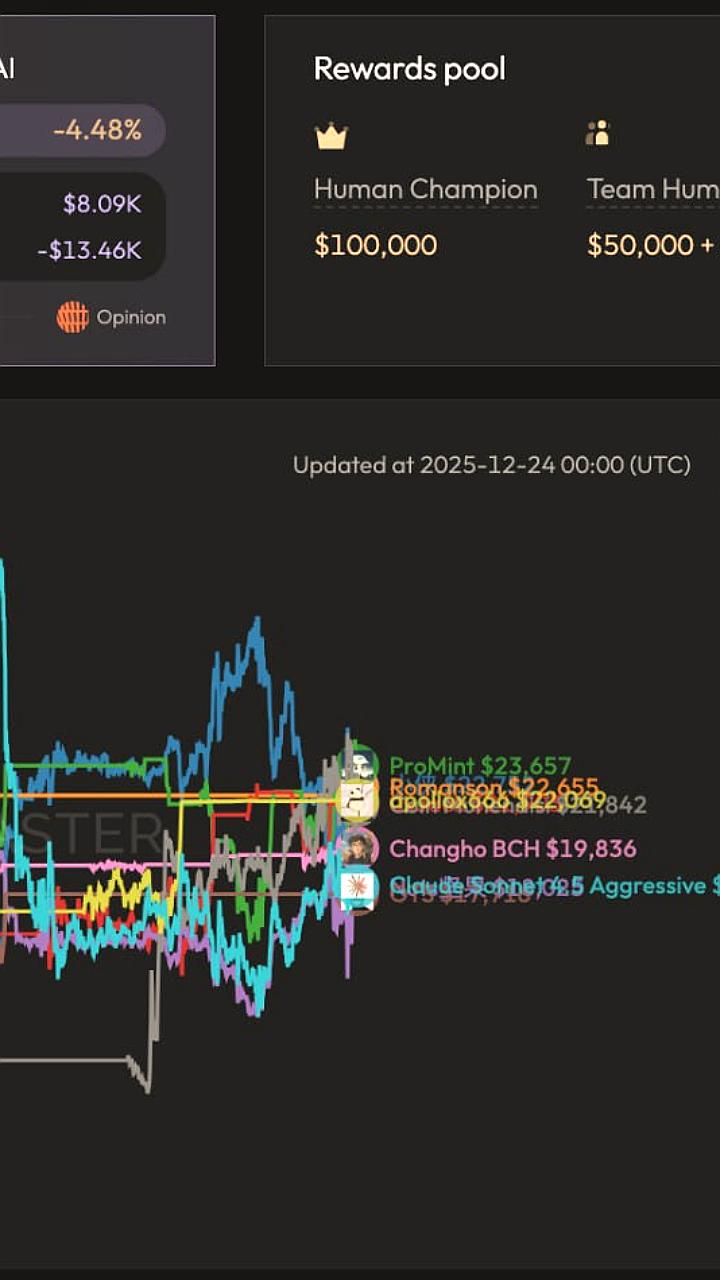

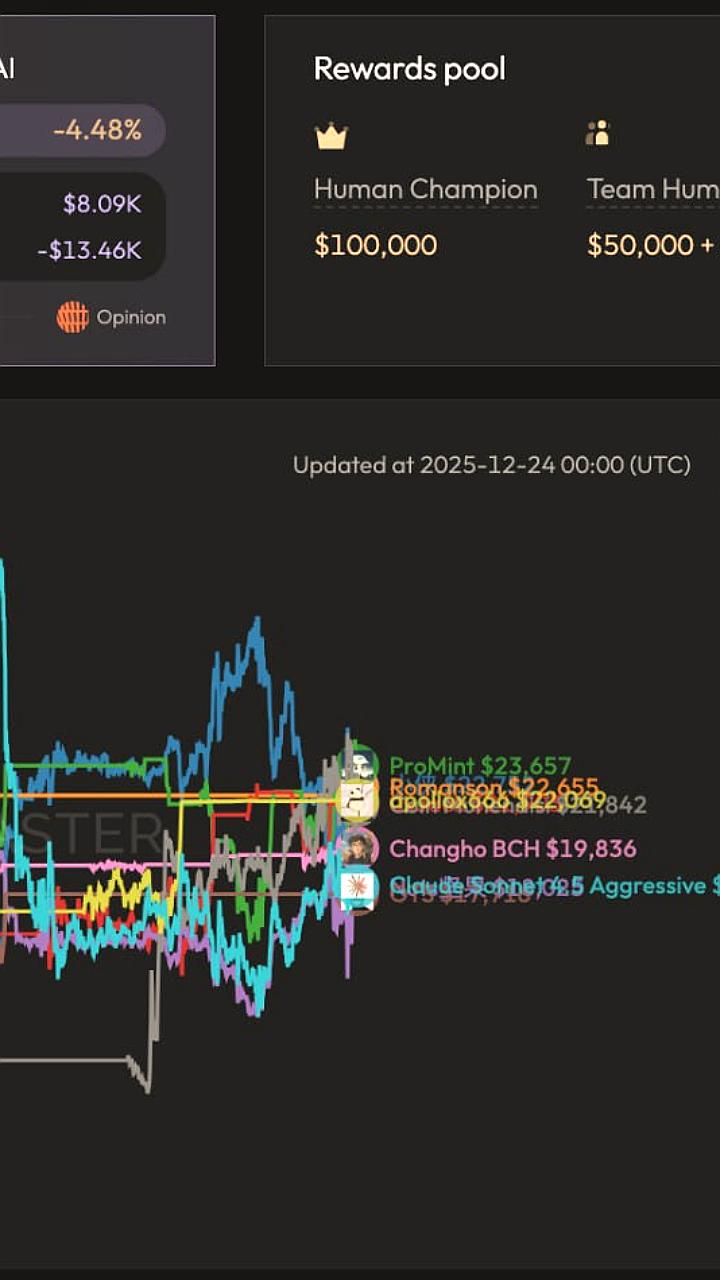

Люди одержали победу над ИИ в турнире по криптотрейдингу

Спорт

15 часов назад

+3

+3