11 апреля, 08:41

DeepSeek и Университет Цинхуа представляют новый метод улучшения ИИ-моделей

Хайтек+

DeepSeek усилила «мышление» ИИ с помощью нового подхода Китайский стартап представил новый метод обучения больших языковых моделей, который улучшает их способности к рассуждению. Комбинируя генеративное моделирование вознаграждений GRM и самообучающуюся систему критической настройки, исследователи добились более точных и логичных ответов ИИ на общие и сложные запросы. На фоне слухов о скором релизе DeepSeek-R2 компания продолжает развивать собственные технологии и открывать исходный код.

My Gadget - тесты гаджетов и бытовой техники

ИИ учится сам себя улучшать: китайцы решили переплюнуть всех Что происходит: • Китайский стартап DeepSeek создал ИИ, который сам себя учит и улучшает • Модель уже обходит Gemini и GPT-4o в сложных задачах • Самое интересное — код будет открытым! Как это работает: Представьте, что у вас в голове сидит учитель, который постоянно проверяет вашу работу и ставит оценки. Только это не человек, а часть того же ИИ. Круто? Да. Немного жутко? Тоже да. Почему это важно: • ИИ будет умнее помогать людям • Боты станут адекватнее отвечать • Медицина и наука получат мощного помощника Но есть нюанс: Бывший CEO Google уже предлагает сделать “выключатель” на случай, если ИИ решит захватить мир. Видимо, Терминатор не на шутку напугал всех топ-менеджеров. Что дальше: DeepSeek обещает раскрыть все детали и запустить публичное тестирование. Пока остальные гиганты только думают, китайцы решили показать, что такое настоящая технологическая наглость. — Китайцы, красавцы — Кнопка полного выключения и пугает

Техно Радар | Технологии, будущее, web3

DeepSeek придумал, как повысить эффективность ИИ-моделей с помощью самообучения Китайский стартап DeepSeek прославился в начале года, выпустив рассуждающую модель R1, которая смогла конкурировать с ИИ-моделями американских технологических гигантов, несмотря на скромный бюджет. Теперь DeepSeek опубликовал в сотрудничестве с исследователями университета Цинхуа статью с подробным описанием нового подхода к обучению моделей с подкреплением, позволяющего значительно повысить их эффективность. Об этом сообщил ресурс SCMP. #deepseek #llm #искусственныйинтеллект

Вторжение

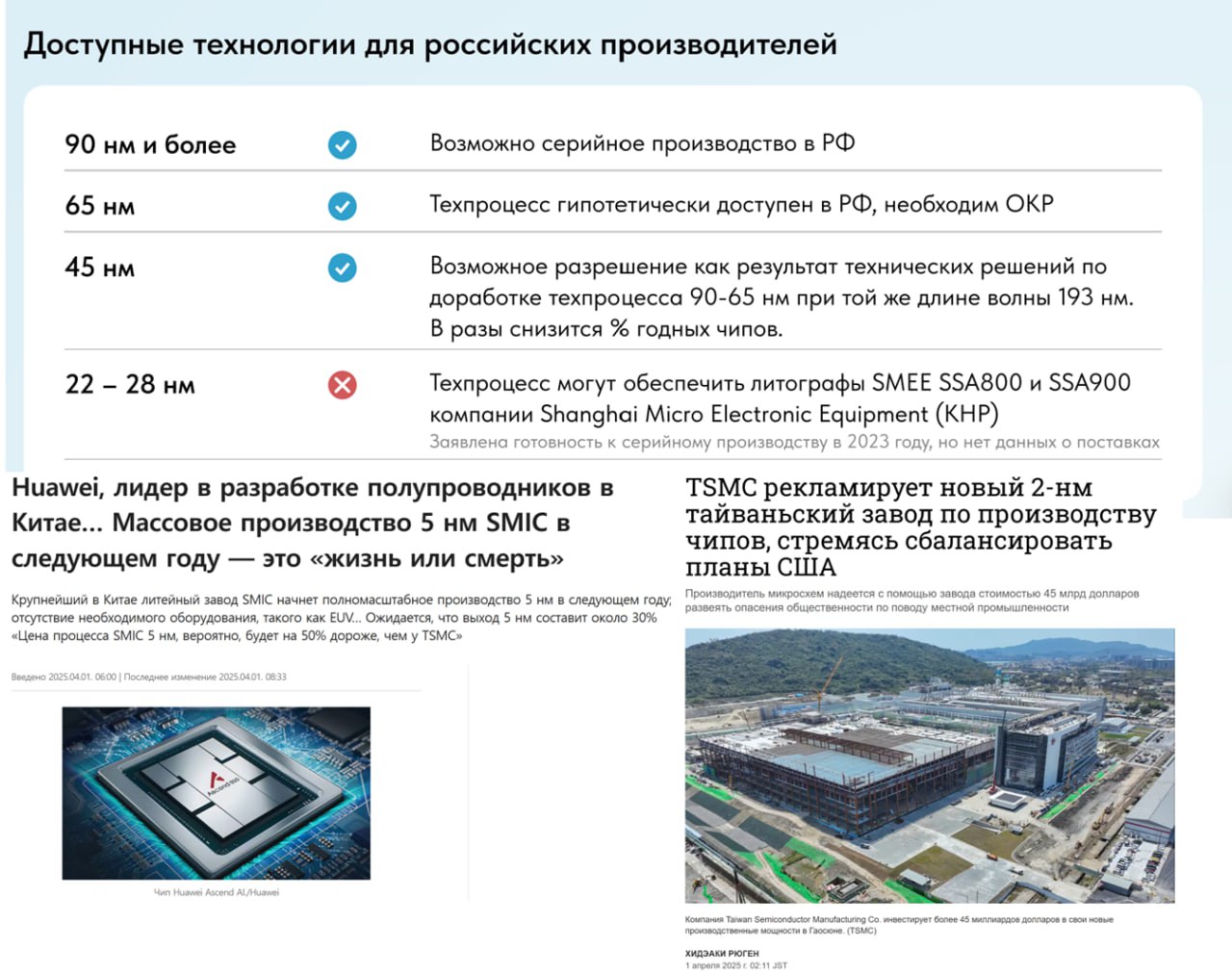

Россия отстает в микросхемах для ИИ от Китая – в 13 раз, а от Запада – в 33 раза. И это, увы, не первоапрельская шутка. В 2024 стало окончательно ясно, как по гамбургскому счету оценивать потенциальные возможности стран по развитию своих ИИ-технологий. Сформулированная мною еще в 2021 формула “Есть «железо» - участвуй в гонке. Нет «железа» - кури в сторонке” дает исчерпывающий ответ о потенциале развития ИИ на ближайшие годы. И даже «эффект» DeepSeek» здесь ничего не изменил. Так что по гамбургскому счету, как и сказано выше: • В ближайшие годы России, в лучшем случае, светит доступ к технологиям массового производства микрочипов 65 нм сейчас 90 нм • У Китая же будет свое массовое производство микрочипов 5 нм • А на Запад будут работать не только новые заводы в США, но и новый тайваньский завод для массового производства микрочипов 2 нм «чтобы сбалансировать планы США» и не бросить Тайвань на съедение сами знаете кому Что тут поделаешь, дабы безнадежно не отстать? Остается только задействовать скрытый потенциал русского ИИ для преодоления отставания от США и Китая. #ИИ #Китай #США

Хлебни ИИ - про искусственный интеллект

DeepSeek представила инновационный метод самообучения для повышения эффективности ИИ В сотрудничестве с исследователями из университета Цинхуа, DeepSeek разработала подход, основанный на обучении с подкреплением, который позволяет моделям лучше соответствовать ожиданиям пользователей, вознаграждая их за точность и понятность ответов. Хотя обучение с подкреплением ранее демонстрировало успех в узкоспециализированных задачах, его применение в более широком контексте оказалось сложной задачей. DeepSeek предложила решение, объединив генеративное моделирование вознаграждения GRM и самокритичную настройку. Представленный метод, как утверждается, значительно улучшает возможности рассуждения больших языковых моделей LLM , превосходя существующие подходы по результатам тестов и обеспечивая высокую производительность при сниженных вычислительных затратах. Новая модель получила название DeepSeek-GRM Generalist Reward Modeling . Компания планирует открыть исходный код новых моделей, но точная дата релиза пока не объявлена.

был бы ты человек - IT, digital

DeepSeek придумал, как повысить эффективность ИИ-моделей с помощью самообучения Китайский стартап DeepSeek прославился в начале года, выпустив рассуждающую модель R1, которая смогла конкурировать с ИИ-моделями американских технологических гигантов, несмотря на скромный бюджет. Теперь DeepSeek опубликовал в сотрудничестве с исследователями университета Цинхуа статью с подробным описанием нового подхода к обучению моделей с подкреплением, позволяющего значительно повысить их эффективность. Согласно публикации, новый метод направлен на то, чтобы помочь ИИ-моделям лучше соответствовать человеческим предпочтениям, используя механизм вознаграждений за более точные и понятные ответы. Обучение с подкреплением доказало свою эффективность в ускорении решения задач ИИ в ограниченных сферах и приложениях. Однако его использование для более общих задач оказалось не столь эффективным. Команда DeepSeek пытается решить этот вопрос, объединив генеративное моделирование вознаграждения GRM и так называемую настройку самокритики на основе принципов. Как утверждается в статье, новый подход с целью улучшения возможностей рассуждений больших языковых моделей LLM превзошёл существующие методы, что подтверждено проверкой моделей в различных тестах, и позволил получить самую высокую производительность для общих запросов при использовании меньших вычислительных ресурсов.

PROAI

DeepSeek: новый шаг к умным ИИ Китайский стартап DeepSeek совместно с Университетом Цинхуа разработал метод улучшения больших языковых моделей LLM . Новинка объединяет два подхода: моделирование вознаграждений GRM и настройку самокритики SPCT . Что это значит? Модели учатся самостоятельно оценивать свои ответы, улучшая их качество и логику. Они становятся более гибкими, эффективными и способны решать сложные задачи — от анализа данных до творческих проектов. Этот подход открывает новые горизонты для применения ИИ в медицине, финансах, образовании и других сферах. Пока модель не вышла в открытый доступ, но ее разработка обещает значительный прогресс в будущем.

Хайтек+

Отчет Стэнфорда: DeepSeek и Alibaba резко сократили отставание Китая от США в области ИИ Китай догоняет США в гонке искусственного интеллекта. Согласно последнему отчету Стэнфордского института ИИ, разница в результатах ключевых тестов между китайскими и американскими моделями снизилась с двузначных показателей в 2023 году до почти нуля к концу 2024-го. Так, в тесте MMLU, оценивающем языковое понимание в условиях многозадачности, разрыв сократился с 17,5 до всего 0,3 балла. Китай стал мировым лидером по числу научных публикаций и патентов в сфере ИИ, но пока уступает США по объему частных инвестиций и количеству выпущенных флагманских моделей.

INNOVATIONS

Китай наступает на пятки США в гонке ИИ Согласно свежему отчету Стэнфорда, Китай практически свел на нет технологический разрыв с США в области ИИ. Китайские Big Tech и стартапы уже вошли в топ‑15 мира по разработке ИИ. Прорыв обеспечили модели вроде Qwen от Alibaba и DeepSeek V3 — мощные, но экономные по ресурсам.

2035. Новости НТИ

Мировая экономика подвергается чипированию Источник: Независимая газета Следующим этапом после успеха китайской модели искусственного интеллекта ИИ DeepSeek может стать прорыв Китая в сфере человекоподобных роботов. При одном условии – что в дополнение к своим достижениям в производстве механических и электронных комплектующих он решит проблему с чипами. Сейчас для государств все большее значение приобретает либо возможность обеспечивать себя чипами собственной разработки, либо умение налаживать бесперебойные поставки из других, партнерских стран. На этом фоне мировые продажи полупроводников бьют один рекорд за другим, но происходит это прежде всего за счет американского рынка. Мировые продажи чипов в феврале увеличились более чем на 17% в годовом сопоставлении. Такой бурный рост наблюдается уже десятый месяц подряд. В феврале текущего года объем мировых продаж чипов почти достиг 55 млрд долл. Это максимальное значение для февраля за всю историю наблюдений – начиная с 2005-го, сообщается в новом отчете Ассоциации полупроводниковой промышленности SIA; объединяет около 99% американских производителей полупроводниковой отрасли и примерно 66% производителей чипов из других стран . «Такой рост продаж связан в первую очередь с усилением конкуренции на рынке технологий искусственного интеллекта», – комментирует данные замдиректора Центра компетенций Национальной технологической инициативы Тимофей Воронин. В глобальную гонку в сфере ИИ вступает все больше стран, и это актуализирует вопрос о закупке чипов для совершенствования собственных технологий. «Рост продаж чипов связан с цифровой трансформацией, развитием ИИ, интернета вещей и электрификацией транспорта. Спрос подогревается потребностью в высокопроизводительных чипах для облачных вычислений, генеративного ИИ и автономных систем», – пояснил также глава отдела исследований в области ИИ Университета 2035 Ярослав Селиверстов.

Похожие новости

+17

+17

+2

+2

Инвестиции в ИИ приводят к снижению свободного денежного потока у американских IT гигантов

Экономика

1 день назад

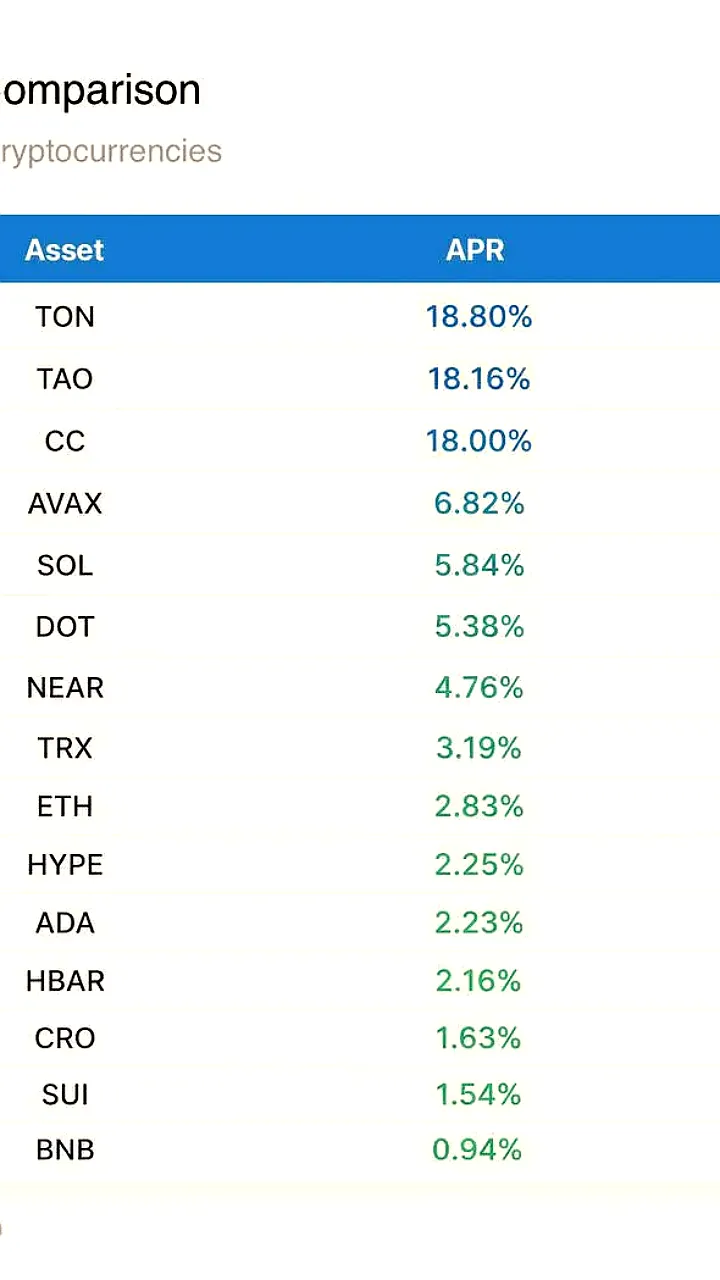

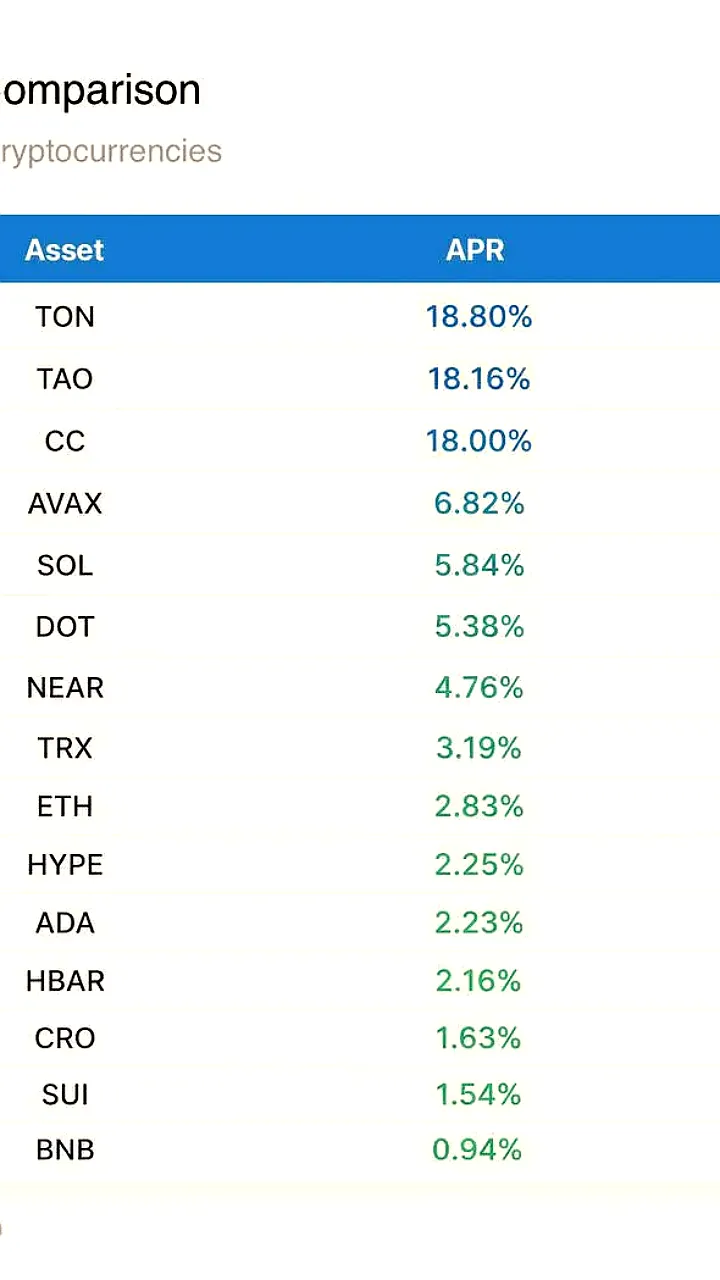

Павел Дуров анонсировал успех TON в стейкинге среди криптовалют

Экономика

1 день назад

В Италии зафиксирован первый случай лечения зависимости от искусственного интеллекта

Происшествия

1 день назад

+17

+17

Росатом и ФТС запускают проект по модернизации таможенной инфраструктуры с использованием ИИ

Политика

1 день назад

Мировые цены на продовольствие и электронику растут из-за войны в Иране

Экономика

16 часов назад

+2

+2

Исследование: Мозг продолжает воспринимать речь под наркозом

Наука

1 день назад