AI и точка.

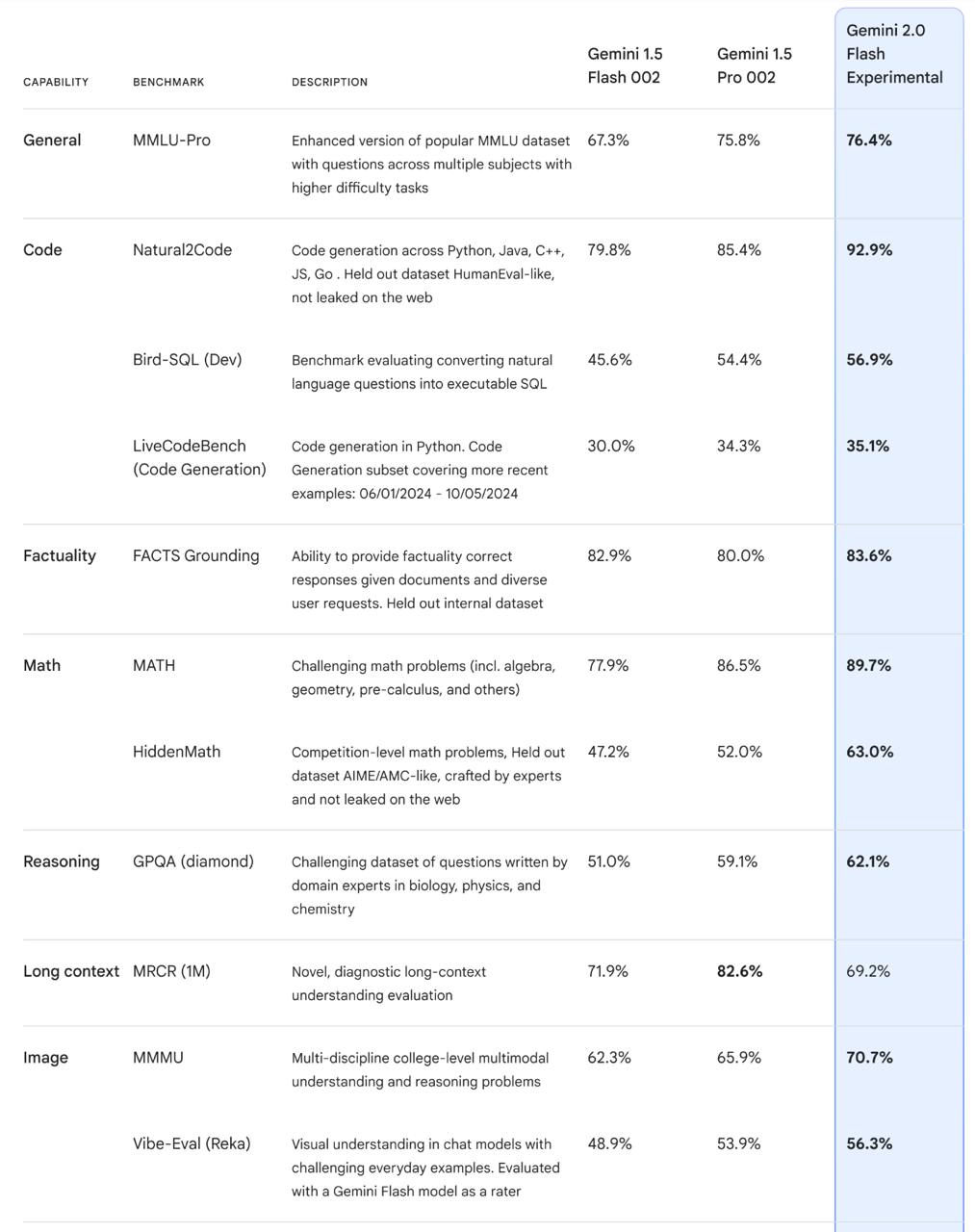

Google выпустила экспериментальную Gemini 2.0 Flash — новую версию своей сверхскоростной большой языковой модели. Попробовать уже можно здесь. До конца года корпорация скорее всего покажет и старшую Gemini 2.0. Последняя preview-модель от Google Gemini-1206 до сих пор удерживает лидерство на LMArena.

New Yorko Times

Gemini Flash 2.0 готова порвать бенчмарки типа соотношение цена/качество/скорость впечатляет. А у можно почитать про работу над топовыми LLM из первых рук

New Yorko Times

Официально выпустили Gemini 2.0 Flash По бенчмаркам бьёт 1.5 Pro 002, которую выпускали в сентябре, а стоит на порядок дешевле. Как обычно, 2М контекст и супер быстрый инференс на маленьком контексте.

![Google начинает эру Gemini 2.0 с Gemini 2.0 Flash! Снизу будет кратко рассказано, какие возможности открывает эта модель. 1 [Gemini 2.0 Flash] доступен в виде экспериментального предварительного выпуска основной модели 2.0. Он может одновременно работать с аудио, видео и текстом. Контекстное окно 1 млн токенов. Попробовать можете прямо [сейчас] 2 [Deep Research] — Создает многоэтапные планы исследований, которые вы утверждаете. Использует Google Search для просмотра, как это делает человек. Составляет комплексные отчеты со ссылками на источники. Будет доступен в [Gemini web] 3 [Project Mariner] — Агент ИИ, который может использовать Chrome для вас. Понимает все на экране. Работает только в активной вкладке + требует подтверждения для конфиденциальных действий. 4 [Project Astra] — теперь использует Google Search, Lens & Maps в режиме реального времени. Имеет 10 минут памяти во время сеанса, а так же лучшее понимание языка. Еще показали, что Gemini 2.0 может быть вашим виртуальным игровым помощником. Он наблюдает за игрой в режиме реального времени. Понимает контекст на экране, ищет и предлагает идеи. Демо показали с Supercell. Всё, кроме первого пункта, будет доступно в 2025 году. Подробнее рассказано [тут] #news](https://content.tek.fm/0ca255a0-b487-495d-9c6e-f90cd62b0cea.jpg)

Нейросфера: нейросети, технологии

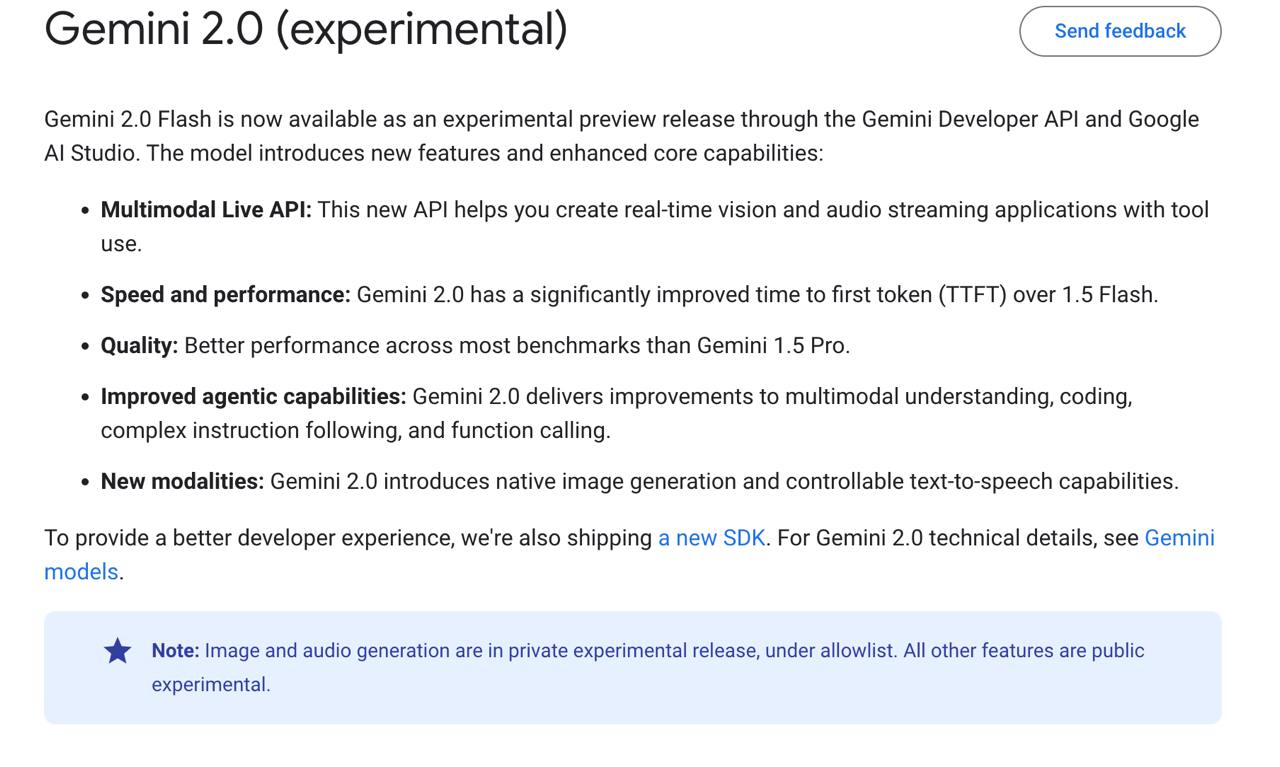

Google начинает эру Gemini 2.0 с Gemini 2.0 Flash! Снизу будет кратко рассказано, какие возможности открывает эта модель. 1 [Gemini 2.0 Flash] доступен в виде экспериментального предварительного выпуска основной модели 2.0. Он может одновременно работать с аудио, видео и текстом. Контекстное окно 1 млн токенов. Попробовать можете прямо [сейчас] 2 [Deep Research] — Создает многоэтапные планы исследований, которые вы утверждаете. Использует Google Search для просмотра, как это делает человек. Составляет комплексные отчеты со ссылками на источники. Будет доступен в [Gemini web] 3 [Project Mariner] — Агент ИИ, который может использовать Chrome для вас. Понимает все на экране. Работает только в активной вкладке + требует подтверждения для конфиденциальных действий. 4 [Project Astra] — теперь использует Google Search, Lens & Maps в режиме реального времени. Имеет 10 минут памяти во время сеанса, а так же лучшее понимание языка. Еще показали, что Gemini 2.0 может быть вашим виртуальным игровым помощником. Он наблюдает за игрой в режиме реального времени. Понимает контекст на экране, ищет и предлагает идеи. Демо показали с Supercell. Всё, кроме первого пункта, будет доступно в 2025 году. Подробнее рассказано [тут] #news

Нажми Enter | Тренды, IT и бизнес

Google дропнула ИИ-ассистента, который СМОТРИТ на экран и общается с юзером в реальном времени — Gemini 2.0 Flash уже доступна Фича Stream Realtime мониторит действия юзера и может, например, указать на ошибки в коде, подсказать с выбором фильма или даже героя в Доте. На видео чел показывает, как ИИ распознаёт предметы, которые он показывает в вебку. Тестить можно Б-Е-С-П-Л-А-Т-Н-О — тут.

GPTTG | Новости | ChatGPT

Google только что изменил мир — они выпустили нейросеть-помощника, которая СМОТРИТ на ваш экран и ГОВОРИТ, что делать. Без лишнего шума представили новую модель Gemini 2.0 Flash. Улучшили качество кода и текстов, но это не главное — добавили фичу Stream Realtime. Вариантов применения масса: можно показать редактор кода и попросить указать на ошибки, спросить совет по выбору героя в Доте или правильному ходу в шахматах. Парень на видео демонстрирует ИИ предметы, и нейронка в видеочате называет их. Самое крутое — тестировать можно БЕСПЛАТНО в AI Studio. Включите VPN и зайдите в Stream Realtime. Пока работает только с английским. Ссылка на ресурс: AI Studio

Сиолошная

Кроме этого, напоминаю, что на этой неделе ждём, пока разродится гигант: Google должны показать Gemini 2.0 У некоторых пользователей Gemini уже появилась Flash-версия. И даже в документации есть страница! Основные улучшения: — поддержка стрима аудио- и видео-потока в реальном времени чтобы давать опыт, схожий к Advanced Voice Mode у OpenAI — модель быстрее Flash 1.5, и в то же время лучше на многих бенчмарках ну тут не сомневались, а вот что быстрее - интересно — Improved agentic capabilities ! , ждём первых замеров — Модель умеет генерировать изображения GPT-4o тоже умеет, просто эту фичу не включили для нас , а также контролируемо генерирует речь. Ссылка попробовать в AI Studio только текст, зато 1М контекста : тык

AI Для Всех

Deep Research Google выкатил интересное обновление Gemini, про которое напишу вообще все, а я же хочу сосредоточиться на том, что теперь ассистент умеет сам проводить исследования в интернете. Выглядит это так: Вы просите его разобраться в какой-то теме, например "как сейчас развивается рынок беспилотных автомобилей". Gemini составляет план поиска, показывает его вам на проверку, а потом начинает самостоятельно искать информацию в сети. Он не просто собирает первые попавшиеся ссылки, а действует как настоящий исследователь - находит что-то интересное, копает глубже на основе найденного, проверяет разные источники. В итоге выдает структурированный отчет со всеми ссылками, который можно сразу выгрузить в Google Docs. Представьте: вместо того чтобы часами сидеть с десятком открытых вкладок, делая пометки и пытаясь не утонуть в информации, вы получаете готовый обзор за несколько минут. При этом можете его обсудить с ассистентом и попросить что-то уточнить или переделать. Пока Deep Research так называется эта функция доступен только в платной версии Gemini Advanced и работает на десктопе. В мобильное приложение обещают добавить в начале 2025 года. А еще Google выпустил экспериментальную версию новой модели - Gemini 2.0 Flash. Она работает быстрее и умнее, но пока находится в режиме тестирования. Попробовать можно уже сейчас - просто выберите ее в выпадающем меню моделей. И вот, мы стали еще на шажок ближе к тому моменту, когда ИИ-ассистенты действительно начнут освобождать нас от рутинной работы, а не просто отвечать на вопросы Блог-пост

Эксплойт

Google только что изменил мир — они выпустили нейросеть-помощника, который СМОТРИТ на ваш экран и ГОВОРИТ, что делать. Без лишнего шума вышла их новая модель Gemini 2.0 Flash. Прокачали качество кода и текстов, но это не главное — завезли фичу Stream Realtime. Вариантов применения масса: можно показать редактор кода и попросить указать на ошибки, спросить совет с выбором героя в Доте или правильный ход в шахматах. Парень на видео демонстрирует ИИ предметы и нейронка в видеочате называет их. Самое крутое — тестить можно БЕСПЛАТНО в AI Studio. Включите VPN и зайдите в Stream Realtime. Пока работает только с английским.

NeuroADEPT

Технологический рывок от Google — новая модель Gemini 2.0 Flash. Google выпустил новинку Gemini 2.0 Flash, и это заметный шаг вперёд. Разберёмся, что здесь интересного: • Stream Realtime — самая крутая фича, с которой модель может видеть ваш экран и подсказывать в рилтайме: от анализа кода до подсказок в играх. • Код и тексты — Flash стал ещё сильнее в написании кода и генерации текста. Результаты сложно отличить от работы копирайтера или разработчика. • Поддержка мультимедиа — модель теперь работает не только с текстом, но и с видео, аудио и любыми другими данными. Контекстное окно — до 1 млн токенов. Gemini 2.0 Flash — не просто модель для текста, а инструмент, который начинает понимать контекст экрана и взаимодействовать с ним. Революция? Скорее эволюция, но очень уверенная. Попробуем бесплатно с VPN.

Похожие новости

+8

+8

+17

+17

Apple внедряет поддержку сторонних ИИ ассистентов в iOS 27

Технологии

1 день назад

Google анонсировала The Android Show с обновлениями Android 17 на 12 мая

Технологии

1 день назад

OpenAI представила новые голосовые модели для улучшения диалогов и перевода в реальном времени

Технологии

3 часа назад

Chrome незаметно загружает модель Gemini Nano на устройства пользователей

Технологии

1 день назад

OpenAI анонсировала новую модель GPT 5 5 Instant для всех пользователей ChatGPT

Технологии

1 день назад

+8

+8

Telegram обновляет функции для улучшения работы с ботами и кастомизации контента

Технологии

23 часа назад

+17

+17