Нейродвиж

Официально: GPT-5 в разработке прямо сейчас. OpenAI создали комитет по безопасности ИИ и между делом обмолвились, что недавно начали обучение передовой модели. Если верить всем прошлый намёкам, то ждать её стоит уже этой зимой, ориентировочно после выборов президента США.

42 секунды

FT: OpenAI заявила, что начала обучение модели нового поколения и создала комитет по безопасности – OpenAI начала вести разработку своей новой модели ИИ – Эта модель сможет вывести технологию на след. уровень – За разработкой будет следить комитет по безопасности – Миссией компаний OpenAI является создание своего AGI – При этом OpenAI отмечает, что не создает «сверхразум» – Т.к. «сверхразум» должен быть умнее, чем люди на Земле – AGI от компании должен приносить пользу человечеству – Комитет по безопасности будет состоять из 4-х человек – Это Альтман стал главой , Тейлор, Д Анджело и Селигман – Они отчитываются перед 3 другими членами совета OpenAI – Ранее OpenAI распустила свою команду «superalignment»

ChatGPT-4 Work

Возможно, мы скоро увидим GPT-5 OpenAI выпустили новость, в которой сообщили, что компания создает особый комитет по охране и безопасности. Деятельность комитета будет направлена на выработку рекомендаций по безопасности будущих проектов OpenAI. Но самое главное в новости - компания начала обучение следующей модели. ChatGPT-4 Work ChatGPT

LEFT JOIN

Что нового у OpenAI OpenAI соблюдает баланс: новости про технологические прорывы и достижения равномерно чередуются со скандалами. И вот опять. Компания начала тестирование GPT-5. Релиз новой модели ожидается уже через пару месяцев — в середине года. Сначала об этом написали профильные сайты со ссылкой на внутренние источники, а потом косвенно подтвердила и сама OpenAI в новости о формировании Комитета по безопасности: Недавно OpenAI приступила к обучению новой флагманской модели, и мы ожидаем, что результат выведет нас на новый уровень возможностей на пути к AGI. Одновременно на фоне пары громких увольнений среди которых — Илья Суцкевер, один из главных героев ноябрьской драмы с уходом Альтмана разгорелся очередной скандал. Выяснилось, что OpenAI заставляет сотрудников перед уходом из компании подписывать очень суровый договор о неразглашении и недискредитации, запрещающий им критиковать бывшего работодателя. Отказ подписывать договор или нарушение условий грозили потерей акций. Сэм Альтман принес извинения и пообещал, что OpenAI откажется от этой практики. Сама осенняя история тоже получила некоторое развитие. Бывший член правления OpenAI Хелен Тонер рассказала, что Альтмана уволили — или пытались это сделать — из-за того, что он не был честен с коллегами. Например, не рассказал, что ему принадлежал стартовый капитал компании, и предоставлял неточную информацию о мерах безопасности, принятых в OpenAI. Все это, по словам Тонер, подорвало доверие к нему. Будем надеяться, что на этом скандалы с OpenAI пусть и очень увлекательные закончатся, и будет больше новостей про нейросети и искусственный интеллект.

Droider

GPT-5: некоторые подробности OpenAI в своём блоге выпустила важный анонс. Совет директоров компании сформировал комитет по безопасности и защите. Он будет отвечать за выработку рекомендаций по критическим решениям в области безопасности и защиты для проектов и операций OpenAI. Куда интереснее следующая информация: OpenAI недавно приступила к обучению своей следующей модели, и мы ожидаем, что созданные системы выведут нас на новый уровень возможностей на пути к AGI настоящий ИИ . Конечно, название GPT-5 не фигурирует в тексте, но понятно, что речь идёт о ней. Получается, это практически официальное подтверждение, что модель начали тренировать. Интересно, что совет безопасности проработает 90 дней, после чего поделится своими рекомендациями с компанией. Видимо, потом нам стоит ждать официальный анонс? Полное сообщение доступно по этой ссылке.

Хайтек+

OpenAI начала обучать новую модель, стремясь получить универсальный ИИ OpenAI приступила к обучению своей новой «пограничной» модели, и ожидает, что полученные системы приблизят достижение общего искусственного интеллекта. Чтобы решить проблемы, связанные с потенциальными рисками мощного ИИ, OpenAI создала новый комитет, посвященный безопасности. Этот орган будет консультировать совет директоров по важным решениям, касающимся безопасности проектов и операций OpenAI. Сообщается, что для оценки рисков нужно 90 дней, а значит, новый продукт компании не появится раньше этого срока. Решение о создании комитета вызвало критику: некоторые считают, что он не является независимым, так как состоит исключительно из «своих» руководителей OpenAI, в частности, в него входит Сэм Альтман.

Все о блокчейн, мозге и WEB 3.0 в России и мире

Слушайте, что происходит с OpenAI? У них опять нет единогласия внутри: вице-президент по глобальным вопросам заявила: «я бы не сказала, что наша миссия — создание сверхинтеллекта» Анна Маканджу, вице-президент OpenAI по глобальным вопросам, в интервью Financial Times сказала: «Я бы не сказала, что наша миссия - построить суперинтеллект». Альтман сказал FT в ноябре, что он потратил половину своего времени на изучение как построить суперинтеллект. Лиз Буржуа, пресс-секретарь OpenAI, сказала, что суперинтеллект не был миссией компании. «Наша миссия - это AGI, которая полезна для человечества», - сказала она после первоначальной публикации истории FT во вторник. «Чтобы достичь этого, мы также изучаем суперинтеллект, который мы обычно считаем системами, даже более интеллектуальными, чем AGI».

Похожие новости

+3

+3

+3

+3

+3

+3

+3

+3

+41

+41

+5

+5

OpenAI запускает инициативу Daybreak для автоматизации защиты от уязвимостей

Технологии

1 день назад

+3

+3

Thinking Machines анонсирует новые модели взаимодействия с ИИ для живого общения

Технологии

1 день назад

+3

+3

Сотрудники OpenAI реализовали акции на 6,6 миллиарда долларов

Экономика

1 день назад

+3

+3

Google предотвращает первую атаку с использованием ИИ на двухфакторную аутентификацию

Технологии

15 часов назад

+3

+3

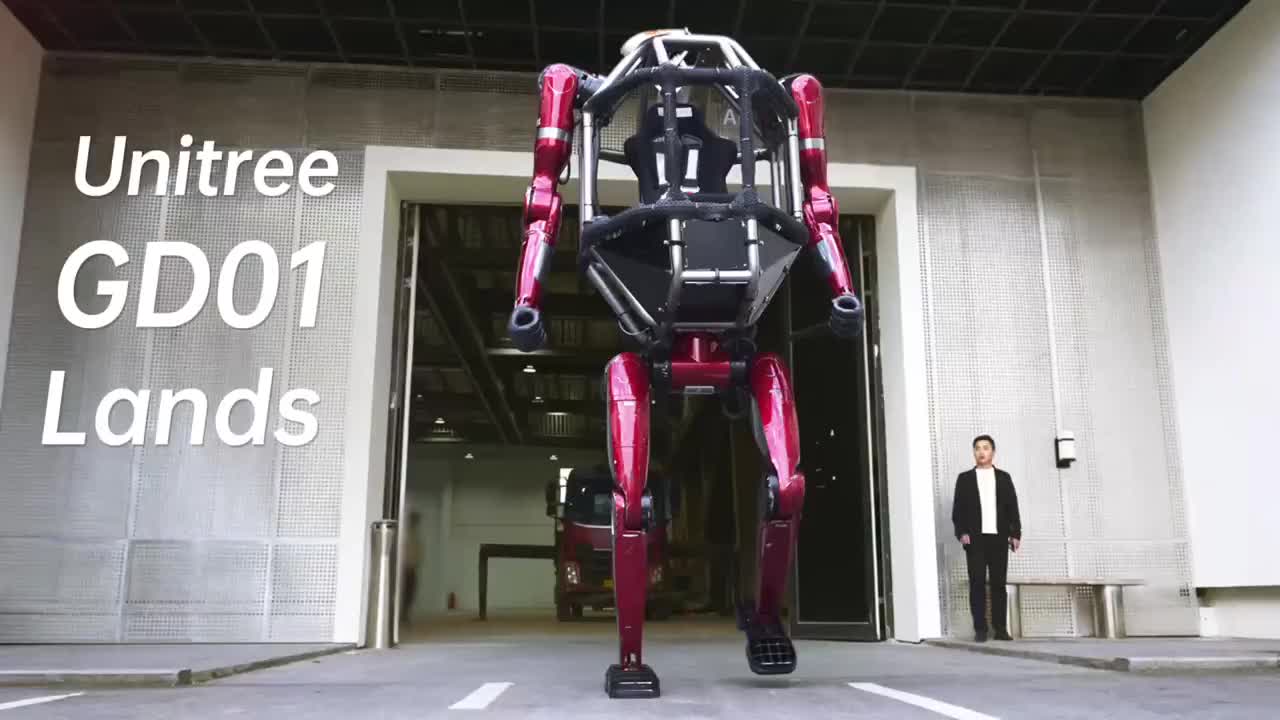

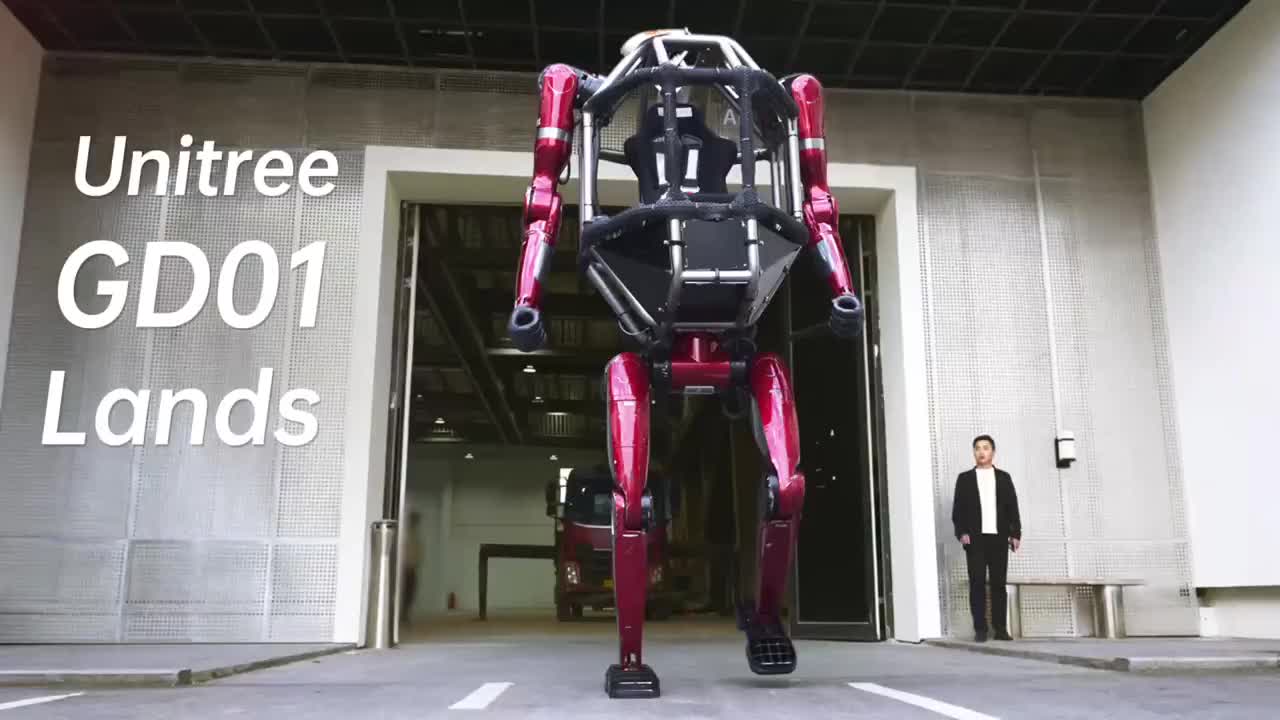

Unitree представила пилотируемого меха-робота для гражданского использования

Технологии

1 день назад

+41

+41

Google анонсирует обновление Gemini Intelligence и новые функции Android 17

Технологии

1 день назад

+5

+5