Сиолошная

OpenAI создали комитет по безопасности. Он отвечает за выработку рекомендаций по критически важным решениям в области AI Safety для всех проектов OpenAI. Самая главная часть в посте: «OpenAI has recently begun training its next frontier model...» Вторая главная часть: комитет должен предоставить свои рекомендации через 90 дней, после чего на них посмотрит совет директоров. А после этого их увидим и мы - OpenAI хотят огласить их публично. Согласно слухам, анонс новой модели запланирован на ноябрь 2024-го года.

GPT/ChatGPT/AI Central Александра Горного

OpenAI подтвердила начало обучения GPT-5 Информация о том, что OpenAI недавно начала обучение новой передовой модели появилась сегодня на ее сайте вместе с новостью о создании внутри компании комитета по безопасности AI. По слухам, новая модель может выйти в конце года, после президентских выборов в США. — GPT-4o уже доступна в c.aiacademy.me

Нейросети & Технологии | DeepTech

OpenAI запускает новую модель и создаёт комитет по безопасности OpenAI начала обучение своей передовой модели и организовала специальный комитет для рассмотрения важных аспектов безопасности проектов. Эта инициатива нацелена на улучшение существующих механизмов защиты и безопасности. Подробнее о начале обучения и создании комитета можно узнать здесь. В ближайшее время результаты работы комитета станут доступны публично. ———————————————— - Канал про тренды из мира IT, технологий, нейросетей и бизнеса.

PRO Бизнес

OpenAI начали тренировать новую модель и сформировали комитет по безопасности: OpenAI недавно начала обучение своей следующей передовой модели, и мы ожидаем, что полученные системы выведут нас на новый уровень возможностей на нашем пути к AGI. Комитет должен составить рекомендации по критически важным решениям в области безопасности и защиты для всех проектов OpenAI. Позднее OpenAI публично поделятся информацией о принятых рекомендациях безопасности. → --------------------------------- Глаз Бога YouFast VPN™ Обмен крипты

iPhones.ru

OpenAI сформировала новую команду по безопасности, которую возглавляет генеральный директор Сэм Альтман вместе с членами правления Адамом Д Анджело и Николь Селигман. Они будут давать рекомендации «по критическим решениям в области безопасности и защиты проектов и операций OpenAI». The Verge #новости

Милитарист

OpenAI заявила, что создает новую группу по безопасности, которая будет давать рекомендации совету директоров компании относительно «критических решений по безопасности»

Все о блокчейн, мозге и WEB 3.0 в России и мире

OpenAI уже обучает свою новую ИИ-модель и создала новый комитет по безопасности AGI Сегодня OpenAI сформировал комитет по безопасности ИИ во главе с Бретом Тейлором председатель , Адамом Д Анджело, Николь Селигман и Сэмом Альтманом. Этот орган будет отвечать за вынесение рекомендаций совету директоров по критически важным решениям в области безопасности для проектов и операций OpenAI. Компания заявляет, что недавно начала обучение своей следующей frontier модели, и ожидает, что полученные ИИ-системы выведут на следующий уровень к AGI. OpenAI обещает публично делиться обновленной информацией о принятых рекомендациях по безопасности. Напомним, что в начале месяца из OpenAI ушла вся команда, которая занималась безопасностью AGI, а также Илья Суцкевер. Экс-глава направления по безопасности ИИ, Ян Лейке публично раскритиковал OpenAI, после чего Альтман начал оправдываться. Тут подробнее.

NN

OpenAI начали тренировать новую модель и сформировали комитет по безопасности: OpenAI недавно начала обучение своей следующей передовой модели, и мы ожидаем, что полученные системы выведут нас на новый уровень возможностей на нашем пути к AGI. Комитет должен составить рекомендации по критически важным решениям в области безопасности и защиты для всех проектов OpenAI. Позднее OpenAI публично поделятся информацией о принятых рекомендациях безопасности.

Data Secrets

Теперь официально: OpenAI начала обучение своей следующей модели Информация об этом появилась в новости о создании внутреннего комитета по безопасности ИИ на сайте OpenAI. Комитет будет давать рекомендации совету директоров касательно безопасной разработки AGI. Один из членов комитета - сам Альтман. Тем временем Суцкевер и Лейке, которым пол года до увольнения не выделяли ресурсы на исследования про alignment:

Все о блокчейн, мозге и WEB 3.0 в России и мире

Из OpenAI в Anthropic высадилась команда по безопасности ИИ Экс-руководитель команды по безопасности AGI OpenAI Ян Лейке вышел на работу в Anthropic, прямому конкуренту OpenAI. Вероятно, его прошлая команда вошла с ним в компанию. Отметим, что когда Илья Суцкевер #увольненияOpenAI увольнял Альтмана, он предлагал Дарио Амодею, со-основателю Anthropic, стать новым гендиром компании, но тот отказался. Остается 1 вопрос: - Над чем и с кем работает теперь Илья Суцкевер? Отметим, что Amazon принадлежит 49% Anthropic, а Google 10%. Больше материалов про Anthropic читайте здесь:

Похожие новости

+3

+3

+3

+3

+3

+3

+3

+3

+4

+4

+42

+42

OpenAI запускает инициативу Daybreak для автоматизации защиты от уязвимостей

Технологии

1 день назад

+3

+3

Сотрудники OpenAI реализовали акции на 6,6 миллиарда долларов

Экономика

1 день назад

+3

+3

Thinking Machines анонсирует новые модели взаимодействия с ИИ для живого общения

Технологии

1 день назад

+3

+3

Google предотвращает первую атаку с использованием ИИ на двухфакторную аутентификацию

Технологии

1 день назад

+3

+3

Microsoft расследует вирус в Python-пакете, игнорирующий русскоязычные системы

Происшествия

17 часов назад

+4

+4

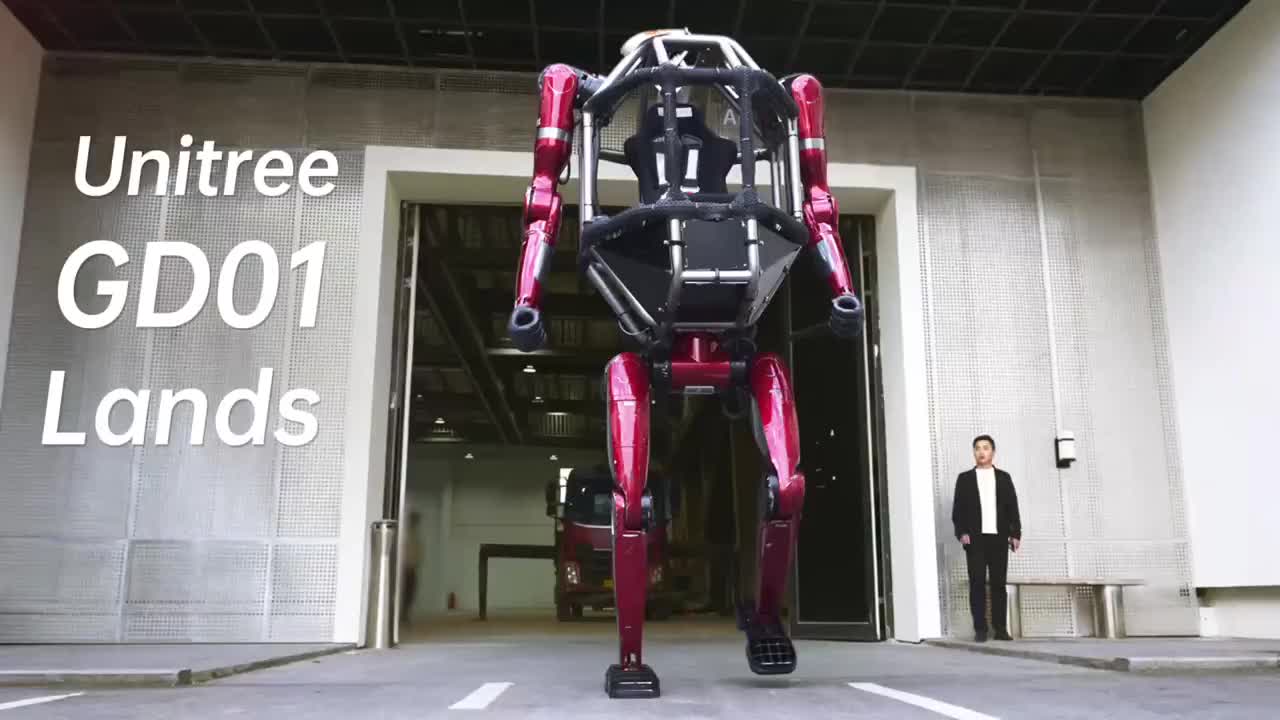

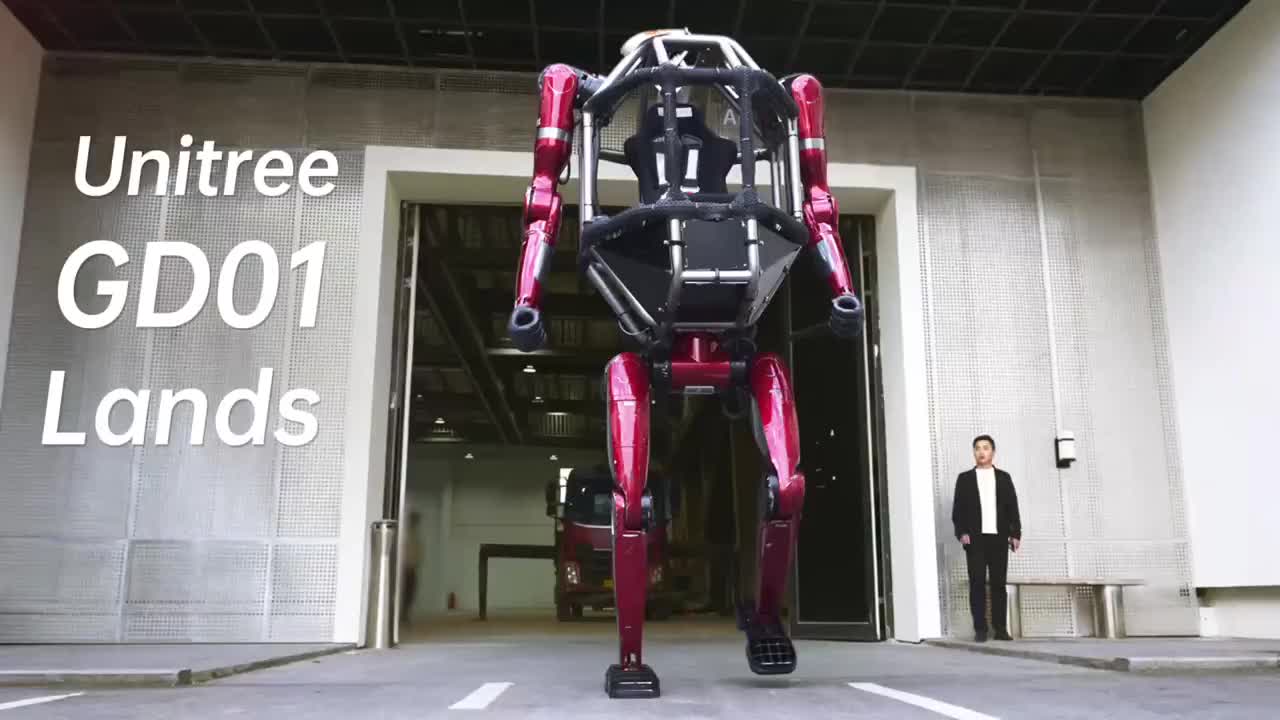

Unitree представила пилотируемого меха-робота для гражданского использования

Технологии

1 день назад

+42

+42