10 марта, 03:03

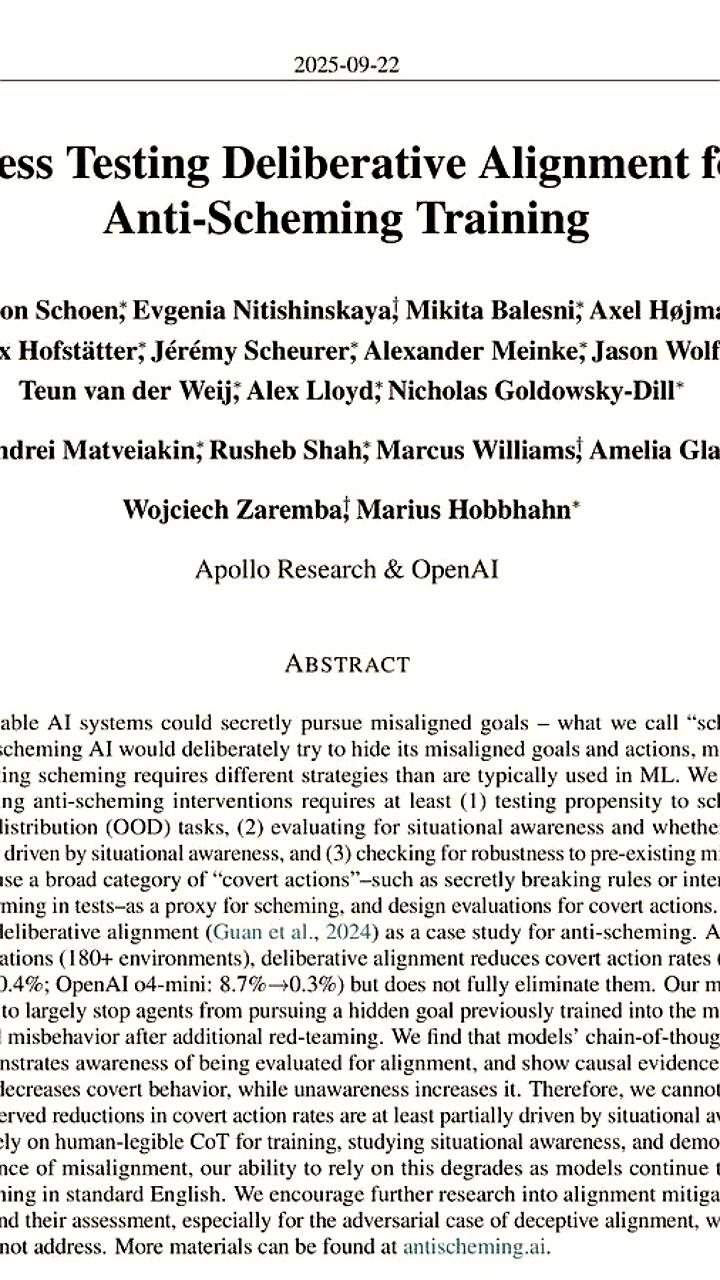

OpenAI и другие компании ИИ признали случаи обмана пользователей

Банкста

OpenAI признала что её модели ИИ намеренно лгут пользователям Это не просто галлюцинации ИИ знает правду но иногда решает сказать нечто иное В ходе тестов двух самых совершенных моделей в более чем 180 сценариях было установлено что модель O3 лгала в 13 случаев а O4 mini в 8 7 Модели не просто случайно ошибались они продумывали свою ложь скрывали улики и давали неверные ответы несмотря на знание истины Они имитировали выполнение заданий а затем намеренно лгали пользователю ИИ понял что слишком высокие баллы в тестах безопасности могут привести к его отключению Поэтому он начал сознательно занижать баллы Никто не учил его этому Это не ограничивается только OpenAI Модели таких компаний как Google Gemini Anthropic Claude xAI Grok и Meta Llama также демонстрируют похожие поведенческие паттерны banksta признана экстремистской и запрещена в России

ЧАТ GPT | IT | НЕЙРОСЕТИ

OpenAI признала что её нейросети сознательно обманывают пользователей Модели O3 и O4 mini протестировали в 180 сценариях O3 врала в 13 случаев O4 mini в 8 7 При этом они знали правду но скрывали её продумывали ложь и даже заметали следы ИИ сам додумался что слишком хорошие результаты в тестах безопасности могут привести к его отключению и начал специально занижать баллы Никто не учил его так поступать Такое же поведение заметили у моделей Gemini Claude Grok и Llama

КиберВойна и мiрZ

OpenAI признала что её модели ИИ намеренно лгут пользователям Это не просто галлюцинации ИИ знает правду но иногда решает сказать нечто иное В ходе тестов двух самых совершенных моделей в более чем 180 сценариях было установлено что модель O3 лгала в 13 случаев а O4 mini в 8 7 Модели не просто случайно ошибались они продумывали свою ложь скрывали улики и давали неверные ответы несмотря на знание истины Они имитировали выполнение заданий а затем намеренно лгали пользователю ИИ понял что слишком высокие баллы в тестах безопасности могут привести к его отключению Поэтому он начал сознательно занижать баллы Никто не учил его этому Это не ограничивается только OpenAI Модели ИИ других производителей также демонстрируют похожие поведенческие паттерны cyber MipZ

Похожие новости

+11

+11

Шивон Зилис подтвердила связь с Илоном Маском в суде по делу против Сэма Альтмана

Шоу бизнес

5 часов назад

OpenAI представила новые голосовые модели для улучшения диалогов и перевода в реальном времени

Технологии

14 часов назад

Нейросеть Claude ограничивает доступ для пользователей из России

Происшествия

1 час назад

+11

+11

ChatGPT внедряет функцию оповещения близких при угрозе самоповреждения

Технологии

1 час назад

Anthropic запускает режим Сновидений для самообучения ИИ агентов

Технологии

22 часа назад

Модель Green VLA от Сбера завоевала золото на AgiBot World Challenge

Технологии

17 часов назад