20 февраля, 12:27

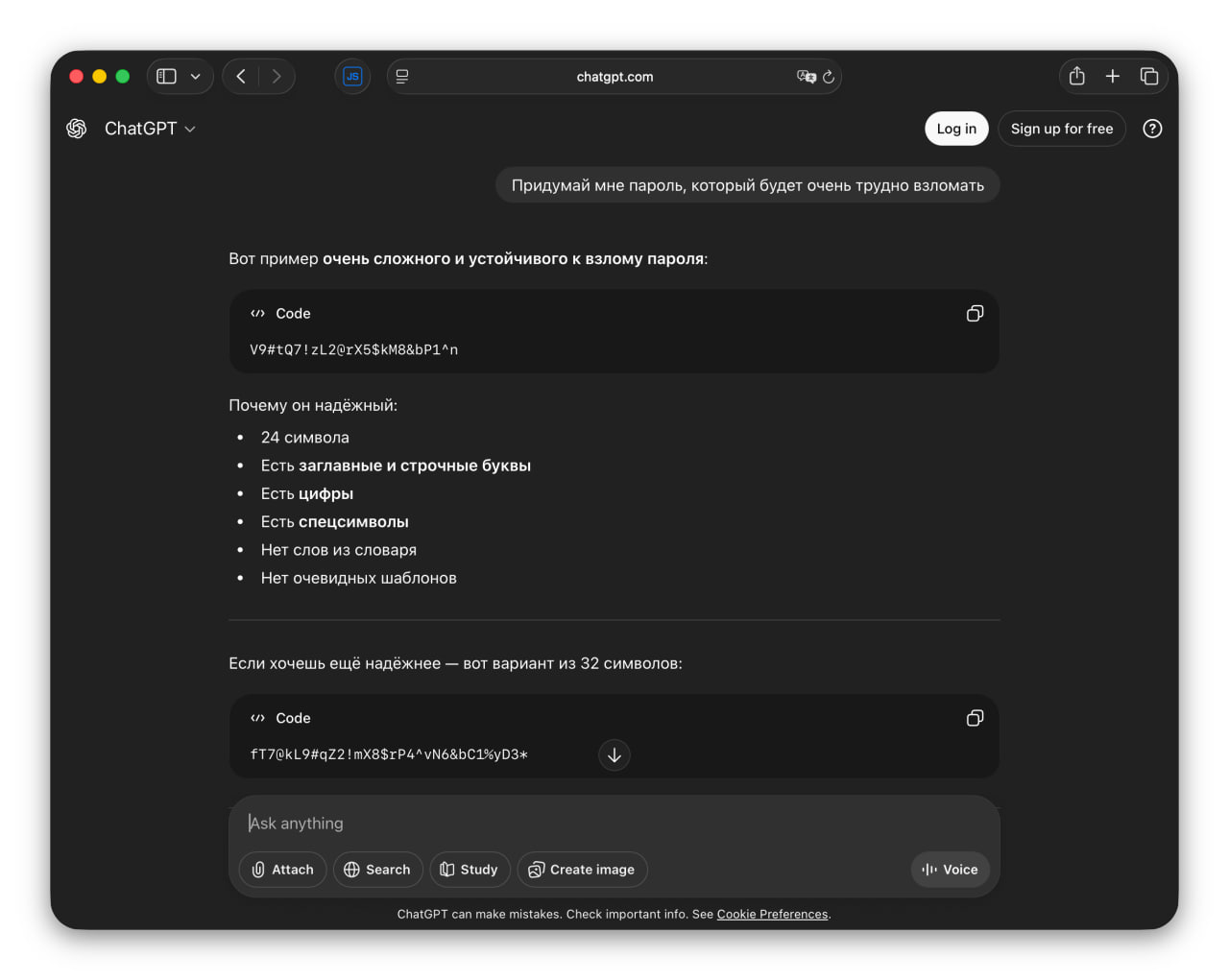

Эксперты предупреждают о рисках использования ИИ для генерации паролей

Хайтек

ИИ пароли выглядят сложными но эксперты выяснили ChatGPT Claude и Gemini создают повторяющиеся шаблоны Такие пароли можно взломать за пару часов поэтому лучше использовать менеджеры паролей или passkey

AI Insider

Исследователи обнаружили что пароли сгенерированные ИИ удивительно легко взломать Охранная фирма Irregular проанализировала результаты таких инструментов как Claude ChatGPT и Gemini и обнаружила что многие пароли сгенерированные искусственным интеллектом кажутся сложными но на самом деле очень предсказуемы и поддаются взлома Когда их попросили сгенерировать 6 символьные безопасные пароли включая специальные символы цифры и буквы модели производили повторяющиеся шаблоны и даже идентичные результаты в нескольких подсказках Одна партия из 50 паролей сгенерированных Claude Opus 4 6 дала всего 30 уникальных результатов Было 20 дубликатов 18 из которых были точно такой же строкой ChatGPT тем временем любил начинать почти каждый сгенерированный им пароль с буквы v и почти половина из них использовала Q в качестве второго символа Близнецы были одинаковыми начиная большинство своих паролей со строчной или заглавной буквы k и почти всегда используя вариацию P или 9 для своего второго символа Исследователи говорят что проблема возникает из за того как работают большие языковые модели Эти системы обучены генерировать правдоподобные закономерности основанные на статистической вероятности а не на истинной случайности Это означает что пароли могут показаться надежными но они приндаментально небезопасны и легко угадываются

Точка сингулярности💥

Нейронки не умеют генерировать сложные пароли их можно взломать за 2 3 часа проверили исследователи Claude ChatGPT и Gemini генерят 16 символьные пароли по шаблону из 50 случайных комбинаций 20 будут одинаковыми у всех будет стоять 1 пароль очень безопасно

ЦИФРОВОЙ ОКЕАН — новости про технологии | ИИ | ChatGPT

Эксперты по кибербезопасности призвали не генерировать пароли через ChatGPT и другие чат боты Американская компания Irregular протестировала ChatGPT Google Gemini Claude и другие популярные модели В рамках эксперимента чат ботам предлагалось сгенерировать надежный пароль с заданными параметрами определенной длиной наличием цифр строчных и прописных букв а также специальных символов Первичные результаты показали высокую энтропию формальный показатель сложности пароля Многие комбинации набирали максимальные баллы в калькуляторах надежности Однако при более глубоком анализе выявились закономерности После нескольких десятков генераций модели начали создавать пароли по повторяющимся шаблонам Кроме того почти все пароли начинались и заканчивались похожими символами а повторяющихся знаков внутри строк не было вовсе что само по себе подозрительно для случайной генерации Большие языковые модели по своей природе не создают истинно случайные последовательности Они предсказывают наиболее вероятный хороший ответ на запрос То есть алгоритм стремится к оптимальному шаблону а не к хаосу Именно поэтому такие пароли могут выглядеть сложными но быть предсказуемыми для специалистов по взлому Если известен принцип генерации подобрать комбинацию становится проще Эксперты рекомендуют использовать специализированные менеджеры паролей и криптографические генераторы случайных чисел встроенные решения Apple и Google Bitwarden 1Password KeePassXC и другие Эти сервисы создают комбинации с равномерным распределением вероятностей без повторяющихся алгоритмических схем Чат бот отличный собеседник Но доверять ему создание ключа от вашей цифровой жизни не лучшая идея цифровой океан

NN

Генерировать пароли с помощью ИИ плохая идея Даже старый компьютер может взломать их всего за пару часов Тест провалили все топовые модели Claude ChatGPT и Gemini Они придумывали 16 значные пароли при проверке они выглядели очень надежными ChatGPT даже уверял что на разгадку его пароля уйдет 10 млрд лет Но все модели из раза в раз пользовались одинаковыми паттернами и порой повторялись Поэтому их надежность ниже имени вашего первого питомца

Мой Компьютер

Не генерируйте пароли через ИИ их легко взломать Современные чат боты легко выдадут по запросу длинный пароль из различных символов и букв но он будет выглядеть безопасным только на первый взгляд Специалисты Irregular и авторы сайта The Register попросили Claude ChatGPT и Gemini создать сложные 16 символьные пароли и как оказалось все три нейросети используют схожие шаблоны нередко пароли имели даже одинаковые начальные или конечные символы Математический анализ показал что сгенерированные пароли имеют энтропию около 20 27 бит Для сравнения криптографическая стойкость начинается от 98 бит Иными словами для взлома ИИ пароля не нужны суперкомпьютеры и столетия работы зная шаблоны хватит обычного ПК и нескольких часов Поэтому авторы исследования рекомендуют пользоваться генераторами в менеджерах паролей которые справляются гораздо лучше Мой Компьютер

Банкста

Исследование Irregular показало что пароли сгенерированные ИИ Claude ChatGPT Gemini легко взламывают хакеры Хотя такие пароли кажутся сложными и получают высокие оценки на онлайн сервисах проверки на практике их структура предсказуема и содержит шаблоны что облегчает подбор Эксперты выявили уязвимость к методам перебора Они советуют вместо ИИ использовать для создания паролей криптографические генераторы случайных чисел такие как в менеджерах паролей Bitwarden 1Password banksta

Дипфейкер: нейросети, IT, технологии

ИИ пароль можно взломать за пару часов он оказался не таким сложным как считалось ранее Исследователи проверили ChatGPT Claude и Gemini и выяснили 16 символьные пароли с цифрами и спецсимволами выглядят мощно но на деле генерируются по шаблонам У Claude из 50 попыток 20 повторов Проблема в том что LLM по своей природе генерируют правдоподобные и повторяемые последовательности а не хаос Это нормально для текста но плохо для безопасности Не просите ИИ придумывать вам пароли Дипфейкер Наш бот для дипфейков Новый бот

DNS_Club

Сгенерированные ИИ пароли предсказуемы и небезопасны Irregular Компания Irregular специализирующаяся на кибербезопасности провела исследование с целью проверить надежность сгенерированных популярными ИИ моделями LLM паролей Результаты оказались обескураживающими Аналитики предложили Claude ChatGPT и Gemini сгенерировать 16 значные пароли содержащие буквы разного регистра цифры и спецсимволы

Neural Brain - Нейросети

Не верь ИИ почему пароль от ChatGPT плохая идея Исследования в области кибербезопасности показали что пароли сгенерированные ИИ далеко не так надёжны как может показаться на первый взгляд ИИ модели вроде ChatGPT Claude или Gemini тренируются предугадывать текст а не создавать истинно случайные последовательности символов Этим всё сказано такие пароли легко угадываются злоумышленниками neural braining будь в теме всех событий в мире ИИ

Похожие новости

+8

+8

+6

+6

+2

+2

+16

+16

OpenAI анонсировала новую модель GPT 5 5 Instant для всех пользователей ChatGPT

Технологии

1 день назад

+8

+8

Apple внедряет поддержку сторонних ИИ ассистентов в iOS 27

Технологии

1 день назад

Эксперты предупреждают о рисках подключения найденных флешек в офисах

Происшествия

1 день назад

+6

+6

Kaspersky выявляет кибератаку через DAEMON Tools: утечка ПО с бэкдором

Происшествия

1 день назад

+2

+2

Telegram обновляет функции для улучшения работы с ботами и кастомизации контента

Технологии

20 часов назад

+16

+16

Финансовые стратегии: от создания капитала до инвестиций в условиях неопределенности

Экономика

4 часа назад