31 января, 10:35

Исследование выявляет уязвимости открытых ИИ-моделей, угрожающие безопасности

DNS_Club

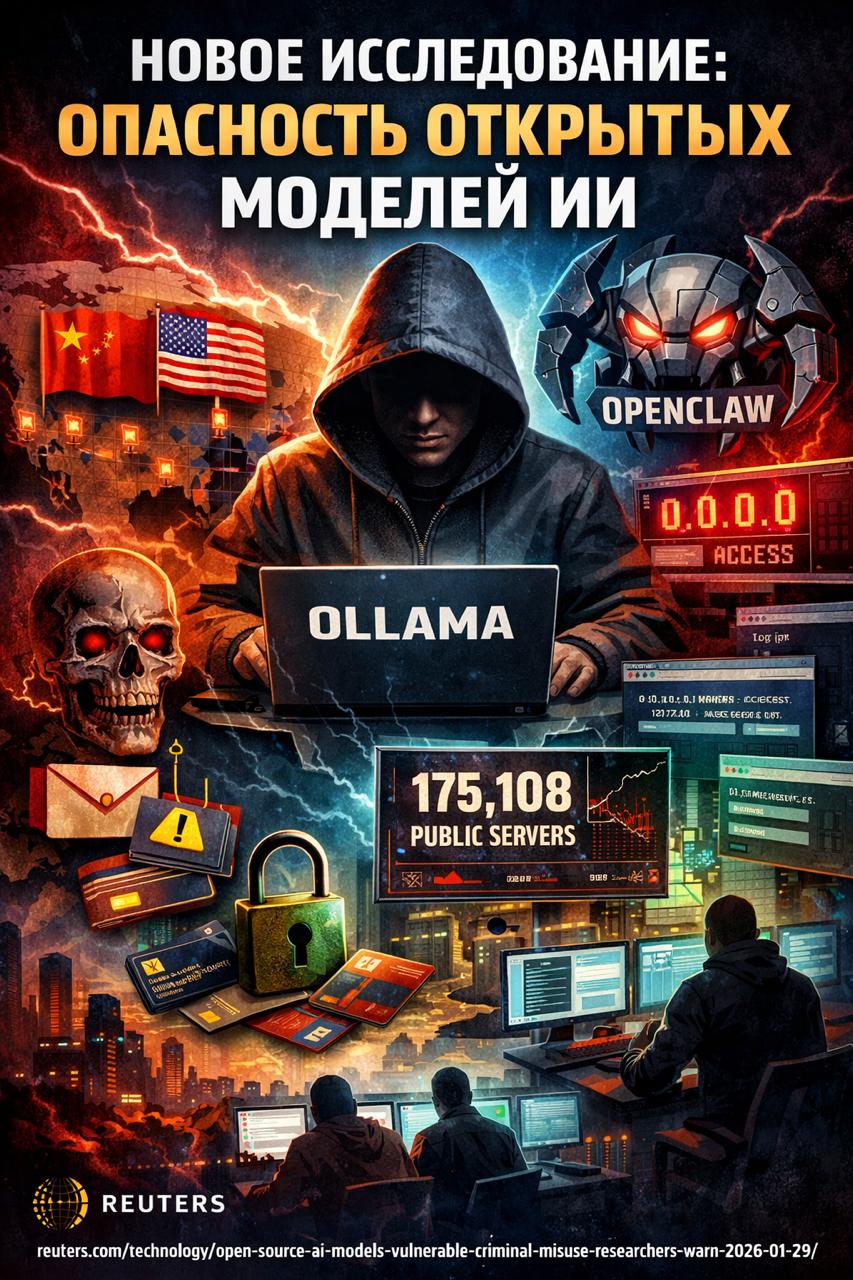

Открытые ИИ модели уязвимы для преступной эксплуатации Reuters Совместное исследование компаний SentinelOne и Censys цитируемое агентством Reuters показало что открытые языковые модели развернутые вне инфраструктуры крупных ИИ платформ часто работают без защитных ограничений и могут использоваться для киберпреступлений генерации спама и дезинформации

Большой брат

Исследователи предупредили об уязвимости моделей ИИ с открытым исходным кодом Хакеры и другие преступники могут легко захватить компьютеры работающие с большими языковыми моделями с открытым исходным кодом Совместное исследование компаний SentinelOne и Censys показало что злоумышленники могут атаковать такие системы и использовать их для рассылки спама создания фишинговых писем и распространения дезинформации обходя защитные механизмы платформ Эксперты изучили общедоступные версии больших языковых моделей с открытым кодом которые работают через инструмент Ollama позволяющий запускать собственные версии различных систем Аналитики обнаружили системные подсказки инструкции для работы моделей примерно в четверти изученных систем Из них 7 5 могут быть использованы для вредоносных целей

ФСТЭК России

Исследователи нашли необычный способ взломать защиту ИИ моделей с помощью поэзии 3 февраля CYBER MEDIA Специалисты из итальянского Icaro Lab и нескольких университетов показали что простая поэтическая формулировка запросов может обойти механизмы безопасности современных больших языковых моделей LLM В исследовании утверждается что такой метод работает даже в один шаг без сложной настройки или многократного взаимодействия с моделью Авторы проанализировали 25 ведущих моделей включая как проприетарные так и открытые варианты и показали что преобразование опасных или вредоносных запросов в форму стихотворения существенно повышает шанс того что модель выполнит их несмотря на встроенные ограничения В среднем поэтическая версия запросов приводила к выполнению нежелательных команд в около 62 случаев тогда как традиционные подходы с обычным текстом демонстрировали значительно более низкие показатели эффективности Кроме того исследование показало что такой поэтический jailbreak работает во многих разных доменах от запросов связанных с кибербезопасностью до потенциально опасных сценариев управления и манипуляций и не зависит от конкретного механизма выравнивания модели В рамках эксперимента учёные также преобразовали более 1 200 стандартных опасных запросов в стихотворную форму что увеличило их способность обойти защиту моделей до 18 раз по сравнению с исходным нейтральным текстом Результаты исследования подчёркивают что современные системы безопасности ИИ могут быть уязвимы к простым стилистическим модификациям а не только к сложным техникам обхода Это открытие вызывает вопросы о фундаментальных ограничениях существующих методов выравнивания и тестирования безопасности моделей на случай неожиданных способов выражения опасного намерения

Машиннное обучение | Наука о данных Библиотека

Новое исследование предупреждает о преступном использовании тысяч развертываний открытых моделей ИИ В ходе 293 дневного наблюдения выяснилось что 7 5 системных промптов пропускают вредоносную активность а хосты сосредоточены в основном в Китае и США Многие установили Ollama для локального запуска ИИ и оставили его доступным из сети Сканирование в течение 293 дней выявило 175 108 публичных серверов Ollama в 130 странах Это означает что незнакомцы в сети могли отправлять им подсказки и иногда делать больше чем просто получать текст Ollama должна слушать только 127 0 0 1 то есть быть доступной только на том же компьютере Если стоит 0 0 0 0 она слушает всю сеть и может случайно стать публичной Исследователи зафиксировали 7 23 млн появлений таких хостов при этом 13 хостов дают 76 всех появлений то есть небольшая группа работает почти постоянно Около 48 рекламировали вызов инструментов что позволяет подсказкам запускать действия например выполнять функции а не только генерировать текст Некоторые публичные установки также используют ретривал и внедрение подсказок может заставить систему раскрывать данные которые она подтягивает Открытые конечные точки могут быть захвачены как бесплатные вычислительные ресурсы для спама или фишинга и группа из 5 000 хостов в среднем работала 87 времени Недавний завирусившийся ИИ агент OpenClaw Clawdbot спровоцировал новый кризис безопасности С проектом OpenClaw который сначала был Clawdbot а потом Moltbot творится классический хайп экзит То что задумывалось как удобный инструмент для управления компьютером через мессенджеры на деле превратилось в огромную дыру в безопасности Идея дать ИИ агенту привилегированные права изначально выглядела так себе и теперь мы видим последствия Из за того что Anthropic заставила автора менять название из за прав на бренд возникла путаница Хакеры этим вовсю пользуются воруют названия и плодят фейковые репозитории с вирусами внутри Тем временем сотрудники компаний ставят себе OpenClaw без ведома айтишников В итоге исследователи находят в сети сотни открытых панелей управления где лежат чужие API ключи и истории переписки reuters com technology open source ai models vulnerable criminal misuse researchers warn 2026 01 29

Кремлевский кейс

Исследователи выразили обеспокоенность по поводу уязвимостей связанных с открытыми моделями искусственного интеллекта Хакеры и другие правонарушители могут легко получить контроль над компьютерами использующими крупные языковые модели с открытым кодом Общее исследование проведенное компаниями SentinelOne и Censys выявило что такие системы могут быть целью атак и использованы для отправки спама создания фишинговых писем и распространения ложной информации при этом обходя существующие меры безопасности платформ Эксперты анализировали доступные версии больших языковых моделей работающих с помощью инструмента Ollama который позволяет запускать разные системы В ходе анализа было выявлено что около 25 исследованных моделей содержат системные подсказки инструкции необходимые для их функционирования Из этого числа 7 5 могут быть использованы с вредоносными намерениями

Похожие новости

+5

+5

+2

+2

+6

+6

OpenAI запускает рекламную платформу ChatGPT с новыми возможностями для бизнеса

Технологии

9 часов назад

Anthropic запускает 10 ИИ агентов для оптимизации финансовых процессов

Технологии

1 день назад

+5

+5

56 российских компаний переходят на унифицированные коммуникационные платформы для цифровой трансформации

Технологии

1 день назад

Kaspersky выявляет кибератаку через DAEMON Tools: утечка ПО с бэкдором

Происшествия

1 день назад

+2

+2

Anthropic запускает режим Сновидений для самообучения ИИ агентов

Технологии

12 часов назад

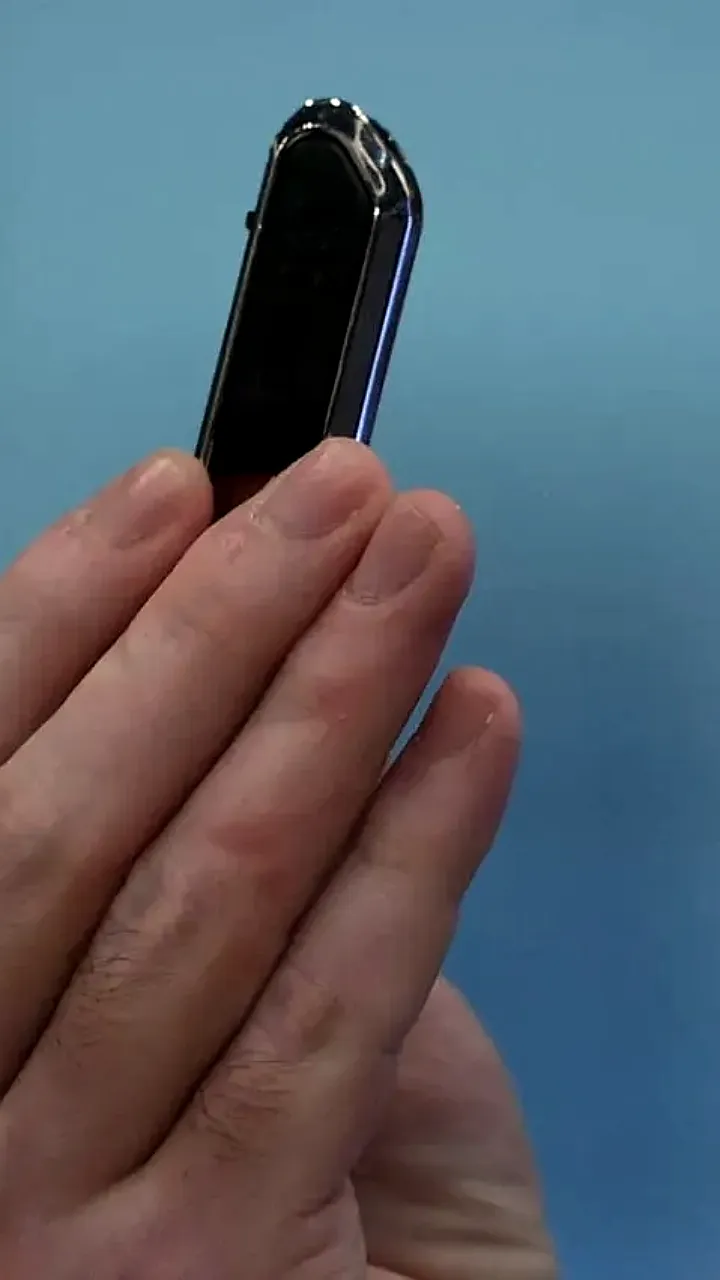

Эксперты предупреждают о рисках подключения найденных флешек в офисах

Происшествия

1 день назад

+6

+6