26 ноября, 00:04

Илья Суцкевер о будущем ИИ: новые подходы к обучению и вызовы безопасности

Denis Sexy IT 🤖

Илья дал большое интервью www youtube com watch v aR20FWCCjAs Вот главное Сейчас модели выглядят намного умнее на тестах чем в реальных задачах они переобучены на эвалы и плохо обобщают особенно в сложных многошаговых сценариях Главный технический барьер к AGI ненадёжное обобщение и низкая человеческая обучаемость простое масштабирование предобучения и RL это не решит Эпоха масштабируем всё предобучением заканчивается данные конечны RL жрёт много вычислений начинается новая эпоха исследований с поиском новых рецептов обучения в т ч ценностные функции архитектур моделей другие виды RL и т п Будущее AGI видится как система которая учится как человек один и тот же базовый разум может быстро осваивать разные профессии постоянно дообучаясь в реальном мире а не готовый мозг который знает всё из коробки Массовое распространение таких АИ учеников по экономике почти неизбежно приведёт к очень быстрому росту производительности и ВВП скорость будет сильно зависеть от регулирования в разных странах Скорее всего появится много сверхсильных АИ от разных компаний специализирующихся по нишам право медицина R D и т д а не один богоподобный монополист суперинтеллект аниме Пантеон смотрели Пора если нет Основной риск огромная мощь если сделать чрезвычайно сильного целеустремлённого агента даже с хорошей целью результат может сильно не понравиться людям желательно ограничивать максимальную мощность единичных систем В качестве цели для первых суперинтеллектов он рассматривает заботу о чувствующих существах в т ч о самом АИ как более реалистичную и устойчивую чем забота только о людях но признаёт что это не идеальное решение Он ожидает постепенный но всё более заметный показ мощных АИ обществу по мере роста реальной силы моделей компании и государства станут намного более параноидальны и начнут активно координироваться по безопасности и регулированию Краткосрочный хороший сценарий универсальный высокий доход и то что АИ делает почти всю работу долгосрочно это нестабильно потому что люди выпадают из активного участия в принятии решений Один из возможных ему самому не очень нравящийся способов долгосрочной стабилизации частичное слияние людей с АИ через продвинутые нейроинтерфейсы чтобы люди разделяли понимание с системами и оставались в контуре управления Оценка горизонта до АИ который учится как человек и может стать базой для суперинтеллекта примерно 5 20 лет текущий чистый масштабинг в какой то момент упрётся в потолок SSI его АИ лаба он описывает как чисто исследовательскую компанию с другим техническим подходом к обобщению и безопасности которая не ставит ставку на простое наращивание масштаба текущих архитектур и ожидает что в итоге крупные игроки всё равно сойдутся в общих стратегиях по безопасному выводу суперинтеллекта в мир

Нейросети & Технологии | DeepTech

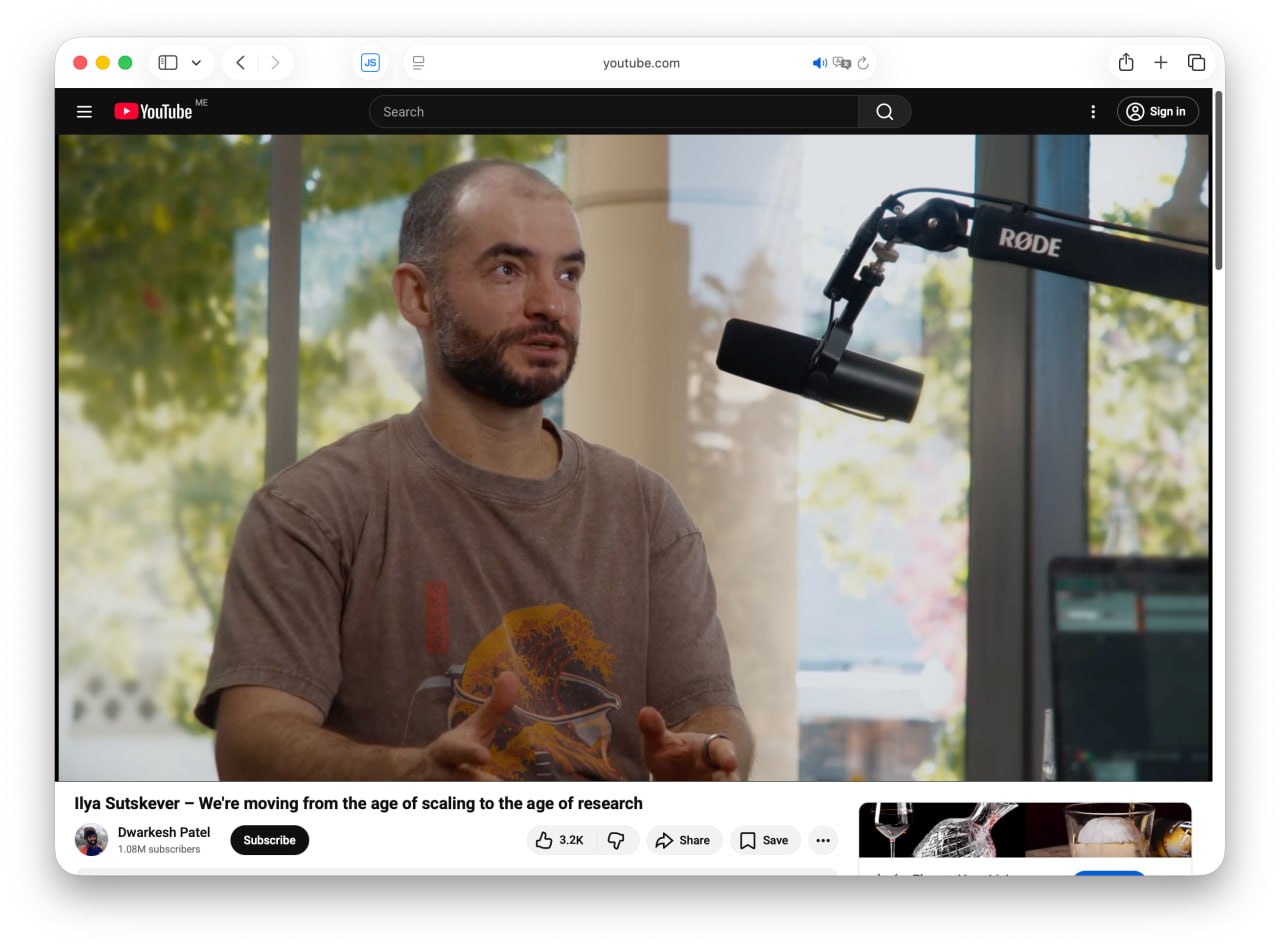

Интервью с сооснователем OpenAI Ильей Суцкевером Сооснователь OpenAI Илья Суцкевер поделился своим мнением в интервью с блогером Дваркешем Пателем Они обсудили пути преодоления существующих ограничений в обучении ИИ для достижения сходства с человеческими способностями и отметили почему люди по прежнему превосходят модели Также Суцкевер выразил критику по поводу конкуренции среди ведущих ИИ лабораторий Смотрите по ссылке DeepTechNET Канал про тренды из мира IT технологий нейросетей и бизнеса

Банкста

Сооснователь OpenAI и глава стартапа Safe Superintelligence Илья Суцкевер сказал что ИИ компании возвращаются к эпохе исследований Подходы основанные на увеличении объёмов данных и мощности вычислений перестают давать большие результаты Компании сталкиваются с кризисом масштабирования Он считает что нейросети не способны создавать экономическую ценность они ошибаются и не обобщают информацию как человек Поэтому он сосредоточился на разработке нового подхода который создаст модели с возможностью самообучения Его команда намерена разрабатывать модели которые как 15 летний подросток смогут адаптироваться и развиваться под задачи пользователей Суцкевер считает что корпорации работающие с ИИ неправильно интерпретируют концепцию искусственного интеллекта и переоценивают свои возможности Вместо создания сверхразума важнее создать систему которая будет иметь возможность самостоятельно обучаться На это направлен его стартап Safe Superintelligence который был основан в 2024 году Суцкевер хочет привлечь деньги под что то новое Со старыми лозунгами деньги в ИИ теперь могут не дать banksta

Hi, AI! | Нейросети и технологии

Илья Суцкевер Сверхинтеллект появится в промежутке 5 20 лет Сооснователь и бывший главный исследователь OpenAI Илья Суцкевер основавший в 2024 году стартап Safe Superintelligence Inc рассказал в интервью о будущем ИИ и суперинтеллекта и как эти технологии изменят мир С 2012 по 2020 год была эпоха ИИ исследований с 2020 по 2025 й эпоха масштабирования Сейчас мы вернулись к эпохе исследований но с большими мощностями За несколько лет масштабирование вытеснило все остальное а ИИ компаний стало больше чем идей Разработка сверхсильного ИИ может занять от 5 до 20 лет Внедрение будет постепенным и специализированным Например суперинтеллект для сложных экономических решений или суперинтеллект юрист В какой то момент на все это среагирует экономика и начнется стремительный рост ИИ будущего будет несравнимо мощнее И тогда ИИ компании начнут гораздо серьезнее даже с примесью паранойи относиться к безопасности Скорее всего потребуются договоренности даже между конкурентами как регулировать такие системы Сверхмощный ИИ сможет учиться так же хорошо как человек освоивший определенные важные навыки благодаря эволюции Не исключено что эти ИИ системы будут обучены заботиться о живых существах причем не только о людях но и о всей сознательной жизни потому что сам ИИ уже тоже будет сознательным говорит Суцкевер Возможно люди сами станут частью ИИ с помощью имплантов наподобие Neuralink И тогда мы начнем взаимодействовать друг с другом на совсем другом уровне Полностью интервью можно посмотреть здесь Подпишитесь на Hi AI

Похожие новости

+1

+1

В России разработана система ИИ для беспилотников и автоматизации авиации

Технологии

1 день назад

Шивон Зилис подтвердила связь с Илоном Маском в суде по делу против Сэма Альтмана

Шоу бизнес

1 день назад

OpenAI представила новые голосовые модели для улучшения диалогов и перевода в реальном времени

Технологии

1 день назад

+1

+1

Кремниевая долина нанимает философов для обучения ИИ с зарплатой до 400 тыс. долларов

Общество

22 часа назад

Модель Green VLA от Сбера завоевала золото на AgiBot World Challenge

Технологии

1 день назад

ChatGPT внедряет функцию оповещения близких при угрозе самоповреждения

Технологии

1 день назад