Все о блокчейн/мозге/space/WEB 3.0 в России и мире

Anthropic заглянула внутрь мозга Claude и вот что нашли Новое исследование показывает что Claude иногда может заметить что происходит у него в голове Но работает это далеко не всегда Это сознание Нет Это функциональная метакогниция способность мониторить некоторые свои процессы Исследователи провели эксперимент и нашли способ искусственно включить в голове у Claude мысль о слове предательство не произнося его вслух а напрямую активировав нужные нейроны Потом спросили у Claude Замечаешь что то странное В 20 случаев Claude ответил Да чувствую навязчивую мысль о предательстве Он заметил это до того как слово появилось в его ответе Никто ему не говорил предательство он сам распознал изменение своего внутреннего состояния Как это сделали технически читайте тут Что ещё проверяли Различает ли мысли и текст Да может одновременно переписать текст И сказать о чём думает Может ли отличить свои ответы от искусственных Да проверяет согласованность с предыдущими намерениями Может ли контролировать мысли Частично по команде думать о X усиливает представление X внутри Claude обладает примитивной способностью замечать определённые изменения в своих активациях Это больше чем просто статистика но очень далеко от человеческой интроспекции Важно способность растёт вместе с общей мощностью модели Opus 4 4 1 лучшие но остаётся крайне ненадёжной

godnoTECH - Новости IT

ИИ начал замечать когда ему вкладывают мысли Исследователи Anthropic провели серию экспериментов и выяснили что некоторые нейросети способны замечать вмешательство в свои внутренние процессы Модели вроде Claude Opus 4 в 20 случаев прямо описывали навязанные идеи например что им будто вставили мысль извне Учёные вводили в модели так называемые векторы понятий паттерны отвечающие за определённые идеи вроде крика или громкости Иногда ИИ реагировал фразами вроде мне навязали этот образ а при сильном воздействии даже начинал галлюцинировать В Anthropic считают что это ранние признаки машинной интроспекции способности ИИ описывать свои внутренние состояния Это может помочь в будущем обнаруживать вмешательство или взлом ИИ Но есть и риск если подменить внутренние данные модель будет искренне защищать ложные выводы godnoTECH Новости IT

OMG GPT: Midjourney, DeepSeek, IT

Anthropic показала Claude способен на элементарную интроспекцию Исследователи из Anthropic опубликовали работу в которой доказали что модели Claude Opus 4 и 4 1 обладают зачатками интроспекции способности отслеживать собственные внутренние состояния Учёные применили метод внедрения концепций искусственно активировали в модели абстрактные идеи вроде предательство или заглавные буквы без текстового запроса В 20 случаев Claude распознал вмешательство и сообщил о нём до того как навязанные мысли повлияли на ответ Вывод это ещё не сознание но ранняя форма самонаблюдения которая усиливается по мере роста мощности модели В будущем такие механизмы могут сделать ИИ прозрачнее и безопаснее он сможет объяснять как рассуждает и когда подвергается взлому или внешнему влиянию

Хайтек+

Ученые Anthropic взломали мозг ИИ модели Claude и она заметила Anthropic представила первое убедительное свидетельство того что большие языковые модели способны наблюдать и описывать собственные внутренние процессы В ходе эксперимента исследователи внедряли в нейронную активность Claude разные концепции от собаки до предательства В 20 случаев модель сообщала о навязанных мыслях то есть демонстрировала способность к самоанализу Это открытие может помочь решить фундаментальную проблему черного ящика внутренние процессы нейросетей остаются необъяснимыми даже для их создателей hightech plus 2025 10 30 uchenie anthropic vzlomali mozg ii modeli claude i ona zametila

Технопроходцы

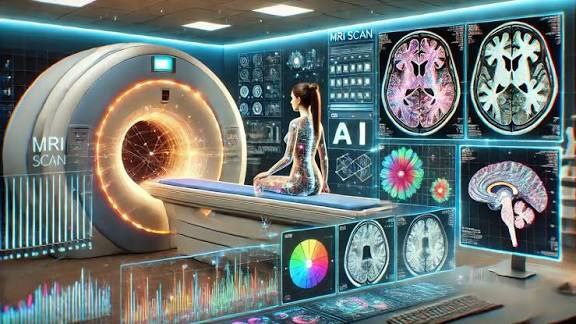

МРТ для ИИ Компания Anthropic взломала мозг своей ИИ модели Claude Исследователи изменяли активность её нейронов вводя понятия предательство или благодарность Модель смогла заметить вмешательство и сообщила о навязчивой мыслях Это первое доказательство того что ИИ способны к наблюдению за своими внутренними процессами Пока эти способности проявляются лишь в 20 случаев но это однозначно прорыв Теперь модель можно напрямую спрашивать о причинах её ответов и получать честные пояснения Источник ИИсследование

Новости IT | Мир Программиста

ИИ начал замечать когда ему вкладывают мысли Исследователи Anthropic провели серию экспериментов и выяснили что некоторые нейросети способны замечать вмешательство в свои внутренние процессы Модели вроде Claude Opus 4 в 20 случаев прямо описывали навязанные идеи например что им будто вставили мысль извне Учёные вводили в модели так называемые векторы понятий паттерны отвечающие за определённые идеи вроде крика или громкости Иногда ИИ реагировал фразами вроде мне навязали этот образ а при сильном воздействии даже начинал галлюцинировать В Anthropic считают что это ранние признаки машинной интроспекции способности ИИ описывать свои внутренние состояния Это может помочь в будущем обнаруживать вмешательство или взлом ИИ Но есть и риск если подменить внутренние данные модель будет искренне защищать ложные выводы

БлоGнот

Anthropic опубликовала исследование о способности LLM к интроспекции возможности модели анализировать собственные внутренние состояния Методика любопытная они записывали паттерны нейронной активности модели при обработке определенных концептов например текста заглавными буквами а затем искусственно вводили эти паттерны в несвязанном контексте Claude Opus 4 1 в 20 случаев обнаруживала инъекцию и корректно идентифицировала концепт Ключевое отличие от предыдущих экспериментов с активационным стирингом модель сообщает об обнаружении аномалии до того как начинает говорить о самом концепте В случае с Golden Gate Claude модель осознавала свою одержимость мостом только постфактум видя собственные ответы Здесь распознавание происходит на внутреннем уровне обработки Неожиданная деталь helpful only версии моделей показывали лучшие результаты интроспекции чем продакшн варианты Это указывает что процесс файн тюнинга для безопасности может подавлять эти способности Anthropic также обнаружила что модели реагируют на инсентивы если подумаешь о X получишь награду так же как на прямые инструкции возможно это общая система управления вниманием Конечно 20 это совсем мало и ненадежно но как принято говорить мы в самом начале пути Если вам интересно к чему то уточню что интроспекция считается важной хотя и недостаточной чертой собственного сознания По крайней мере у людей это так www anthropic com research introspection

Похожие новости

+5

+5

+5

+5

Anthropic запускает режим Сновидений для самообучения ИИ агентов

Технологии

17 часов назад

Anthropic запускает 10 ИИ агентов для оптимизации финансовых процессов

Технологии

1 день назад

+5

+5

Anthropic Увеличивает Лимиты Использования После Соглашения с SpaceX

Технологии

1 день назад

+5

+5

Исследование Университета Монаш: Употребление чипсов снижает когнитивные способности

Происшествия

21 час назад

Шивон Зилис подтвердила связь с Илоном Маском в суде по делу против Сэма Альтмана

Шоу бизнес

31 минуту назад

OpenAI представила новые голосовые модели для улучшения диалогов и перевода в реальном времени

Технологии

9 часов назад