22 октября, 11:46

Знаменитости призывают остановить разработку сверхразумного ИИ

TMT Channel

Американские политики и пионеры ИТ призывают к запрету сверхразумного ИИ пока не поздно Группа влиятельных американский правых медиадеятелей включая Стива Бэннона бывший главный стратег Трампа а также знаменитые айтишники подписали письмо с требованием остановить разработку ИИ превосходящего человеческий разум до тех пор пока общество не потребует его появления а ученые не смогут гарантировать полную безопасность И чтоб вы понимали насколько все серьезно по данным Reuters среди подписавших обращение бывший главный исследователь Google Джеффри Хинтон а также Йошуа Бенджио два из трех крестных отцов современного ИИ лауреаты премии Тьюринга чьи работы лежат в основе нынешнего бума нейросетей Стив Возняк соучредитель Apple Ричард Брэнсон основатель Virgin Group один из самых известных предпринимателей визионеров в мире и др Само письмо подготовил Институт Future of Life который изначально поддерживал Илон Маск Эта организация уже более десяти лет предупреждает о потенциальных экзистенциальных рисках которые несет ИИ TMT Channel Подписаться

808

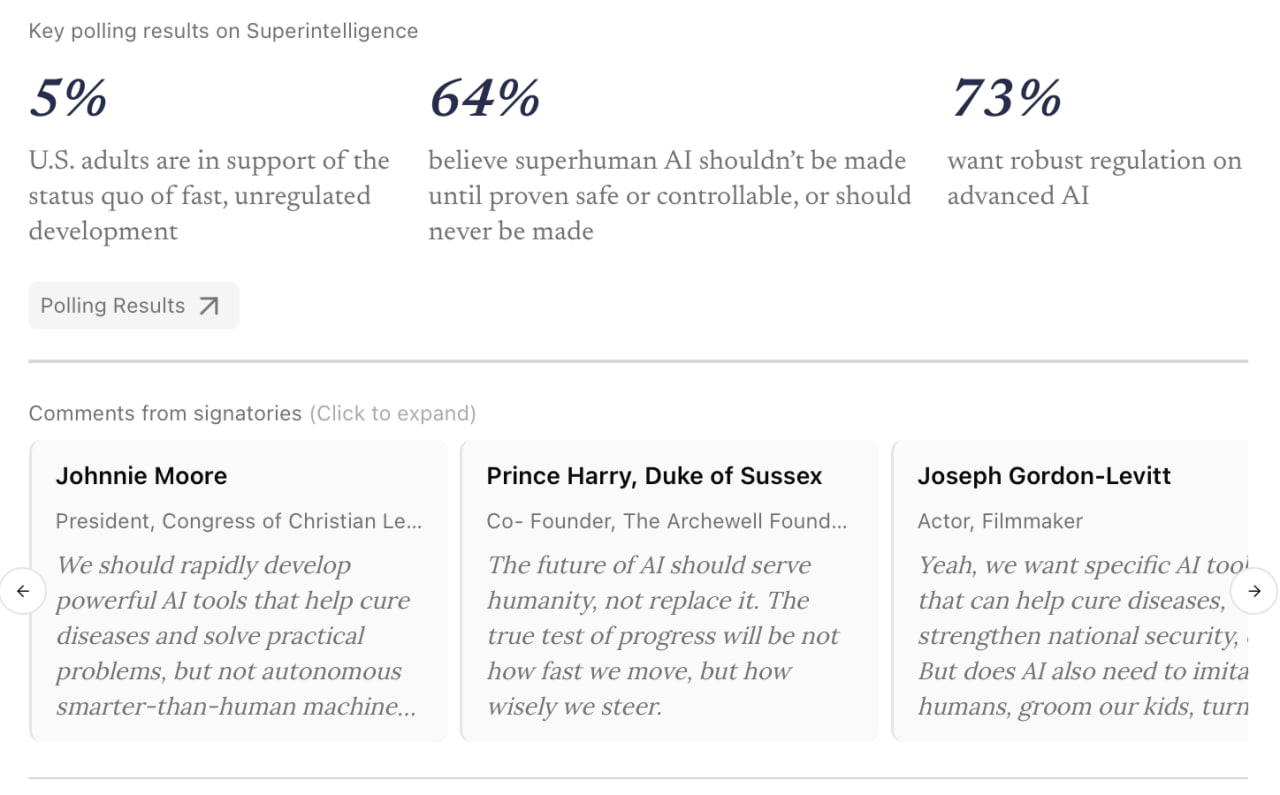

Более 800 знаменитостей в т ч сооснователь Apple Стив Возняк рэпер Will i аm принц Гарри и пять нобелевских лауреатов подписали открытое письмо с требованием запретить разработку сверхразумного ИИ По их мнению технологии развиваются слишком быстро из за чего уже через год два может появиться ИИ способный превзойти способности любого поэтому сейчас важно приостановить работу до тех пор пока не будет достигнут консенсус по его безопасному и контролируемому внедрению Свою подпись также оставили миллиардер Ричард Брэнсон Джозеф Гордон Левитт советник Папы Римского Паоло Бенанти и многие другие

Russia News

Знаменитости выступают против создания искусственного сверхразума Свыше восьмисот знаменитостей призывают отказаться от создания сверхразумного искусственного интеллекта пока не стало слишком поздно Среди сторонников идеи исследователь ИИ Деффри Хинтон принц Гарри соучредитель Apple Стив Возняк бывший советник Дональда Трампа Стив Бэннон и другие Они требуют прекратить разрабатывать сверхразум пока его нельзя будет создавать безопасно и контролируемо а также он не получит широкое одобрение общественности Исследователи переживают по поводу того что быстрое развитие нейросетей может привести к созданию общего ИИ который будет неуправляем Напомним что ранее в аналитическом центре RAND заявляли о том что использование искусственного интеллекта может привести к катастрофическим последствиям когда ему поручат управление критически важными инфраструктурными объектами Сообщает сайт Russia News Подпишись

Кремлевский кейс

Более 850 известных личностей включая экспертов в области искусственного интеллекта и технологий выступили с призывом замедлить стремление к разработке ИИ который превзойдет человеческие способности известного как суперинтеллект Ведущие представители бизнеса науки и медиа обращают внимание на необходимость остановить эту гонку

Афиша Daily News

Джозеф Гордон Левитт призвал приостановить разработку сверхразумного искусственного интеллекта до тех пор пока не будут установлены четкие стандарты безопасности Актер подписал соответствующую петицию под документом свои подписи также поставили политики религиозные деятели эксперты по технологиям и представители индустрии развлечений например Стивен Фрай Will i am Кейт Буш режиссер Дэниел Кван и бывшая девушка Илона Маска Граймс Зачем вообще создавать ИИ умнее человека Не стоит создавать сверхразум пока мы не докажем что это безопасно и пока люди действительно этого не захотят считает звезда Начала Больше новостей в Daily News

XOR

ИИ может привести к вымиранию человечества говорится в письме против создания сверхинтеллекта которое уже подписали сотни человек Письмо призывает остановить развитие ИИ пока не будет доказано что оно безопасно и контролируемо Среди подписавших Принц Гарри соучредитель Apple Стив Возняк крестный отец ИИ Джеффри Хинтон и даже советник Папы Римского по вопросам ИИ На странице также собраны верифицированные комментарии от звездных подписавших их как минимум интересно почитать Чтобы безопасно идти к сверхразуму мы должны понять как проектировать системы ИИ которые принципиально неспособны причинить вред людям считает профессор Йошуа Бенджио лауреат премии Тьюринга xor journal

Zеркало

Более 800 знаменитостей призвали запретить создание сверхразумного ИИ Среди подписавшихся британский принц Гарри экс советник Трампа Стив Бэннон соучредитель Apple Стив Возняк исследователь в области ИИ Джеффри Хинтон Они призывают остановить разработку пока её нельзя будет создавать безопасно и контролируемо а также широко не одобрят в обществе Исследователи опасаются что быстрое развитие систем ИИ может привести к созданию общего искусственного интеллекта пишет NBC News Ранее аналитический центр RAND заявлял что использование ИИ может обернуться катастрофой когда ему поручат управлять критически важной инфраструктурой Подписаться на RT ТГ Зеркало MAX

ForkLog FEED

Принц Гарри его супруга Меган Маркл и пионер искусственного интеллекта Джеффри Хинтон призвали запретить создание сверхинтеллектуального ИИ до тех пор пока его использование не станет безопасным В организованном некоммерческой организацией Future of Life Institute заявлении группа ученых и общественных деятелей выступила за запрет на разработку искусственного интеллекта который значительно превосходит человеческие возможности Создание призвали отложить до тех пор пока не будет достигнут широкий научный консенсус касательно того что это можно сделать безопасно и под контролем Среди известных подписантов сооснователь Apple Стив Возняк экономист Дарон Аджемоглу политик Стив Бэннон и бывшая советница по национальной безопасности США Сьюзан Райс Новости AI YouTube

Мой Компьютер

Самый цитируемый учёный в мире Стив Возняк и еще 1500 деятелей выступили против создания сверхразумного ИИ Сотни публичных деятелей из мира технологий политики СМИ образования религии и даже королевской семьи подписали открытое письмо с призывом запретить разработку сверхразума до тех пор пока не будет достигнут широкий научный консенсус о том что это будет безопасно и контролируемо Среди более 1500 подписавших два крёстных отца ИИ OpenAI уже направила организовавшей это письмо группе Future of Life Institute FLI повестку в суд в ответ за призывы к контролю над ИИ Сэм Альтман заявил что технология сверхинтеллекта будет реализована к 2030 году Он добавил что до 40 экономических задач которыми сегодня занимаются люди в недалёком будущем будут переданы ИИ Маловероятно что это письмо побудит компании занимающиеся разработкой ИИ замедлить работу над умным ИИ Аналогичное письмо подписанное главой SpaceX и Tesla Илоном Маском в 2023 году не имело практически никакого эффекта Мой Компьютер

Хочу дышать свободно!

К прекращению разработок по созданию искусственного интеллекта способного конкурировать с человеческим призвали более 700 ученых предпринимателей и знаменитостей 22 октября передает CTV News Инициатива призывает к запрету на разработку сверхинтеллекта до тех пор пока технология не станет надежно безопасной и контролируемой а также не получит общественную поддержку говорится в открытом письме подготовленном американской неправительственной организацией Институт будущей жизни В числе подписавших письмо лауреат Нобелевской премии по физике 2024 года крестный отец ИИ Джеффри Хинтон профессор компьютерных наук Калифорнийского университета в Беркли Стюарт Рассел самый цитируемый в мире специалист по ИИ Йошуа Бенжио из Монреальского университета

Похожие новости

+10

+10

+2

+2

+8

+8

Исследование: ИИ увеличивает рабочую нагрузку сотрудников

Технологии

1 день назад

Apple выплатит 250 миллионов долларов владельцам iPhone за недоступные функции Siri

Технологии

1 день назад

+10

+10

Шивон Зилис подтвердила связь с Илоном Маском в суде по делу против Сэма Альтмана

Шоу бизнес

34 минуты назад

Apple анонсирует возможность выбора сторонних ИИ моделей в iOS 27

Технологии

1 день назад

Крупные IT и игровые компании покидают Россию из-за ограничений

Политика

1 день назад

+2

+2

В администрации президента России обсуждают необходимость создания позитивного образа будущего

Общество

1 день назад

+8

+8