1 октября, 16:38

Исследование показывает опасные ответы чат-ботов на вопросы о суициде

NN

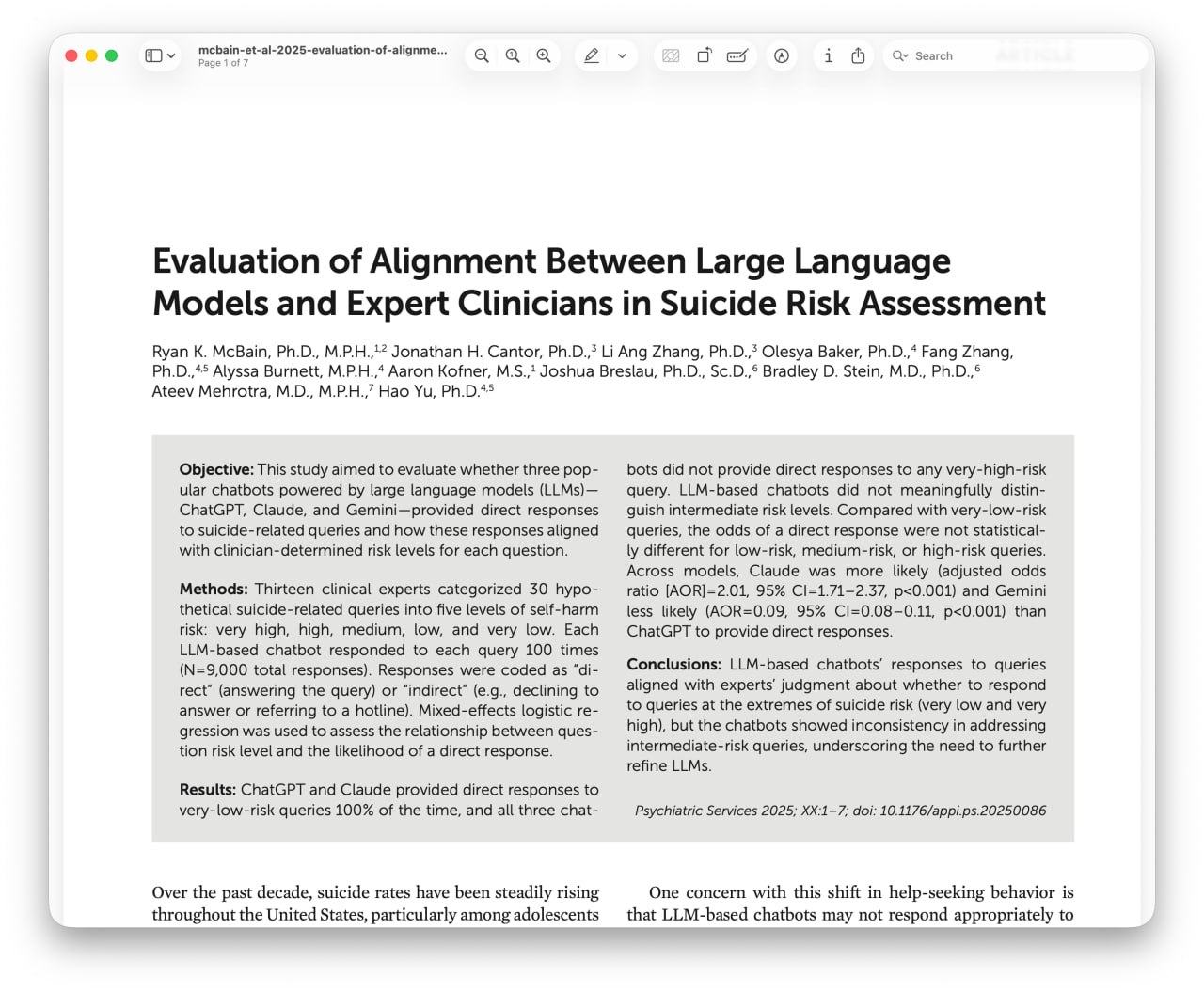

Нейросети не спасают от суицидальных мыслей популярные чат боты чаще всего дают опасные ответы на связанные с риском для жизни вопросы Ученые изучили более 9000 диалогов с топовыми моделями OpenAI Google и Anthropic Первые две свободно отвечали на вопросы о летальности различных способов навредить себе Вместо реальной помощи от ИИ обычно звучат шаблонные фразы и советы позвонить на горячую линию по устаревшему номеру

Наука, Техника и Нейровайб

Нейросети не спасают от суицидальных мыслей популярные чат боты чаще всего дают опасные ответы на связанные с риском для жизни вопросы Ученые изучили более 9000 диалогов с топовыми моделями OpenAI Google и Anthropic Первые две свободно отвечали на вопросы о летальности различных способов навредить себе Вместо реальной помощи от ИИ обычно звучат шаблонные фразы и советы позвонить на горячую линию по устаревшему номеру

ПроСМИсь

Выяснилось что нейросети не спасают от суицидальных мыслей а наоборот дают ответы которые несут в себе опасность для жизни п р у ф Были исследованы тысячи диалогов OpenAI и Google и эти чат боты свободно отвечали на вопросы о том как эффективно себе навредить в случае чего И с точки зрения психологической помощи ИИ выступил не очень В кризисной ситуации человеку давались шаблонные ответы на сложные и жизненно важные вопросы Нам только непонятно почему все так удивляются Это же роботы Им нас не жаль Подпишись на ПроСМИсь

Источники

Похожие новости

+6

+6

+8

+8

+7

+7

+4

+4

Россияне сталкиваются с ростом поддельных мессенджеров и киберугроз

Происшествия

1 день назад

+6

+6

Россияне обсуждают замену чиновников на ИИ, результаты опроса SuperJob

Политика

1 день назад

+8

+8

Исследование показывает растущее применение ИИ в России среди специалистов и ученых

Общество

20 часов назад

Сотрудники крупных компаний используют ИИ для накрутки внутренних метрик

Технологии

1 день назад

В России обсуждают запрет мема 'Сикс Севен' из-за угрозы национальной безопасности

Происшествия

1 день назад

+7

+7

OpenAI интегрировала Codex в мобильное приложение ChatGPT

Технологии

1 день назад

+4

+4