3 августа, 01:33

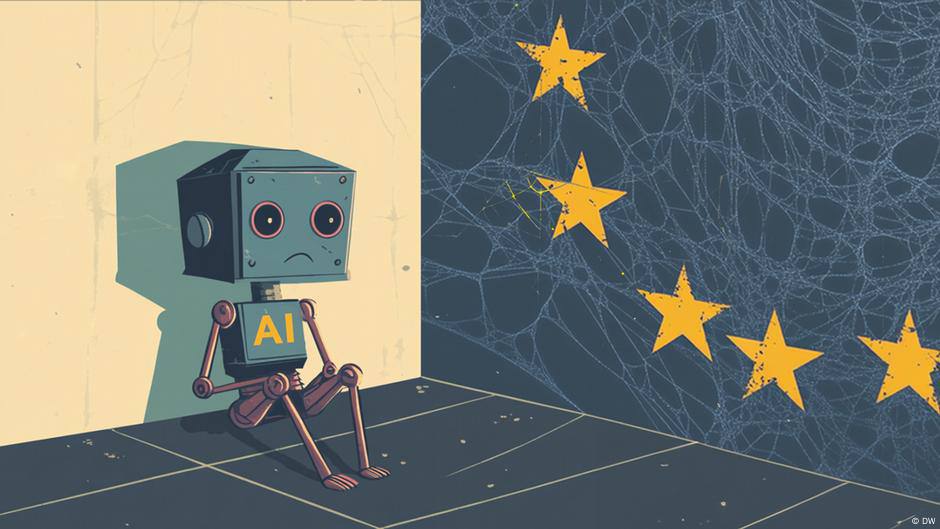

Вступили в силу новые требования ЕС к использованию ИИ

Шпроты в изгнании I Новости Латвии

В ЕС сегодня вступили в силу новые требования к использованию ИИ Требования относятся к ChatGPT и Gemini, которые могут использоваться как для генерации текста или изображений, так и для программирования. Согласно новым правилам, разработчики ИИ обязаны раскрывать принципы работы своих моделей и данные, использованные для их обучения. Самые продвинутые модели, считающиеся потенциальными источниками рисков для общественности, обязаны документировать принимаемые меры безопасности. Нововведения направлены в том числе на защиту интеллектуальной собственности и прав авторов и владельцев контента.

ВЫХОД К ПРАВДЕ

Новые правила для ИИ вступили в силу в Евросоюзе В Европейском союзе начали действовать требования к прозрачности в работе систем искусственного интеллекта общего назначения. Детали Новые нормы касаются таких моделей, как ChatGPT, Gemini и другие, способные генерировать текст, изображения или программный код. Правила Разработчики обязаны раскрывать принципы функционирования ИИ и источники данных, использованных для обучения моделей. Для продвинутых систем, представляющих потенциальный риск для общества, предусмотрена обязательная документация мер безопасности. Частные лица получили право подавать иски в случае нарушения своих прав со стороны ИИ-систем. Новый надзорный орган — Европейское агентство по ИИ European AI Office — начнёт проверку новых моделей с августа 2026 года. Те, что были выпущены до 2 августа 2025 года, будут проверяться начиная с августа 2027-го. Подробнее — на сайте Ulysmedia.kz

Банкста

В ЕС под угрозой штрафов начали требовать от разработчиков раскрывать, на чем обучены их модели ИИ. Компании, выпускающие подобные модели, теперь обязаны публиковать сводку данных, использованных для обучения, раскрывать архитектуру и принципы работы своих систем, а также документировать принятые меры по обеспечению безопасности. В случае нарушений компаниям грозят штрафы в размере до €35 млн евро или 7% от глобального оборота за предыдущий год.

digital times

В ЕС вступили в силу новые требования к использованию ИИ. Требования относятся к ChatGPT и Gemini, которые могут использоваться как для генерации текста или изображений, так и для программирования. Согласно новым правилам, разработчики ИИ обязаны раскрывать принципы работы своих моделей и данные, использованные для их обучения. Самые продвинутые модели, считающиеся потенциальными источниками рисков для общественности, обязаны документировать принимаемые меры безопасности. Нововведения направлены в том числе на защиту интеллектуальной собственности и прав авторов и владельцев контента. #dtновости #новости

Старая площадь

Центр концентрации мировой бюрократии зарегулировал искусственный интеллект. В Евросоюзе вступили в силу требования к ИИ. Согласно новым правилам, разработчики ИИ в ЕС обязаны раскрывать принципы работы своих моделей и данные, использованные для их обучения. Модели, считающиеся потенциальными источниками рисков, должны документировать меры безопасности. Закон относится к ИИ общего назначения. Например, таким чат-ботам, как ChatGPT и Gemini. Естественно создан отдельный орган надзора и регулирования. European AI Office начнет проверять новые модели с августа 2026 года, а модели, выпущенные до 2 августа 2025 года, - с августа 2027-го. Будут следить, чтобы ИИ не дай бог не выдал информацию про два биологических пола и статистику преступлений среди мигрантов.

Кролик с Неглинной

Со 2 августа в ЕС действуют новые правила для генеративного ИИ. Разработчики должны раскрывать данные о работе своих моделей ИИ, включая используемые для их обучения, и о мерах безопасности. Также частные лица и компании теперь могут подавать в суд на создателей ИИ-систем за нарушения в области авторских прав и интеллектуальной собственности, пишет ERR.

Сарымсақ

Новые правила для ИИ вступили в силу в Евросоюзе В Европейском союзе начали действовать требования к прозрачности в работе систем искусственного интеллекта общего назначения. Детали Новые нормы касаются таких моделей, как ChatGPT, Gemini и другие, способные генерировать текст, изображения или программный код. Правила Разработчики обязаны раскрывать принципы функционирования ИИ и источники данных, использованных для обучения моделей. Для продвинутых систем, представляющих потенциальный риск для общества, предусмотрена обязательная документация мер безопасности. Частные лица получили право подавать иски в случае нарушения своих прав со стороны ИИ-систем. Новый надзорный орган — Европейское агентство по ИИ European AI Office — начнёт проверку новых моделей с августа 2026 года. Те, что были выпущены до 2 августа 2025 года, будут проверяться начиная с августа 2027-го. Подробнее — на сайте Ulysmedia.kz

Деньги. Инвестиции. Налоги

2 августа 2025 вступили в силу нормы Европейского регламента об ИИ Ai Act для компаний Речь о генеративных системах ИИ, который создаёт новое текст, изображения, видео и т. д. Поставщики обязаны: в явном виде указывать, что контент создан ИИ указывать и обосновывать источники данных, использованных для генерации объяснять, как работает ИИ: в чём её функциональность и какие ошибки возможны. контроль за публикуемым содержимым и делать публично доступными отчёты о процессе обучения модели ‼ Если поставщик или система существовали до 2 августа 2025, льготный период до 2 августа 2027, чтобы привести свою деятельность в соответствие с новыми требованиями 2 февраля 2025 вступили в силу первые запреты - ИИ с неприемлемым уровнем риска 2 августа 2025 - нормы прозрачности и требования к генеративному ИИ вступают в силу Далее 2026 -2027 г постепенно вводятся нормы для ИИ высокого риска и продуктов из систем безопасности Регламент запрещает использование манипулятивных, глубоко скрытых или обманных техник воздействия, систем, которые оценивают эмоциональное состояние или предсказывают преступную деятельность только на основе личностных характеристик С 2 августа 2025 или позже, в зависимости от типа ИИ органы могут применить штрафы до 35 млн €, или до 7% годового оборота компании за нарушение прав на приватность, безопасность или здоровье В Испании полномочия получает Agencia Española de Supervisión de la Inteligencia Artificial AESIA . Агенство будет действовать совместно с Agencia Española de Protección de Datos AEPD , которая сохраняет компетенции в сфере защиты персональных данных 2 августа 2025 также началось применение Кодекса хороших практик. Более 25 компаний Google, Amazon, OpenAI, IBM, Microsoft и др. уже подписали соглашения или обязались следовать его принципам: прозрачность, недискриминация, защита авторских прав. Meta, Baidu, Alibaba отказались подписать, и им придётся иначе демонстрировать соблюдение норм P.S. мои все все все картинки нарисованы ИИ, честно честно #ИИ #Ai #европа

Похожие новости

+5

+5

+11

+11

+2

+2

Anthropic запускает 10 ИИ агентов для оптимизации финансовых процессов

Технологии

1 день назад

+5

+5

Роскомнадзор подает иски к крупнейшим игровым студиям за отказ локализовать данные игроков

Игры

10 часов назад

+11

+11

OpenAI запускает рекламную платформу ChatGPT с новыми возможностями для бизнеса

Технологии

1 час назад

Исследование: ИИ увеличивает рабочую нагрузку сотрудников

Технологии

1 день назад

Apple анонсирует возможность выбора сторонних ИИ моделей в iOS 27

Технологии

1 день назад

Крупные IT и игровые компании покидают Россию из-за ограничений

Политика

1 день назад

+2

+2