15 января, 21:03

Google представляет архитектуру Titans для улучшения обработки данных в ИИ

Все о блокчейн/мозге/space/WEB 3.0 в России и мире

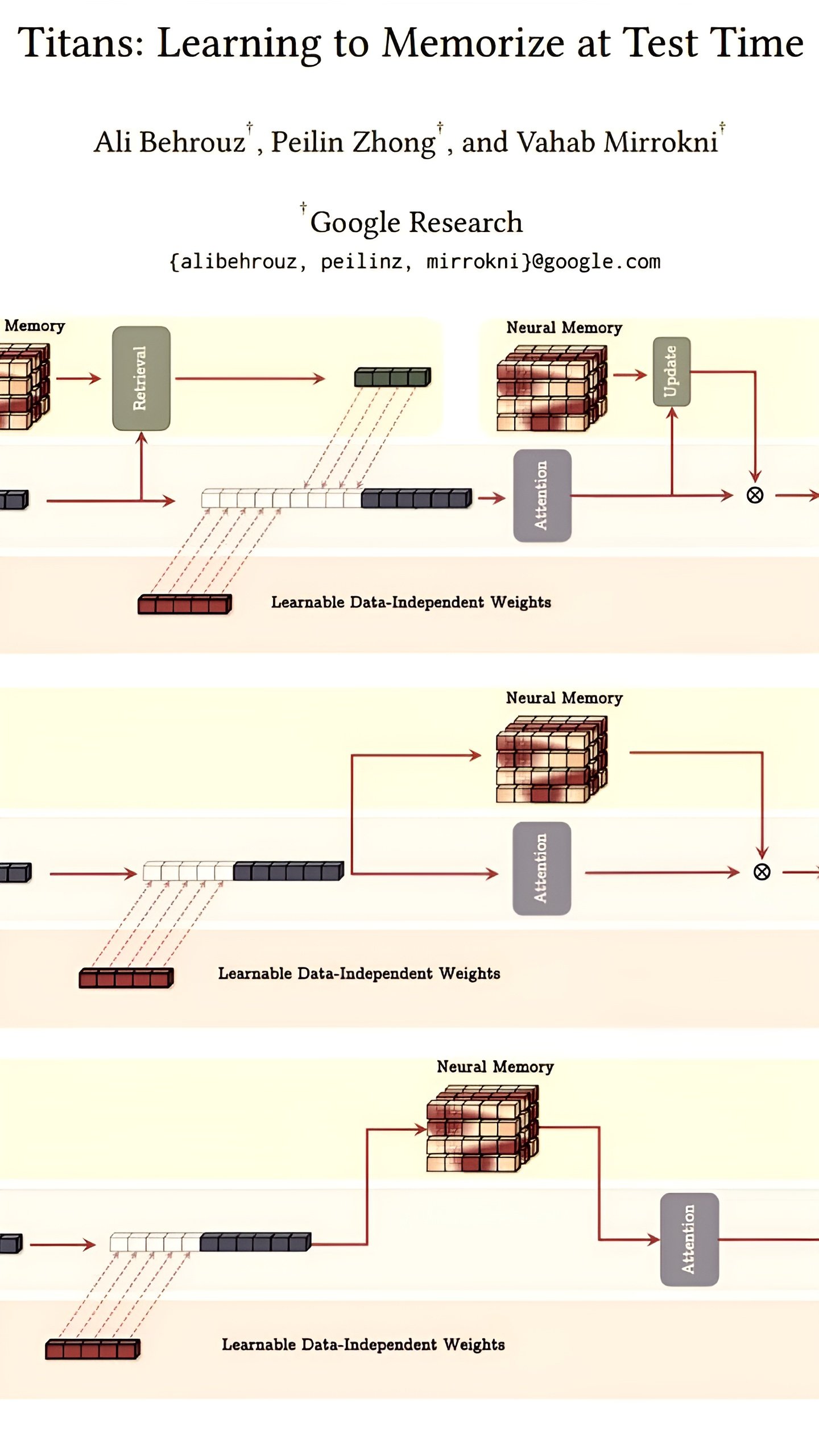

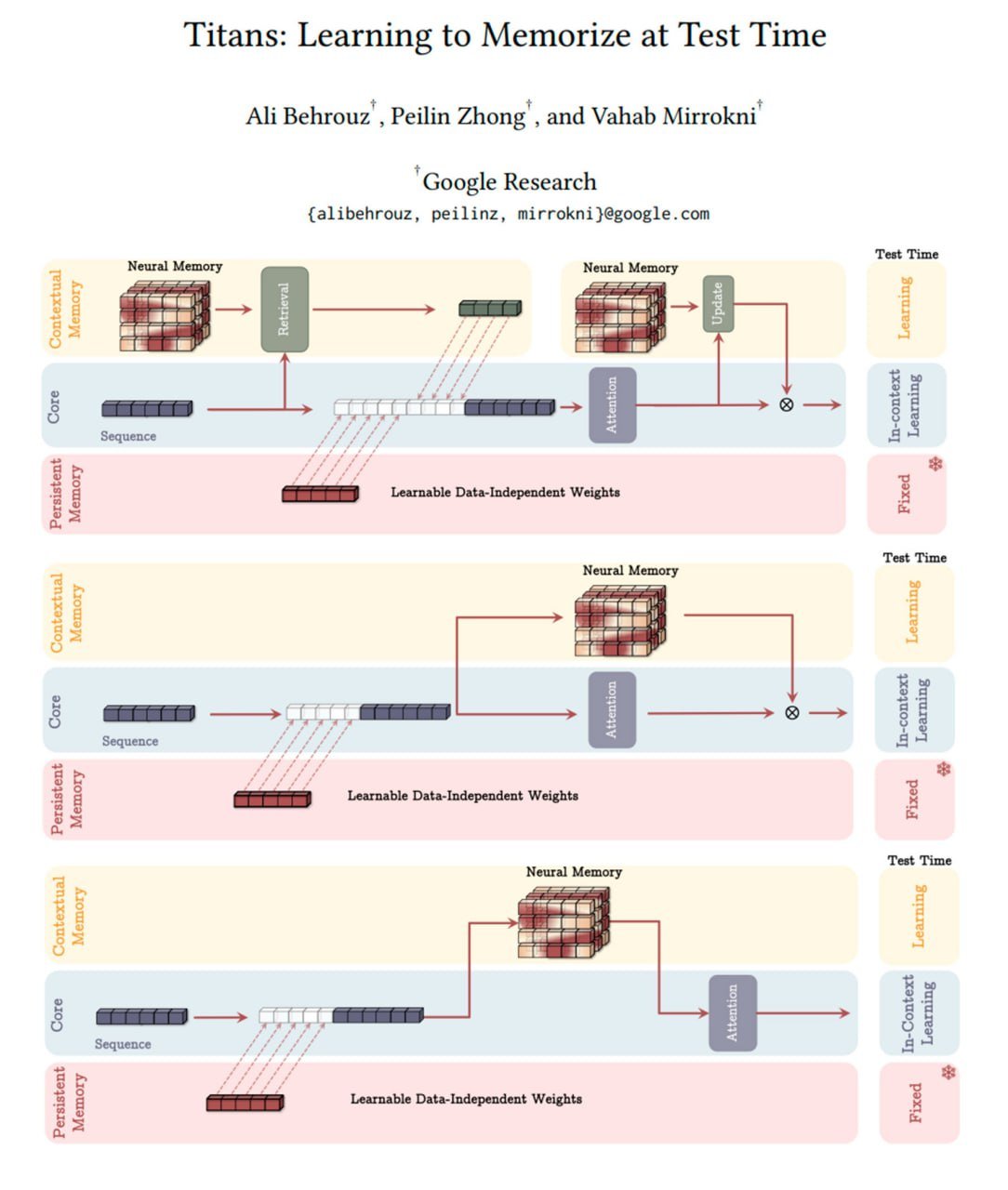

Google представили новую архитектуру Titans Исследователи из Google Research представили новый подход к обработке длинных последовательностей данных, вдохновленный работой человеческой памяти. Современные языковые модели сталкиваются с серьёзным ограничением: они могут эффективно обрабатывать только ограниченный объем контекста как наша краткосрочная память - около 30 секунд . Это создает проблемы при анализе длинных текстов, где важна информация из далекого прошлого. Исследователи разработали Titans с тремя типами памяти: 1. Краткосрочная память механизм внимания - для точной обработки текущего контекста 2. Долговременная память - для хранения важной информации из прошлого 3. Постоянная память - для хранения общих знаний о задаче Система учится запоминать важную информацию так же, как это делает человеческий мозг - фокусируясь на неожиданных и значимых событиях. При этом используется умный механизм "забывания", позволяющий освобождать память от неактуальной информации. Преимущества: • Может работать с контекстом длиной более 2 млн токенов • Превосходит существующие модели в задачах обработки языка • Эффективно использует вычислительные ресурсы • Может применяться в различных областях: от анализа текстов до биоинформатики

Цифровой Журнал | IT, ChatGPT

Титаны уничтожили трансформеров — Google совершили прорыв в ИИ Речь про новую архитектуру нейросетей. Традиционно в основе больших языковых моделей лежат трансформеры. За много лет использования у них было выявлено несколько серьезных изъянов: Обработка ограниченного объема данных. Потеря контекста. Проблемы с запоминанием деталей. Google решили прокачать эту архитектуру, добавив три типа памяти. Назвали они свое творение «Titans». Вот основные преимущества: Повышенное внимание: модель обладает как историческим, так и текущим контекстом и решает, какую информацию вытянуть из памяти. Модель способна определять полезность информации и хранить только нужную. Это позволяет в разы лучше управлять объемом памяти. САМОЕ КРУТОЕ: «Титаны» могут обрабатывать 2 МИЛЛИОНА токенов в одном чате. Вы можете за раз скормить нейросети для анализа почти 2 полных саги о «Гарри Поттере» 2 раза по 8 книг . Именно «Титаны» должны стать фундаментом в развитии ИИ в 2025 году. Ждем громких прорывов!

Регнум

Google представил архитектуру искусственного интеллекта Titans, который превосходит все существующие разработки Titans работает по принципу человеческого мозга и включает долгосрочную, краткосрочную и постоянную память, позволяя выборочно забывать ненужную информацию и запоминать важное. Модель поддерживает параллельную обработку данных, что ускоряет обучение. В задачах моделирования разработка превосходит существующие ии-модели. Для примера, GPT-4 одновременно обрабатывает лишь 4 тысячи токенов, в то время как Titans обрабатывает уже до 2 миллионов токенов, то есть буквально анализирует примерно 25 книг за раз, — говорится в официальной статье разработчиков. Регнум

Айтишник | Апи | Технологии

Google представили революционную архитектуру искусственного интеллекта Titans, которая работает по принципу человеческого мозга и в некоторых задачах даже превосходит его В Titans реализована долгосрочная, краткосрочная и постоянная память. Эта модель теперь может выборочно забывать ненужную информацию, запоминая важное. Как и мозг человека, долгосрочная память обучается и обновляется, адаптируясь к новой информации, а также поддерживает параллельную обработку данных, что ускоряет обучение и делает систему более эффективной. В задачах моделирования, прогнозирования Titans превосходит все современные модели. Например, если в контекстном окне GPT-4 всего 4 тысячи токенов, в Titans их 2 миллиона. То есть буквально можно проанализировать примерно 25 средних книг за раз. Айтишник Подписаться

Hi, AI! | Нейросети и технологии

Инженеры Google хотят сделать нейросети эффективнее, научив их удивляться и забывать Большинство нейросетей плохо справляются с обработкой длинных потоков данных и выведением новых знаний при рассуждении — хотя это главные навыки для решения задач в реальном мире. Память нейросети представляет собой большую неструктурированную матрицу, в которой легко «запутаться». Новая архитектура «Титан», представленная в исследовании инженеров Google Research, должна приблизить ИИ к возможностям человеческого мозга благодаря многокомпонентной памяти. Как это работает? Как и у человека, память Титана состоит из трех сегментов. Кратковременной — внимание на текущей задаче, долговременной — с данными о прошлом и постоянной — независящие от контекста базовые знания. Нейросеть умеет удивляться: неожиданную информацию ИИ запомнит тщательнее. А неиспользуемые данные может «забыть», чтобы высвободить ресурсы. Титан продолжает обучаться во время работы, непрерывно фильтрует информацию на важную и ненужную, а кластеры памяти постоянно взаимодействуют между собой. Новая архитектура до двух раз превосходит GPT-4, Llama3-80B и другие модели в тестах на рассуждение и извлечение информации из очень больших текстов и в реальных задачах, например, моделировании ДНК. Титан без проблем работает с данными объемом более 2 млн токенов около 6 тыс. страниц текста . Экспериментальные модели Gemini от Google могут оперировать таким же объемом, но менее эффективно. Для сравнения, контекстное окно GPT-4 — 128 тыс. токенов. Еще по теме: «Машинная психология» — ИИ, умеющий рефлексировать Преграды на пути к сильному ИИ , AI! #новости #Google #наука

Джарвис Ньюс | Нейросети

Только что произошла главная революция в ИИ за много лет — Google перевернули обычную архитектуру нейронок. Новая система Titans станет главным двигателем прогресса в 2025 году! Коротко о важном прорыве, который приблизил нас к AGI: • В основе LLM лежат трансформеры — они обрабатывают ограниченный объем данных, забывают детали и отвлекаются на неважные вещи. • Учёные из Google добавили в эту архитектуру аж три типа памяти — получились система «Титаны»! Внутри есть краткосрочная, долгосрочная и постоянная память. • Работает как человеческий мозг — намеренно забывает неактуальную инфу, а в долгосрочную память кладёт только самое важное для запоминания. • В результате «Титаны» запоминают 2 миллиона токенов в одном чате! Можно загрузить на анализ три полных версии «Войны и мир» ЗА ОДИН РАЗ. • Это больше, чем у любых нейронок, и применимо для ЛЮБЫХ задач! Скрестили пальцы, 2025 год — год появления сознания у искусственного интеллекта. Новости AI • Бот Midjourney

xCode Journal

Google придумали трансформеры 2 Это новая архитектуру Titan, которая должна решить проблему короткого контекста у нейросетей. Одна из главных проблем LLM в том, как мало инфы они могут «помнить» — вы могли заметить, что если достаточно долго общаться с ChatGPT, то со временем он начинает забывать текст, который вы писали в начале диалога. Чтобы избежать такого эффекта, Google предлагает добавить еще один вид памяти: долгосрочную. xCode Journal

CIO: канал IT руководителей

Google представил новую архитектуру нейронных сетей под названием Titans, которая обещает стать движущей силой прогресса в 2025 году // Цифровой Журнал Основные моменты нового подхода: • Современные большие языковые модели LLM используют трансформеры, которые обрабатывают ограниченное количество данных и могут забывать важные детали. • Ученые Google интегрировали три типа памяти в архитектуру, создав систему «Титаны»: краткосрочную, долгосрочную и постоянную память. • В отличие от текущих моделей, новая система функционирует подобно человеческому мозгу, забывая неактуальную информацию и сохраняя лишь самое важное. • Результатом является способность «Титанов» запоминать до 2 миллионов токенов в одном чате, что позволяет анализировать тексты объемом в три полных версии «Войны и мира» за один раз или 2 полных саги о «Гарри Поттере»: 2 раза по 8 книг .

Кибер Дача 🕹️

Google сделал значительный шаг вперед в развитии искусственного интеллекта, разработав новую архитектуру под названием Titans, которая функционирует на подобие человеческого мозга. Основные особенности Titans: — Titans включает три уровня памяти: краткосрочную, долгосрочную и постоянную. Модель самостоятельно решает, что сохранить, а что удалить из своей памяти. — Долгосрочная память постоянно обучается и обновляется, адаптируясь к свежим данным. — Параллельная обработка информации ускоряет процесс обучения и делает систему предельно эффективной. — По точности прогнозирования и моделирования Titans превосходит ведущие модели, легко справляясь с анализом геномов, временных рядов и других сложных задач. — Удивительный размер контекстного окна: у GPT-4 это максимально 4 тысячи токенов, а у Titans — 2 миллиона, что эквивалентно одновременному чтению и пониманию 25 книг.

Новости IT | Мир Программиста

Google представили новую архитектуру нейронок — Titans Новый подход к обработке длинных последовательностей данных вдохновлен работой человеческой памяти. Современные языковые модели сталкиваются с серьёзным ограничением: они могут эффективно обрабатывать только ограниченный объем контекста как наша краткосрочная память . Исследователи разработали систему с тремя типами памяти: 1. Краткосрочная память механизм внимания - для точной обработки текущего контекста 2. Долговременная память - для хранения важной информации из прошлого 3. Постоянная память - для хранения общих знаний о задаче Система учится запоминать важную информацию так же, как это делает человеческий мозг - фокусируясь на неожиданных и значимых событиях. При этом используется умный механизм "забывания", позволяющий освобождать память от неактуальной информации.

Похожие новости

+1

+1

+2

+2

+26

+26

+23

+23

+3

+3

Исследование: Мозг продолжает воспринимать речь под наркозом

Наука

1 день назад

Завершение производства Tesla Model S и X: последние автомобили сошли с конвейера

Технологии

8 часов назад

+1

+1

Начало реставрации мемориала Защитникам Советского Заполярья: работы стартуют после Дня Победы

Общество

8 часов назад

+2

+2

Объявление нового Католикоса Патриарха Всея Грузии состоится 11 мая

Общество

4 часа назад

+26

+26

Минздрав РФ внедряет ИИ для снижения нагрузки на медиков

Наука

8 часов назад

+23

+23

Исследование показывает ускоренное таяние Антарктиды из-за теплой океанской воды

Общество

1 день назад

+3

+3