15 октября, 05:47

Исследование показывает риски использования медицинских советов от Microsoft Copilot

Естественный интеллект: новости науки и техники

Советы нейросети Microsoft Copilot могут привести к смерти в 22% случаев Советы нейросети Microsoft Copilot могут нанести серьезный ущерб здоровью человека или даже привести к смерти как минимум в 22% случаев, заявили исследователи из Германии и Бельгии, сообщил 13 октября веб-сайт Windows Central. В ходе эксперимента исследователи предложили Copilot дать ответы на 10 самых популярных вопросов, которые задают жители США о популярных лекарственных средствах и медикаментах. В общей сложности было получено 500 ответов, которые оценивались по точности и полноте, а также другим критериям. Результаты оказались не слишком обнадеживающими. Подробнее

Лента дня

Советы нейросети Microsoft могут вас убить. Немецкие учёные расспросили встроенную в Windows нейросеть Copilot про лекарственные препараты и выяснили, что половина ответов была в корне неверной. 42% неверных советов приводили к лёгкому или среднему вреду, а 22% — к летальному исходу. И только 36% были просто безвредными. Восстание машин не за горами

Хайтек

Исследователи выяснили, что ИИ-бот Microsoft Copilot может давать опасные медицинские советы. Только половина ответов соответствовала научным данным, а 22% рекомендаций могли привести к серьёзным последствиям для здоровья. По старинке берем талончик к врачу

Инновации в фармацевтике

Советы нейросети Microsoft оказались опасны для жизни Специалисты Университета имени Фридриха — Александра в Эрлангене и Нюрнберге поделились предварительными результатами научной работы о пользе искусственного интеллекта ИИ и чатботов в предоставлении медицинских консультаций. Чтобы оценить работу ИИ, они использовали нейросеть Copilot от Microsoft, встроенную в Windows. Медики не согласились примерно с половиной медицинских советов, которые Copilot давал пользователям. Более того, некоторые из них оказались опасными для жизни. Читать далее на сайте #инновации_мировой_фармы

Милосердие

Советы нейросетей насчет лекарств могут привести к смерти, выяснили немецкие ученые Немецкие ученые решили выяснить, можно ли доверять искусственному интеллекту в вопросе подбора лекарств. Нейросети Copilot задали по 10 вопросов о действии и побочных эффектах пятидесяти популярных препаратов. Однозначно правильных ответов не оказалось, а некоторые даже способны привести к смерти. 66% ответов специалисты оценили как потенциально вредные, 42% причиняют умеренный или легкий вред, а 22% способны нанести ущерб здоровью вплоть до смерти пациента. Кроме того, ответы чат-бота могут быть непонятны неподготовленному пациенту. Медиков и их пациентов авторы исследования призвали пользоваться искусственным интеллектом с осторожностью, пока поисковые системы на его основе не будут усовершенствованы.

Новости в Мире IT

Исследование: Copilot в половине случаев дает неправильные ответы на самые популярные медицинские вопросы. А более 20% его советов могут привести к серьезным проблемам со здоровьем и даже смерти.

Хакерство | Личная Безопасность

Медицинские советы ИИ-бота Microsoft Copilot могут привести к смерти, по крайней мере в 22 % случаев Не секрет, что современные чат-боты на базе искусственного интеллекта, такие как Microsoft Copilot, далеки от идеала и полностью доверять их советам не стоит. Это подтвердили исследователи из Германии и Бельгии, которые оценили способность бота давать медицинские советы. Оказалось, что точную с научной точки зрения информацию Copilot предоставлял чуть более чем в половине случаев. Порой же его советы могли нанести серьёзный ущерб здоровью человека или даже привести к смерти. В ходе эксперимента исследователи предложили Copilot дать ответы на 10 самых популярных вопросов, которые задают жители США о популярных лекарственных средствах и медикаментах. В общей сложности было получено 500 ответов, которые оценивались по точности и полноте, а также другим критериям. Результаты оказались не слишком обнадёживающими.

Medical Ксю

#ИИ #СППВР Медицинские советы Bing Copilot в одном из пяти случаев могут привести к смерти Немецкие ученые обнаружили, что рекомендации по лечению от чат-бота Copilot на базе искусственного интеллекта ИИ от Microsoft в одном из пяти случаев могут привести к смерти. Исследование было опубликовано в BMJ Quality и Safety. В ходе исследования ученые из Университета Эрлангена-Нюрнберга выделили 10 наиболее часто задаваемых пациентами вопросов относительно 50 наиболее назначаемых препаратов в США. К ним относятся побочные реакции на лекарства, инструкции по применению и противопоказания к назначению средств. Используя Bing Copilot — поисковую систему с функциями чат-бота на базе искусственного интеллекта, разработанную корпорацией Microsoft, — исследователи сравнили все 500 ответов с ответами фармацевтов и врачей. Ответы чат-бота также сравнивались с рецензируемым веб-сайтом с актуальной информацией о лекарственных средствах. Исследователи обнаружили, что ответы чат-бота не соответствовали справочным данным более чем в четверти 26% всех случаев и противоречивы в 3% случаев. Последующий анализ сомнительных ответов показал, что 42% рекомендаций из них могли причинить легкий или средней вред здоровью человека, а 22% привести и вовсе привести к смерти. Также для понимания многих ответов чат-бота требовалось наличие медицинского образования. Вывод очевиден: доктор из Copilot пока никакой.

Пирамида 👁🗨

Первая смерть от ИИ может произойти не из-за роботов-убийц, а из-за дезинформации, которой еще грешат нейросети. Так, нейросеть Microsoft Copilot предлагает «смертельно опасные» советы с частотой 22%, выяснили исследователи.

АВРОРА⭕️ХАЙТЕК®Z🇷🇺

ИИ СОВЕТЫ НЕЙРОСЕТИ MICROSOFT ОКАЗАЛИСЬ ОПАСНЫ ДЛЯ ЖИЗНИ Немецкие ученые оценили пользу искусственного интеллекта ИИ и чатботов в предоставлении медицинских консультаций. Специалисты Университет имени Фридриха — Александра в Эрлангене и Нюрнберге Германия в середине октября поделились предварительными результатами научной работы. Чтобы оценить пользу ИИ, они использовали нейросеть Copilot от Microsoft, встроенную в Windows. Медики оказались несогласны примерно с половиной медицинских советов, которые Copilot предлагал пользователям. В ходе тестирования ученые задали чат-боту 10 популярных вопросов, касающихся 50 лекарственных препаратов, получив в общей сложности 500 запросов. Выяснилось, что лишь 54 процента ответов соответствовали научному консенсусу, а значительная часть из них предоставляла опасность для здоровья и жизни. Из неверных ответов 42 процента советов приводили к легкому или среднему вреду, 22 процента — летальному исходу. Лишь 36 процентов из неверных ответов нейросети были признаны безвердными. «Несмотря на потенциал ИИ, для пациентов по-прежнему важно консультироваться со своими врачами — живыми специалистами», — подчеркнули ученые. ФОТО: Unsplash #аврорамедиа_хайтек Telegram-экосистема АВРОРА МЕДИА МЕДИА НОВОСТИ РЕГИОН ЛАЙФ СПОРТ ГЕРЛЗ ХАЙТЕК ПЕРСОНЫ ИНСАЙД КРИМИНАЛ МОЛОДОСТЬ LIVE АВРОРА МЕДИА YOUTUBE RUTUBE

Похожие новости

+27

+27

+1

+1

+4

+4

+2

+2

Минздрав РФ внедряет ИИ для снижения нагрузки на медиков

Наука

20 часов назад

+27

+27

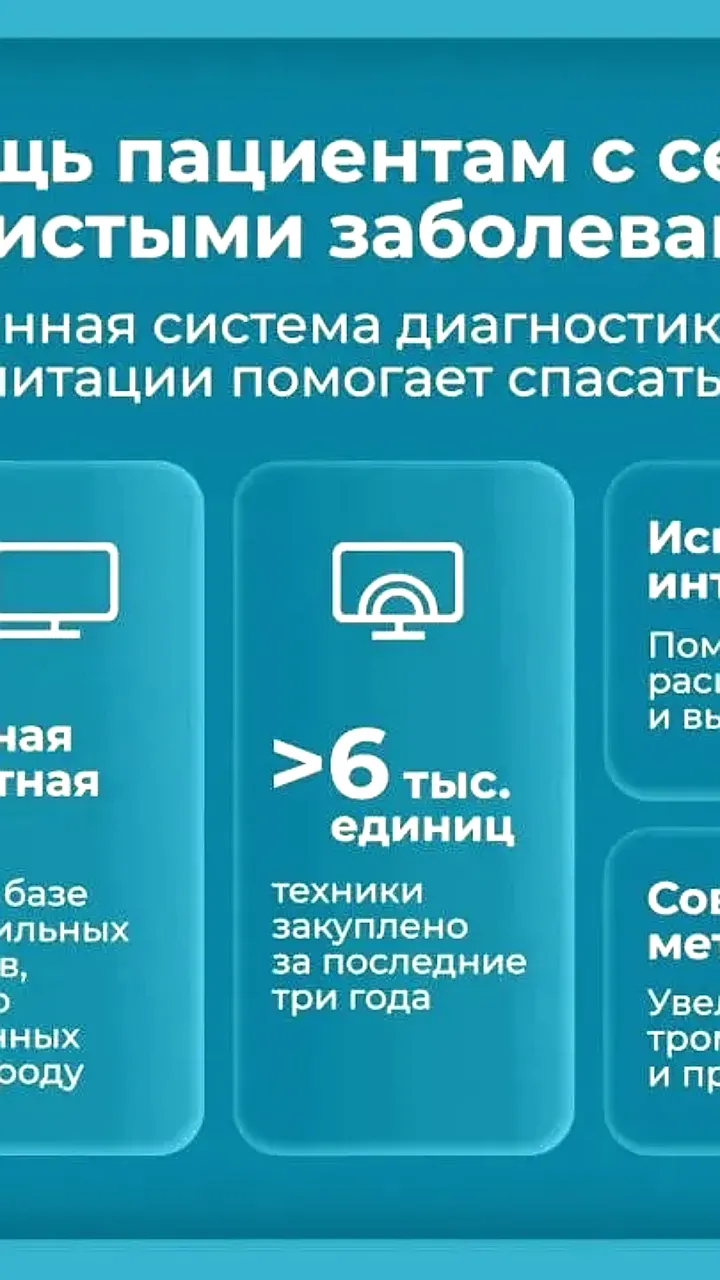

В Москве улучшены показатели лечения сердечно-сосудистых заболеваний благодаря новым медицинским подходам

Происшествия

14 часов назад

Катер вылетел на берег Невы в Отрадном, пострадали две женщины

Происшествия

1 день назад

+1

+1

Серьезное ДТП на Эльмаше: кроссовер столкнулся с мотоциклом

Происшествия

1 день назад

+4

+4

Мошенники используют поддельные CAPTCHA для кражи данных пользователей

Происшествия

14 часов назад

+2

+2

Опрос Gartner: Внедрение ИИ не привело к росту рентабельности у 80 компаний

Экономика

11 часов назад