2 августа, 13:47

Google представляет новую модель Gemma 2 2B с улучшенной архитектурой и функционалом

Data Secrets

Воу: Google выпустила SOTA LLM в размере 2В Мини-версия вышедшей месяц назад Gemma-2 на 2В параметров бьет рекорды. На арене она уже обошла даже GPT-3.5 Turbo, не говоря уже о моделях своего размера. Архитектура: написано, что эта модель дистиллирована из другой вот тут мы писали, как такое работает , но из какой и на сколько параметров, не уточняется. Также благодаря поддержке softcapping во Flash Attention след атеншена в памяти теперь линейный вместо О N^2 . Но и это не все: плюсом к модели вышло еще семейство классификаторов ShieldGemma для фильтрации вредоносного контента, а также Gemma Scope. Это сет автоенкодеров для интерпретации модели и ее оценки. Ну кайф! Блогпост Веса

DNS_Club

Выпущена эффективная модель ИИ Google Gemma 2 2B — компактнее, но мощнее GPT 3.5 Turbo Google представила новую модель ИИ под названием Gemma 2 2B. Она построена на базе выпущенной этим летом LLM Gemma 2, но при этом существенно легче, а по возможностям обходит даже GPT 3.5 Turbo. Читать далее

Хайтек+

Новая компактная языковая модель Gemma 2 2B от Google превосходит GPT 3.5 Turbo Google представила Gemma 2 2B — компактную, но мощную модель искусственного интеллекта, которая может составить конкуренцию лидерам отрасли, несмотря на небольшой размер. Новая языковая модель содержит всего 2,6 млрд параметров, но демонстрирует производительность на уровне или даже выше гораздо более крупных аналогов, включая GPT-3.5 и Mistral AI Mixtral 8×7B. Благодаря своей компактности и производительности Gemma 2 2B подойдет для мобильным приложений. Этот релиз свидетельствует о том, что отрасль движется в сторону создания более энергоэффективных и доступных моделей ИИ.

Invest Smart

Google обновила линейку открытых ИИ-моделей Корпорация Google выпустила три новые модели генеративного искусственного интеллекта c открытым исходным кодом, позиционируя их как более «безопасные, компактные и прозрачные» по сравнению с другими. Gemma 2 2B — версия модели с 2 млрд параметров, отличается улучшениями в области безопасности, предлагает «баланс производительности и эффективности»; ShieldGemma — созданный на основе Gemma 2 комплект нейросетей для классификации безопасного контента; Gemma Scope — новый инструмент для интерпретации моделей, который позволяет получить представление об их внутреннем устройстве. Они являются дополнениями к выпущенному в июне семейству Gemma 2. Gemma 2 2B — это легкая модель для создания текста. Она может работать на аппаратных устройствах вроде ноутбуков, лицензирована для определенных исследовательских и коммерческих приложений. ShieldGemma стремится обнаруживать вредоносный материал вроде разжигания ненависти, домогательств и откровенного сексуального контента. Она используется для фильтрации промптов к ИИ и генерируемого им контента.

The Open Ai | Нейросети

Вышел ИИ от Google, которая пашет от мобилки смартфона и убивает GPT-3.5 Gemma-2-2B запуститься даже на древнем компе времен Ельцина. Llama 2, GPT-3.5 и Mixtral нервно курят в сторонке — Gemma быстро щёлкает код, знает десятки языков. Для установки хватит 3 ГБ оперативной памяти. Качаем тут.

эйай ньюз

Google выпустил Gemma 2 2B Модель - SOTA в своей весовой категории, запускается везде: в браузере, на телефоне, на посудомойке. На арене перегоняет даже GPT 3.5, но веры арене теперь нет. Модель дистиллировали из какой-то более жирной LLM какой именно не сказано , как это сейчас делают для большинства мелких моделек. Так как дистилляция даёт лучший результат чем тренировка с нуля. Но самое интересное в релизе - натренированные Sparse Autoencoder SAE для всех слоёв Gemma 2 2B и 9B. Это нейронки выделяющие отдельные фичи из активаций LLM. Они позволяют нам не только читать их "мысли", но и напрямую влиять на них! Если вы видели майское демо Golden Bridge Claude от Anthropic, то вы уже видели SAE в действии. На Neuronpedia выпустили демку, где каждый может поиграться с этим. На картинке - активность ряда топовых лаб на huggingface в этом году Веса модели Веса Sparse Autoencoders Демка "чтения мыслей" Gemma Ещё, умельцы уже запилили ноутбук для файнтюна модели в бесплатном коллабе.

GPT/ChatGPT/AI Central Александра Горного

Новая компактная Gemma 2 2B оказалась мощнее GPT-3.5 Модель Gemma 2 2B, разработанная Google Deepmind, по результатам бенчмарков, соответствует или превосходит более крупные модели, такие как GPT-3.5, Mixtral-8x7B и LLaMA-2-70B. При этом, Gemma 2 в десятки раз меньше своих конкурентов. Малый размер Gemma 2 2B позволяет использовать ее на недорогих и менее мощных устройствах. Gemma 2 2B доступна на Hugging Face и других платформах: — Курс «Бизнес на нейронных сетях»

Мы из будущего

Меньше, безопаснее, прозрачнее: Google представил компактную языковую модель Gemma 2 2B Google выпустил языковую модель Gemma 2 2B, которая, несмотря на небольшой размер в 2,6 млрд параметров, демонстрирует производительность, сопоставимую с более крупными моделями, такими как GPT-3.5 Turbo. В тесте LMSYS Chatbot Arena Gemma 2 2B набрала 1130 баллов, обойдя GPT-3.5-Turbo и Mixtral-8x7B. Модель также показала хорошие результаты в тестах MMLU и MBPP. Успех Gemma 2 2B демонстрирует, что эффективные методы обучения и высококачественные наборы данных могут компенсировать меньшее количество параметров. Модель имеет открытый код и доступна на платформе Hugging Face. Мы из будущего

AI Insider

Вышел ИИ от Google, которая пашет от мобилки смартфона и убивает GPT-3.5 Gemma-2-2B запуститься даже на древнем компе времен Ельцина. Llama 2, GPT-3.5 и Mixtral нервно курят в сторонке — Gemma быстро щёлкает код, знает десятки языков. Для установки хватит 3 ГБ оперативной памяти. Качаем тут.

Новости в Мире IT

Google выложила маленькую версию Gemma-2 — она с двумя миллиардами параметров превосходит GPT-3.5 с её 175 миллиардами. Самое крутое — ее можно локально запустить на слабом ноутбуке и даже смартфоне. Для установки требуется всего 3 ГБ оперативной памяти. Скачать исходники можно на HuggingFace.

Похожие новости

+5

+5

+3

+3

+3

+3

+7

+7

+41

+41

![Аватар Телеграм канала: TechGPT [🅽 🅴 🆆 🆂] 🤖](https://content.tek.fm/2972f683-eab7-4e0a-9c08-d11cb3f2e57d.jpg)

Google анонсирует обновление Gemini Intelligence и новые функции Android 17

Технологии

1 день назад

+5

+5

Thinking Machines анонсирует новые модели взаимодействия с ИИ для живого общения

Технологии

1 день назад

+3

+3

Google предотвращает первую атаку с использованием ИИ на двухфакторную аутентификацию

Технологии

17 часов назад

+3

+3

Google анонсировала ноутбуки Googlebook с интеграцией Gemini AI и стартом продаж осенью 2026 года

Технологии

15 часов назад

+7

+7

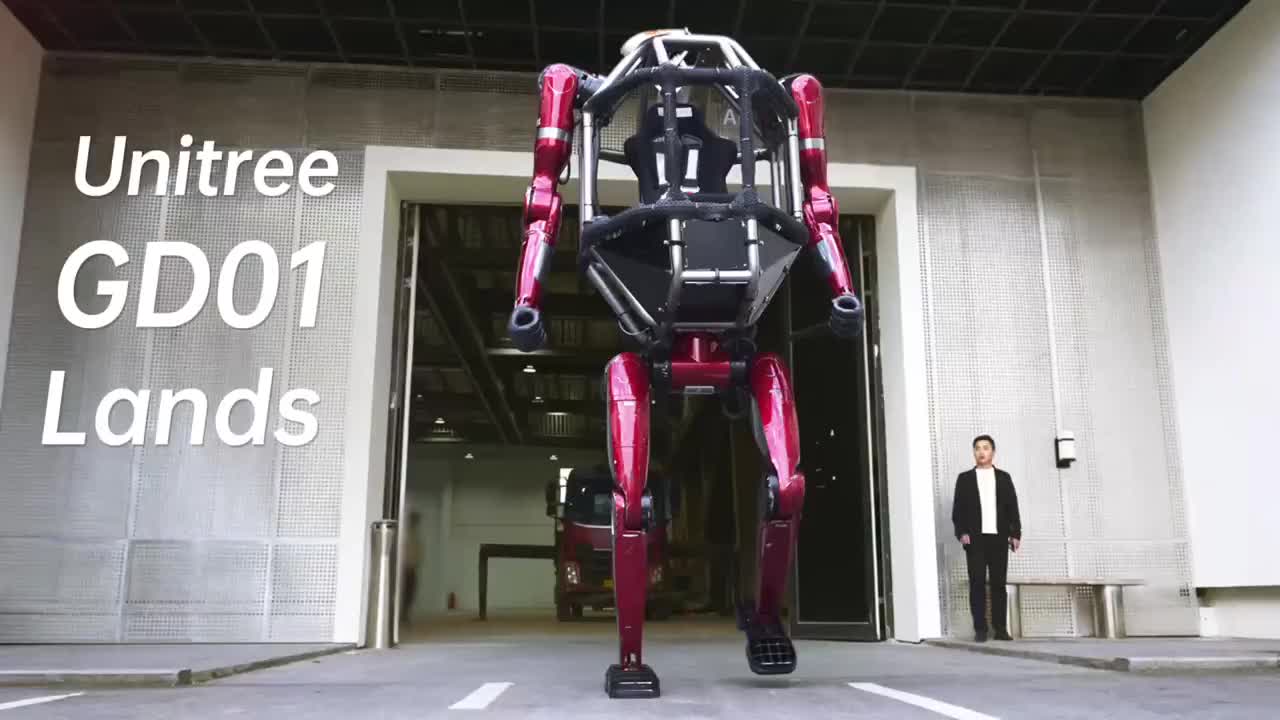

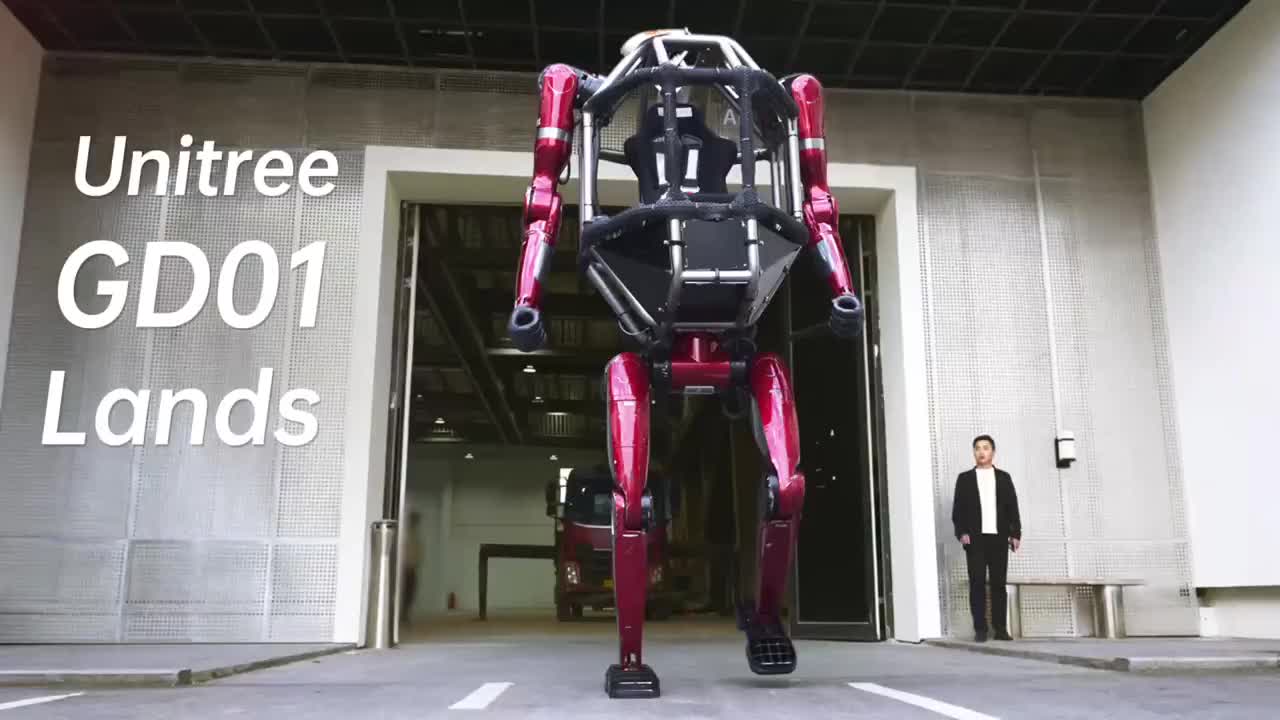

Unitree представила пилотируемого меха-робота для гражданского использования

Технологии

1 день назад

+41

+41

Новые ИИ-сервисы для преобразования речи в текст: от Яндекс до Nothing

Технологии

1 день назад

![Аватар Телеграм канала: TechGPT [🅽 🅴 🆆 🆂] 🤖](https://content.tek.fm/2972f683-eab7-4e0a-9c08-d11cb3f2e57d.jpg)