Droider

Gen-3 Alpha: из текста в видео! Стартап RunwayML анонсировал новую версию своей нейросети для создания видео — Gen-3 Alpha. Нейросеть будет поддерживать фирменные инструменты для редактирования RunwayML. Стартап обещает, что будут доступны кастомные модели, которые можно специально до обучить под нужный стиль. Генерации выглядят очень реалистично, на уровне Sora от OpenAI! Подробности и примеры можно посмотреть по этой ссылке.

Чёрный Треугольник

Gen-3 Alpha Компания Runway представила ИИ Gen-3 Alpha, первую в серии моделей, обученных на новой инфраструктуре для крупномасштабного мультимодального обучения. Эта новая модель значительно повышает точность, согласованность и динамичность по сравнению со своей предшественницей Gen-2. Gen-3 Alpha может как «Текст в видео», так «Изображение в видео» и «Текст в изображение» А также имеет различные режимы управления в том числе «Motion Brush». Gen-3 Alpha также отлично справляется с созданием фотореалистичных человеческих персонажей и выразительных жестов, предоставляя новые возможности для повествования.

Техномотель

Недели моделей текст-в-видео продолжаются: RunwayAI представили Gen-3 Alpha. Это первая тестовая модель, которую натренировали на 2D-изображениях. Дальше Runway планируют мощно прокачивать возможности и производительность модели. Хотя по качеству они уже претендуют на лидерство на рынке, пока Sora не вышла.

Сетевой Вестник

Runway представила Gen-3 Alpha – новый гиперреалистичный нейросетевой генератор видосов Модель станет доступна в ближайшие дни. Обещают высокую детализацию, плавные переходы и больше возможностей для управления видео. Длительность роликов будет 10 секунд и появится возможность обучения модели на собственных стилях. • Модель обучена на современной инфраструктуре для крупномасштабного мультимодального обучения и значительно улучшила точность, согласованность и движения по сравнению с Gen-2. • Gen-3 Alpha поддерживает различные режимы ввода и кастомизацию, что позволит создавать пользовательские версии моделей.

Дежурный smmщик

Runway AI представила нейросеть Gen-3 Alpha для генерации видео Судя по описанию на сайте, генераторов видео будет несколько, и Gen-3 Alpha – лишь первый и самый простой из них. Однако даже в этом случае прогресс на фоне предыдущего Gen-2 налицо. Авторы разместили десятки примеров роликов в качестве демонстрации возможностей новой модели. В Runway уверяют, что не применяли никакого редактирования к получившимся видео, и все опубликовано именно так, как было сгенерировано. Нейросеть стала более стабильной, избавилась от «шипения» в кадрах, некоторые видео выглядят настоящими. Как получить доступ? На данный момент точной даты выхода нет, Runway лишь показала демо-видео на своем сайте и в Twitter / X. Также неясно, будет ли она доступна на бесплатном тарифе Runway или для доступа к ней потребуется платная подписка.

эйай ньюз

Вышла Gen3-Alpha - очередная text-2-video модель Ситуация на поле видеогенерации прост раскаляется. Почти каждый день выходят новые модели. Вот и Runway показали свою — генерит по 10 сек видео, что больше чем у конкурентов. Авторы заявляют, что Gen-3 Alpha является первой из серии моделей, которые обучены Runway на новой инфраструктуре для large-scale мультимодального обучения. Модель значительно улучшили по сравнению с Gen-2 [уж, надеюсь! гляньте что он вытворял раньше] в плане точности, конситентности и движения. Якобы это шаг к созданию общих моделей мира расхайпованые World Models . Обещают улучшеный контроля над генерацией с помощью дополнительный тулов Motion Brush, Advanced Camera Controls, Director Mode . Ну посмотрим, че. Модель пока нельзя никому потрогать, да и тех-репорта даже нет. Только примеры на сайте показали, которые выглядят хорошо! Ждём хоть чего-нибудь такого в опенсорсе наконец. Блогпост с примерами

Не баг, а фича

Runway уничтожает Dream Machine — наглядное сравнение нейронок на видео. Новая GEN-3 генерит ультра-реалистичные шедевры в два раза дольше до 10 секунд. В виде запроса можно загрузить текст и картинки, а в будущем добавят инструменты для точечного контроля кадра. Сейчас из видео-генераторов можно попробовать Luma, Krea, Pika и Stable Video. Доступ к GEN-3 скоро появится тут. Не баг, а фича

Не баг, а фича

Dream Machine получил грандиозное обновление — разрабы из Luma почти мгновенно отреагировали на анонс GEN-3. С сегодняшнего дня ИИ генерирует непрерывные видео до 60 секунд! Скоро можно будет редактировать ! каждую генерацию — менять задний фон, главного героя и анимации. Появится библиотека генераций для вдохновения, а у платных подписчиков не будет вотермарок. Записаться в ранний доступ тут. Не баг, а фича

Oleg Trofim | official

Runway представила Gen-3 Alpha – новый гиперреалистичный нейросетевой генератор видосов Обещают высокую детализацию, плавные переходы и больше возможностей для управления видео. Длительность роликов будет 10 секунд и появится возможность обучения модели на собственных стилях. Модель станет доступна в ближайшие дни. Просто посмотрите на примеры — да, всё это сгенерировала нейросеть

GPTTG | Новости | ChatGPT

По следам Sora Runway анонсировали Gen-3 Alpha. Местами выглядит даже круче, но к сожалению пока можно только посмотреть. GPT Новости Для Вас

Похожие новости

+3

+3

![Аватар Телеграм канала: TechGPT [🅽 🅴 🆆 🆂] 🤖](https://content.tek.fm/2972f683-eab7-4e0a-9c08-d11cb3f2e57d.jpg)

+1

+1

+5

+5

+40

+40

+3

+3

Thinking Machines анонсирует новые модели взаимодействия с ИИ для живого общения

Технологии

22 часа назад

+3

+3

Китаец создает короткометражный фильм с помощью ИИ, сравниваемый с 'Любовь, смерть и роботы'

Общество

6 часов назад![Аватар Телеграм канала: TechGPT [🅽 🅴 🆆 🆂] 🤖](https://content.tek.fm/2972f683-eab7-4e0a-9c08-d11cb3f2e57d.jpg)

+1

+1

Google анонсирует обновление Gemini Intelligence и новые функции Android 17

Технологии

22 часа назад

+5

+5

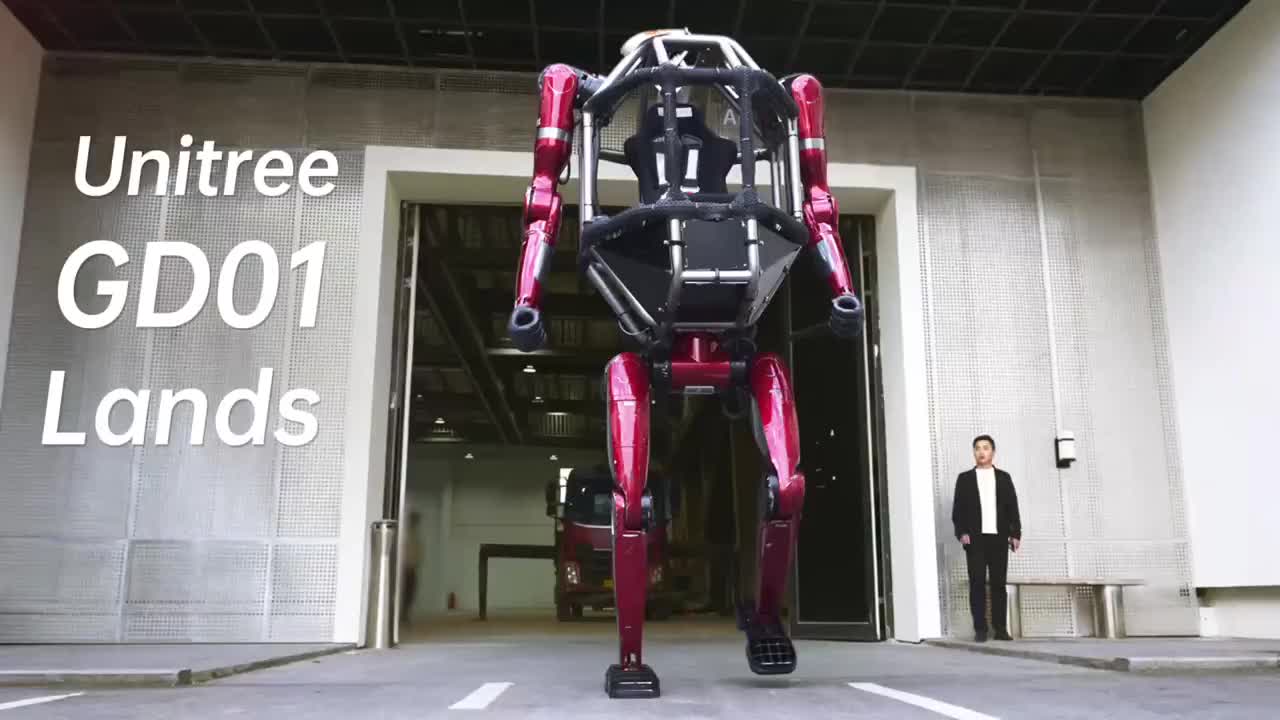

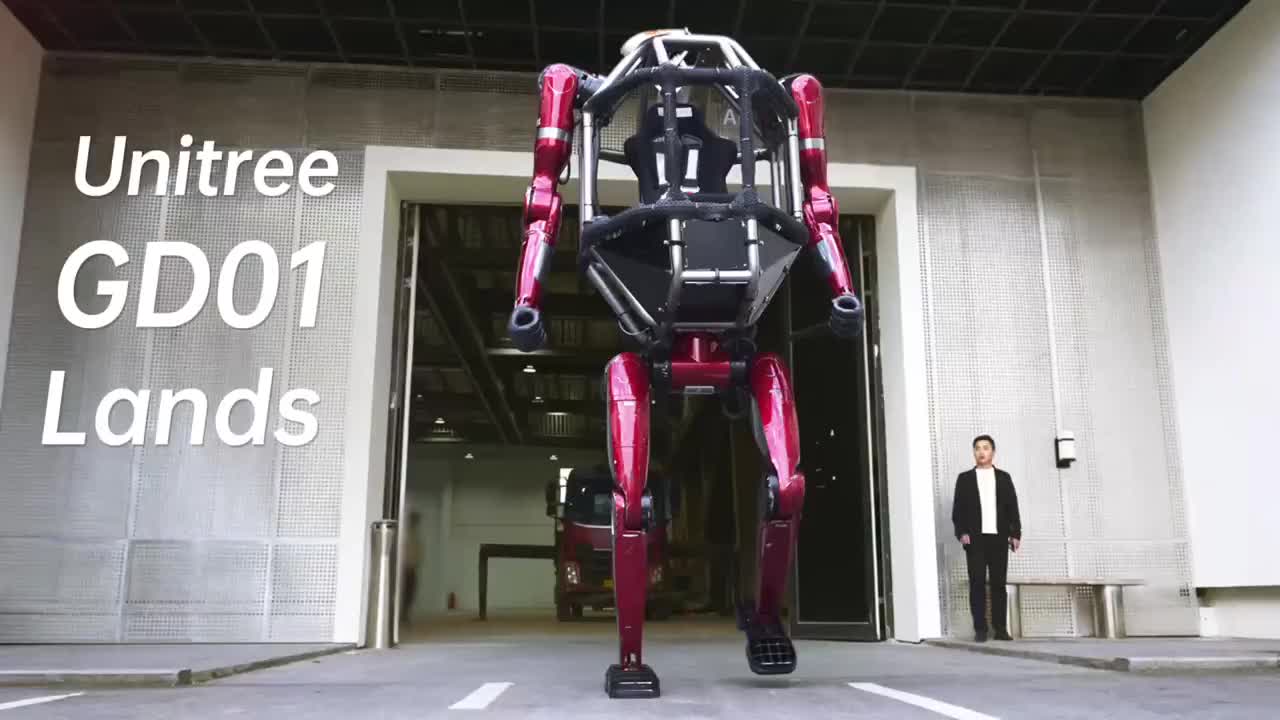

Unitree представила пилотируемого меха-робота для гражданского использования

Технологии

1 день назад

+40

+40

OpenAI запускает инициативу Daybreak для автоматизации защиты от уязвимостей

Технологии

1 день назад

+3

+3

В Беларуси стартовал видеомарафон 'ВсеНачинаетсяСсемьи' в поддержку Года белорусской женщины

Общество

11 часов назад